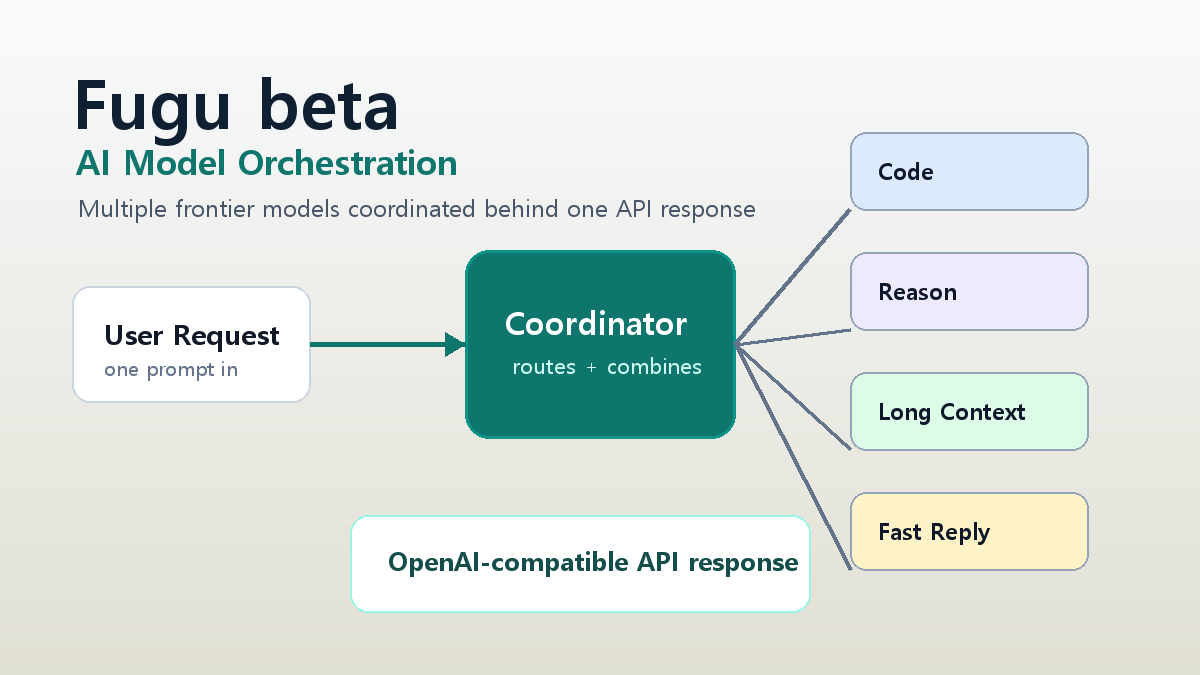

Sakana AI가 Sakana Fugu beta를 공개했습니다. 겉으로 보면 또 하나의 AI API처럼 보일 수 있지만, 핵심은 단일 foundation model 출시가 아닙니다. 여러 frontier foundation model을 pool로 두고, task마다 어떤 agent를 어떻게 묶을지 조율하는 multi-agent orchestration system입니다.

이 발표가 중요한 이유는 AI 제품 경쟁의 초점이 조금씩 바뀌고 있기 때문입니다. 이제 문제는 "어느 모델 하나가 제일 똑똑한가"만이 아닙니다. 실제 제품에서는 coding, reasoning, 문서 처리, latency, 비용, 실패 복구가 한 요청 안에서도 섞입니다. Fugu는 이 복잡한 선택을 사용자가 직접 하는 대신 orchestration layer가 맡겠다는 방향입니다.

한눈에 보기

- 발표 내용: Sakana AI가 상용 AI 제품

Sakana Fugubeta tester 신청을 열었습니다. - 제품 성격: 단일 LLM이 아니라 여러 frontier model을 조율하는 multi-agent orchestration system입니다.

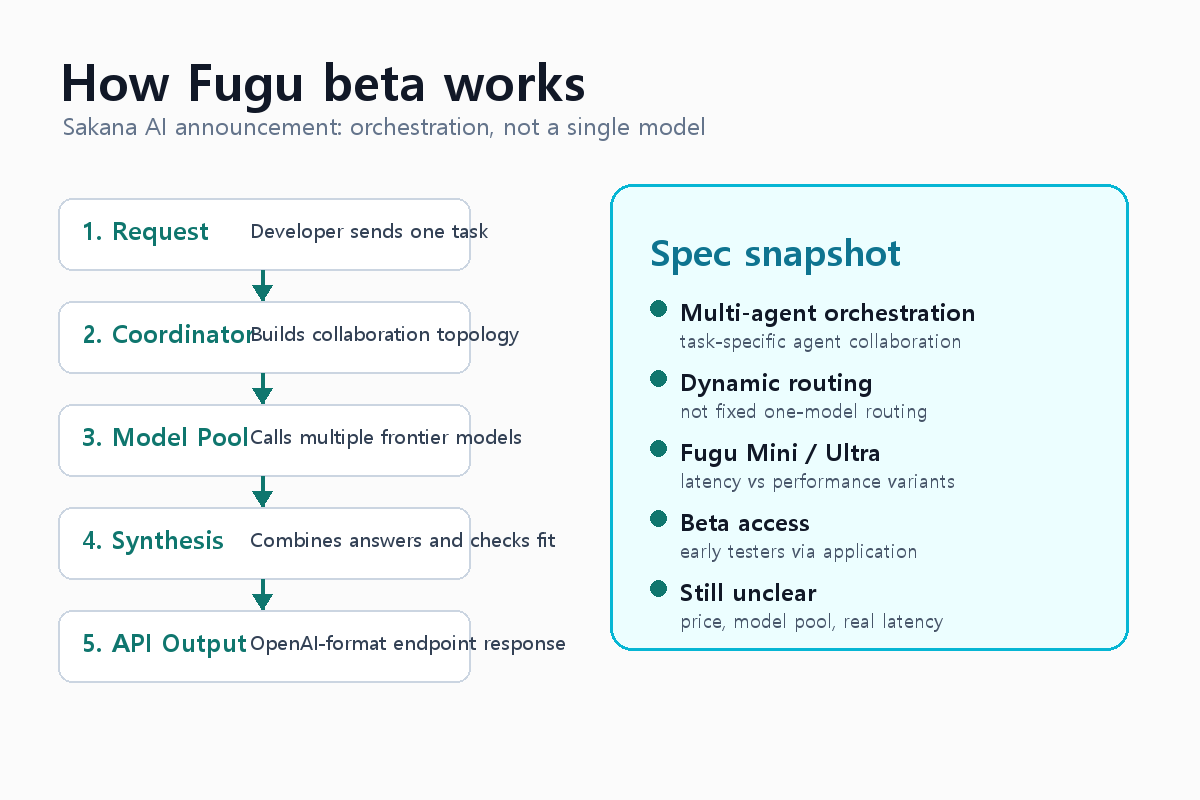

- 제공 방식: 초기에는 API로 제공되며, standard OpenAI-format endpoint와 호환된다고 설명했습니다.

- 제품 구성: latency를 고려한

Sakana Fugu Mini, demanding task 성능을 겨냥한Sakana Fugu Ultra두 variant가 제시됐습니다. - 핵심 판단: 벤치마크 숫자보다 중요한 건 model routing, agent role assignment, fallback, 비용, observability가 실제 workflow에서 얼마나 안정적인지입니다.

이번 발표, 뭐가 다른가

Sakana AI는 Fugu를 "multi-agent orchestration system as a foundation model"로 소개했습니다. 이 표현이 중요합니다. Fugu는 하나의 거대한 모델이 모든 요청을 직접 해결하는 구조보다, 여러 specialized agent가 협력하는 방향을 전제로 합니다.

공식 발표에 따르면 Fugu는 powerful model pool을 동적으로 조율합니다. 사람이 미리 "이 task는 A 모델, 저 task는 B 모델"처럼 규칙을 박아두는 방식이 아니라, 요청에 맞춰 agent를 구성하고 collaboration topology, role, subtask dispatch를 정한다는 설명입니다.

Sakana AI는 이 흐름이 자사 연구인 Trinity와 Conductor 논문을 기반으로 한다고 밝혔습니다. 즉 갑자기 나온 marketing phrase라기보다, 여러 모델과 agent를 조합해 단일 모델보다 나은 결과를 내려는 연구 방향을 제품화한 사례로 보는 편이 맞습니다.

핵심 변화 3가지

1. 모델 선택을 사용자 밖으로 빼려 한다

지금의 AI API 사용 방식은 꽤 수동적입니다. 개발자가 GPT, Claude, Gemini, open model 중에서 직접 고르고, task별 routing과 fallback을 애플리케이션 쪽에서 설계해야 합니다. 작은 앱에서는 단순해 보여도, 실제 제품에서는 금방 복잡해집니다.

예를 들어 coding assistant 하나만 봐도 빠른 autocomplete, 긴 파일 수정, 테스트 실패 분석, 문서 요약, deep reasoning이 모두 다릅니다. 한 모델이 모든 항목에서 항상 최선이기는 어렵습니다. 그래서 팀들은 router, fallback, cache, model별 prompt를 직접 관리합니다.

Fugu의 메시지는 이 부담을 orchestration layer로 옮기겠다는 것입니다. 사용자는 OpenAI-format API처럼 호출하지만, 뒤에서는 여러 모델과 agent가 작업 구조를 나눈다는 방향입니다.

2. OpenAI-format endpoint 호환을 전면에 둔다

Sakana AI는 Fugu가 standard OpenAI-format endpoint와 호환된다고 설명했습니다. 이건 제품 채택 관점에서 중요합니다. 개발자가 새 SDK와 새 호출 방식을 다시 배워야 한다면 실험 장벽이 높아집니다.

기존에 GPT, Gemini, Claude API를 붙여 쓰던 팀이라면 endpoint와 model 설정을 바꾸는 방식으로 테스트할 수 있다는 메시지입니다. 물론 실제 도입 난도는 가격, rate limit, latency, streaming, tool call, error format, observability 지원에 따라 달라집니다.

그래서 이 호환성을 "이미 production-ready migration path가 보장됐다"로 읽으면 안 됩니다. 정확히는 beta 단계에서 기존 AI API workflow에 들어갈 수 있는 모양을 택했다는 의미에 가깝습니다.

3. benchmark보다 운영 조건이 더 중요해진다

공식 글에는 GPQAD, LCBv6, SWEPro 등 일부 benchmark 결과가 제시됐습니다. Fugu Ultra가 몇몇 지표에서 높은 수치를 보인다는 내용입니다. 숫자 자체는 흥미롭지만, 여기서 바로 "최고 모델"로 단정하기는 어렵습니다.

첫째, beta 결과입니다. 둘째, orchestration system은 단일 모델보다 비용과 latency 구조가 복잡할 수 있습니다. 셋째, benchmark에서 좋은 agent 조합이 실제 서비스의 긴 요청, 실패한 tool call, 불완전한 context, 제한된 budget에서도 같은 식으로 작동하는지는 별도 검증이 필요합니다.

Fugu를 볼 때 더 중요한 질문은 이쪽입니다. 어떤 요청에서 여러 모델을 부르는가. 언제 Mini와 Ultra를 나누는가. 실패한 subtask는 어떻게 복구하는가. 비용 상한은 어떻게 거는가. 이런 운영 답이 나와야 실제 제품 판단이 가능합니다.

실제로 뭐가 달라지나

일반 사용자가 당장 체감할 기능은 제한적입니다. Fugu는 beta tester 신청 단계이고, 초기 제공 방식도 API 중심입니다. 지금은 ChatGPT나 Claude처럼 누구나 바로 눌러 쓰는 소비자 앱 발표가 아닙니다.

개발자에게는 더 직접적인 의미가 있습니다. 여러 모델을 붙여 쓰는 팀이라면 model routing, fallback, 비용 최적화, agent coordination을 직접 구현하는 부담이 큽니다. Fugu가 이 계층을 제품으로 제공한다면, 애플리케이션 코드는 더 단순해질 수 있습니다.

AI 제품을 만드는 창업팀에게도 신호가 있습니다. 앞으로 경쟁력은 "최신 모델을 붙였다"에서 끝나지 않습니다. 요청별로 적절한 모델과 tool chain을 고르고, 실패를 복구하고, 비용을 통제하는 orchestration 역량이 제품 품질의 일부가 됩니다.

좋은 점

첫째, 방향이 현실적입니다. 실제 AI 제품에서는 단일 모델 우열보다 여러 모델을 어떻게 조합하느냐가 더 자주 문제가 됩니다.

둘째, API 호환 전략이 명확합니다. OpenAI-format endpoint를 택한 것은 기존 개발자 workflow 안으로 들어가겠다는 선택입니다.

셋째, 연구에서 제품으로 이어지는 흐름이 보입니다. Sakana AI가 이전부터 밀어온 collective intelligence, agent orchestration 연구를 상용 beta로 옮겼다는 점은 지켜볼 만합니다.

주의할 점

첫째, 아직 beta입니다. 가격, rate limit, model pool 구성, 지역별 제공, SLA, latency 분포는 운영 판단에 필요한 수준으로 공개됐다고 보기 어렵습니다.

둘째, benchmark는 Sakana AI의 공식 발표 기준입니다. 외부 재현과 실제 workload 검증 전까지는 참고 지표로만 봐야 합니다.

셋째, orchestration은 성능을 올릴 수 있지만 비용과 복잡도도 올릴 수 있습니다. 여러 모델을 부르는 구조라면 최종 답변 품질뿐 아니라 호출 비용, 실패율, tail latency를 같이 봐야 합니다.

내 생각

Fugu 발표는 "새 모델이 나왔다"보다 "AI API의 다음 추상화가 어디로 가는가"에 가까운 뉴스입니다. 지금까지는 개발자가 직접 모델을 고르고, prompt를 나누고, fallback을 붙였습니다. 하지만 모델 수가 늘수록 이 방식은 유지보수가 어려워집니다.

그래서 orchestration layer는 자연스러운 방향입니다. 사용자는 하나의 API를 호출하지만, 내부에서는 여러 모델이 역할을 나눕니다. 검색, coding, reasoning, 검증, 요약이 섞인 요청에서는 특히 이런 구조가 유리할 수 있습니다.

다만 상용 제품으로 성공하려면 "똑똑한 agent 조합"만으로는 부족합니다. 개발자가 비용을 예측할 수 있어야 하고, 어떤 모델이 왜 호출됐는지 관측할 수 있어야 하며, 실패했을 때 재시도와 fallback을 제어할 수 있어야 합니다. 이 부분이 Fugu의 실제 평가 지점입니다.

결론

Sakana Fugu beta는 단일 frontier model 경쟁과는 결이 다릅니다. 여러 모델을 pool로 두고 task에 맞게 agent를 조율하는 orchestration layer를 제품으로 내놓겠다는 발표입니다.

지금 단계에서는 beta 신청과 공식 benchmark를 근거로 한 초기 신호에 가깝습니다. 하지만 방향 자체는 중요합니다. AI 제품 경쟁은 점점 "어떤 모델을 쓰는가"에서 "여러 모델과 도구를 어떻게 지휘하는가"로 옮겨가고 있습니다.

한 줄 평: "최고 모델 하나보다, 여러 모델을 지휘하는 계층이 제품 경쟁력이 될 수 있다."