미국 Department of War가 Classified Networks AI Agreements를 발표했습니다. 발표문 기준으로 SpaceX, OpenAI, Google, NVIDIA, Reflection, Microsoft, Amazon Web Services가 Department classified networks에 advanced AI capabilities를 배포하기 위한 agreements에 참여합니다.

이 이슈는 "어느 모델이 더 똑똑한가"보다 "고보안 네트워크 안에서 여러 AI 공급자의 역량을 어떻게 운영할 것인가"에 가깝습니다. 국방 AI가 실험 단계를 넘어, classified network 배포와 multi-vendor architecture 문제로 들어가고 있다는 신호입니다.

한눈에 보기

- 발표 내용: 미국 Department of War가 7개 AI·기술 기업과 classified networks 배포 agreements를 발표했습니다.

- 참여 기업: SpaceX, OpenAI, Google, NVIDIA, Reflection, Microsoft, Amazon Web Services입니다.

- 배포 환경: 공식 발표는 Impact Level 6, Impact Level 7 network environments 통합을 언급합니다.

- 목적: data synthesis, situational understanding, warfighter decision-making 보조입니다.

- 운영 맥락: GenAI.mil은 5개월 동안 130만 명 이상의 Department personnel이 사용했고, 수천만 prompts와 수십만 agents 배포가 있었다고 설명됩니다.

- 결론: AI 경쟁은 모델 API만이 아니라 보안 등급, 배포 환경, 공급자 다변화, 운영 통제의 문제로 이동하고 있습니다.

공식 발표에서 확인되는 내용

공식 발표의 핵심은 7개 기업의 AI capabilities를 Department classified networks에 배포하기 위한 agreements입니다. 발표문은 이를 lawful operational use를 위한 배포라고 표현합니다.

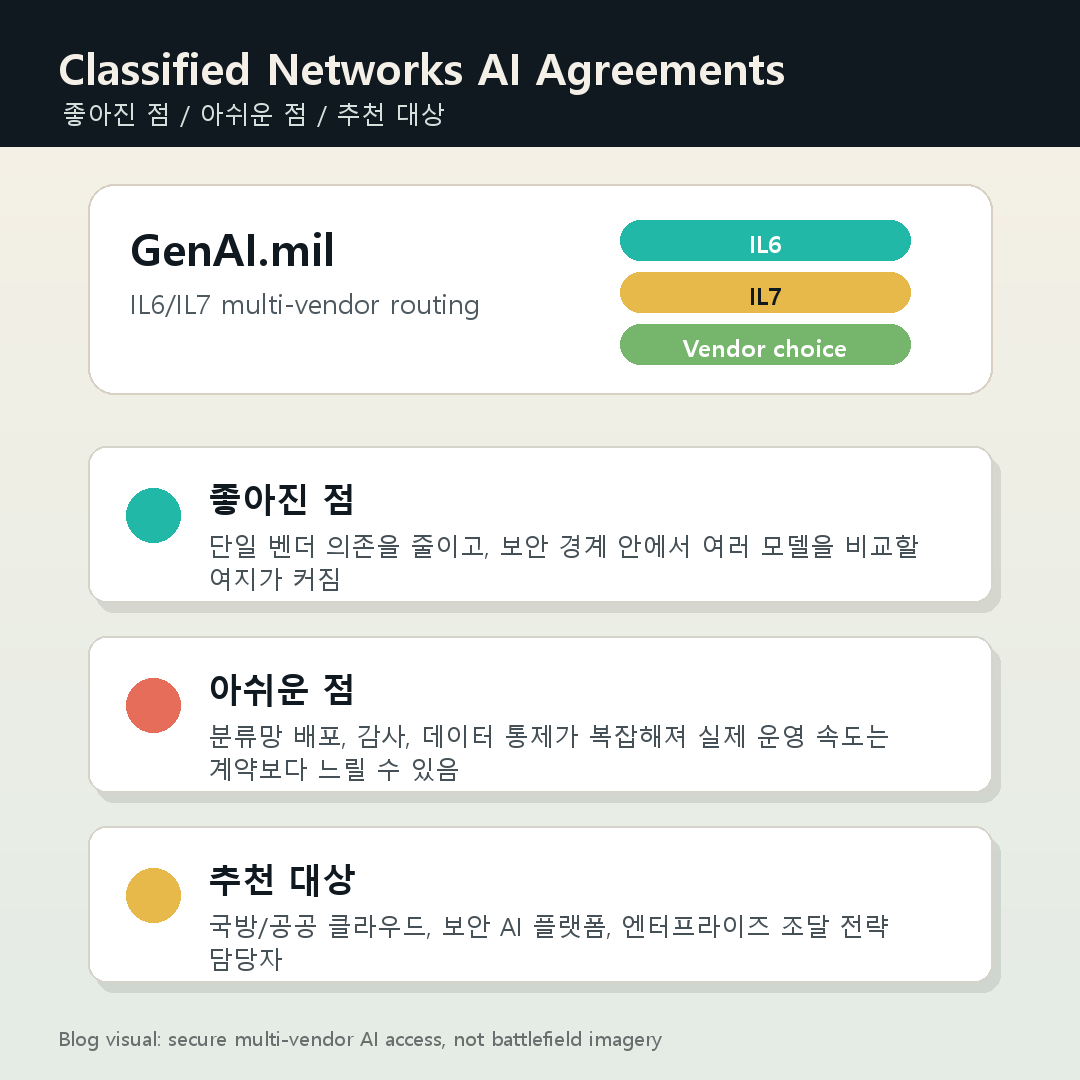

가장 중요한 단어는 IL6와 IL7입니다. Department는 secure frontier AI capabilities를 Impact Level 6, Impact Level 7 network environments에 통합하겠다고 설명했습니다. 일반 기업 SaaS 도입과 다른 지점입니다. AI가 공개 웹 서비스나 내부 업무 챗봇을 넘어, 고보안 네트워크 운영 환경 안으로 들어가는 문제입니다.

공식 발표는 구체적인 모델별 기능 범위나 개별 작전 시나리오를 공개하지 않았습니다. 따라서 이 글에서도 특정 모델이 어떤 군사 작업을 자동화한다고 단정하지 않습니다. 확인되는 건 배포 대상, 보안 환경, 운영 방향입니다.

주목할 변화 3가지

1. 국방 AI의 관심사가 모델 성능에서 배포 환경으로 이동한다

AI 뉴스는 보통 모델명, benchmark, 가격표 중심으로 흘러갑니다. 하지만 이번 발표에서 눈에 띄는 건 모델명이 아니라 네트워크 환경입니다. IL6와 IL7 같은 고보안 environment에 frontier AI capabilities를 넣는다는 점이 핵심입니다.

국방·공공 영역에서는 좋은 모델 하나를 계약하는 것만으로 충분하지 않습니다. 데이터가 어디에 있는지, 어떤 보안 등급에서 실행되는지, 누가 접근할 수 있는지, 로그와 감사가 어떻게 남는지가 실제 도입을 좌우합니다.

이 관점에서 이번 발표는 AI 도입이 "도구 사용"에서 "보안 네트워크 운영" 단계로 넘어가는 사례입니다.

2. GenAI.mil 숫자는 내부 사용 규모가 이미 커졌다는 신호다

공식 발표에는 GenAI.mil 관련 수치가 들어 있습니다. Department의 공식 AI platform인 GenAI.mil을 5개월 동안 130만 명 이상의 Department personnel이 사용했고, 수천만 prompts와 수십만 agents가 배포됐다고 설명합니다.

이 숫자는 두 가지를 보여줍니다. 첫째, 미국 정부와 국방 조직의 AI 도입이 파일럿 수준만은 아니라는 점입니다. 둘째, 다음 경쟁은 "AI를 쓸 것인가"보다 "어떤 보안 환경에서, 어떤 공급자 조합으로, 어떤 governance 아래 운영할 것인가"로 이동한다는 점입니다.

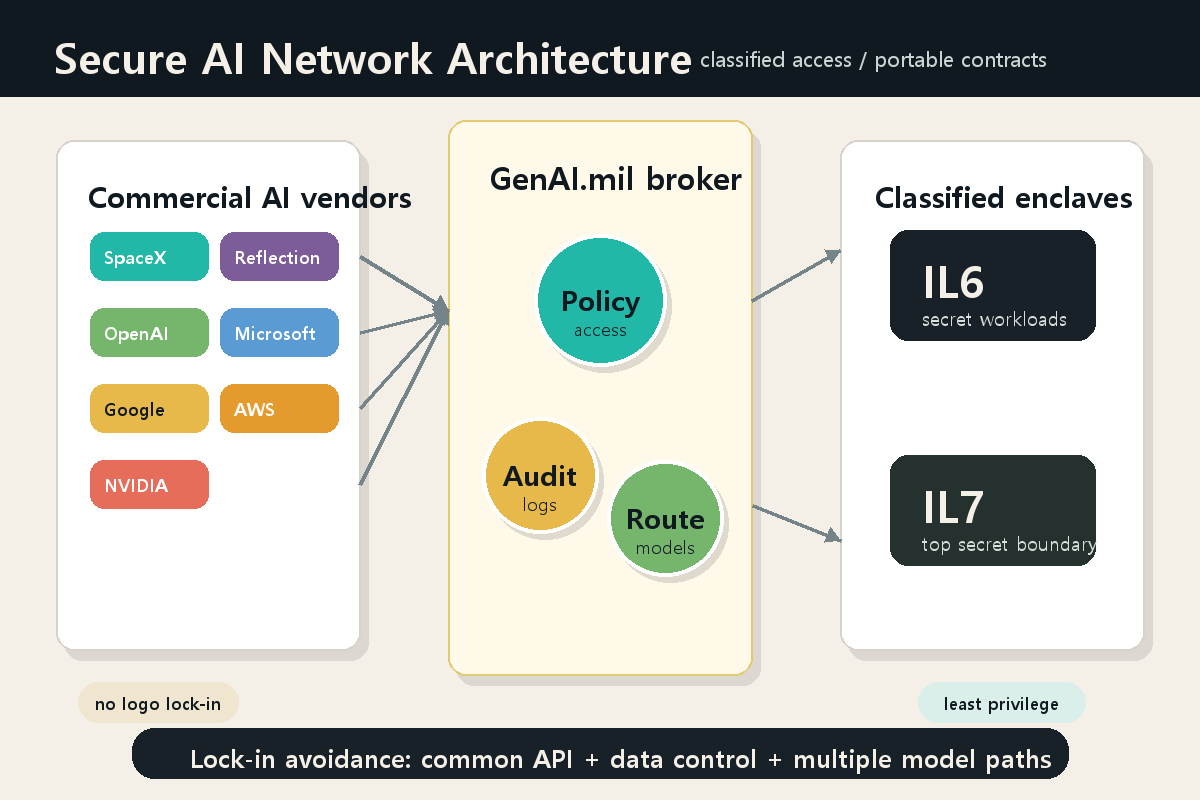

발표문은 vendor lock-in을 피하고 Joint Force의 장기 유연성을 보장하는 architecture를 계속 구축하겠다고도 적었습니다. 여러 공급자의 capabilities를 classified network 환경에 분리·통합하려는 방향으로 읽힙니다.

3. multi-vendor AI stack이 국방 운영의 기본값이 되고 있다

공식 명단에는 OpenAI, Google, Microsoft, AWS, NVIDIA처럼 이미 AI 인프라와 모델 생태계에서 큰 기업들이 포함됐습니다. 여기에 SpaceX와 Reflection도 들어갑니다.

이 조합은 단일 챗봇 계약이 아닙니다. 모델, cloud, GPU, networking, agent, enterprise operations가 함께 얽히는 구조입니다. Department가 "diverse suite of AI capabilities"와 "resilient American technology stack"을 언급한 것도 이 맥락입니다.

다만 공식 발표는 각 기업이 정확히 어떤 capabilities를 어떤 범위로 제공하는지 공개하지 않았습니다. 따라서 기업별 역할을 과하게 추정하는 건 피해야 합니다.

왜 민감한 이슈인가

국방 AI는 기술 도입과 윤리·통제 문제가 동시에 붙습니다. classified networks에 frontier AI capabilities가 들어가면 효율성과 보안뿐 아니라 책임 소재, human oversight, 감사 가능성, 공급망 리스크가 함께 커집니다.

공식 발표는 data synthesis, situational understanding, decision-making 보조를 말하지만, 세부 사용 제한이나 human review 체계, 모델별 배포 범위는 공개하지 않았습니다. 이 빈칸은 앞으로 계속 봐야 할 부분입니다.

또 "lawful operational use"라는 표현은 중요하지만, 그것만으로 충분하지 않습니다. 실제 운영에서는 어떤 작업에 허용되는지, 어떤 작업에는 금지되는지, 자동화 수준은 어디까지인지, 오판이 났을 때 책임 구조가 어떻게 되는지가 더 구체적으로 필요합니다.

실제로 뭐가 달라지나

일반 사용자에게 바로 체감되는 변화는 없습니다. 하지만 AI 산업 관점에서는 꽤 큽니다. frontier AI 공급자가 국방 classified network 안으로 들어가는 표준 경로가 만들어지고 있기 때문입니다.

개발자와 창업자에게는 공공·국방·금융·의료 같은 고보안 시장의 요구사항을 다시 보게 만드는 사례입니다. 이 시장에서는 모델 성능만으로는 부족합니다. 보안 등급, 접근 통제, 감사 로그, 배포 위치, vendor lock-in 회피, 장애 대응까지 제품의 일부가 됩니다.

AI 기업 입장에서는 compliance와 deployment capability가 모델 성능만큼 중요해질 수 있습니다. 좋은 모델을 만드는 것과, 그 모델을 classified 또는 regulated environment에 안전하게 넣는 것은 다른 역량입니다.

주의할 점

첫째, 공식 발표는 고수준 발표입니다. 세부 계약 조건, 모델별 기능 범위, 가격, region, 접근 권한, human oversight 방식은 공개되지 않았습니다.

둘째, 군사 AI 이슈는 과장되기 쉽습니다. 이번 발표가 곧바로 자율 무기 배포를 의미한다고 단정할 근거는 공식 발표 안에 없습니다. 확인되는 건 classified networks 배포 agreements와 운영 방향입니다.

셋째, 참여 기업 명단만으로 각 기업의 역할을 추정하면 안 됩니다. OpenAI, Google, NVIDIA, Microsoft, AWS가 모두 포함됐지만, 구체적인 workload 분담은 발표문에서 확인되지 않습니다.

내 생각

이번 발표의 핵심은 국방 AI가 "어떤 모델을 쓸까"에서 "어떤 네트워크와 운영 구조 안에 넣을까"로 이동하고 있다는 점입니다. 이건 민간 AI 제품에도 곧 돌아올 질문입니다. 금융, 의료, 법률, 공공기관은 결국 비슷한 질문을 하게 됩니다.

누가 접근할 수 있는가. 어디에 배포되는가. 어떤 로그가 남는가. 공급자를 바꿀 수 있는가. 사람이 어디에서 승인하는가. 이 질문에 답하지 못하면 강한 모델도 고위험 조직 안에서는 쓰기 어렵습니다.

Department of War의 이번 announcement는 국방 AI 뉴스이면서 동시에 AI deployment architecture 뉴스입니다. 앞으로 AI 기업의 경쟁력은 모델 성능표와 함께, 이런 고보안 환경에 들어갈 수 있는 운영 능력으로도 평가될 가능성이 큽니다.