OpenAI가 Cybersecurity in the Intelligence Age를 공개했습니다. 부제는 An action plan for democratizing AI-powered cyber defense입니다. 표현은 크지만, 핵심은 꽤 현실적입니다. 공격자도 AI를 쓰는 시대라면 방어자도 더 빠르고 넓게 AI를 쓸 수 있어야 하고, 그 접근에는 검증과 통제가 붙어야 한다는 이야기입니다.

이 글은 4월 14일 공개된 Trusted Access for Cyber와 GPT-5.4-Cyber 흐름의 상위 정리본에 가깝습니다. 이미 강한 사이버 모델을 누가 쓸 수 있느냐가 쟁점이었다면, 이번 액션플랜은 그 문제를 정책, 제품, 계정 보안, 평가기관 협력까지 묶어서 설명합니다.

한눈에 보기

- 발표 내용: OpenAI가 2026년 4월 29일 사이버 방어 액션플랜을 공개했습니다.

- 핵심 방향: 검증된 방어자에게 AI 기반 방어 도구 접근을 넓히되, 가시성·통제·사용자 보호를 같이 강화합니다.

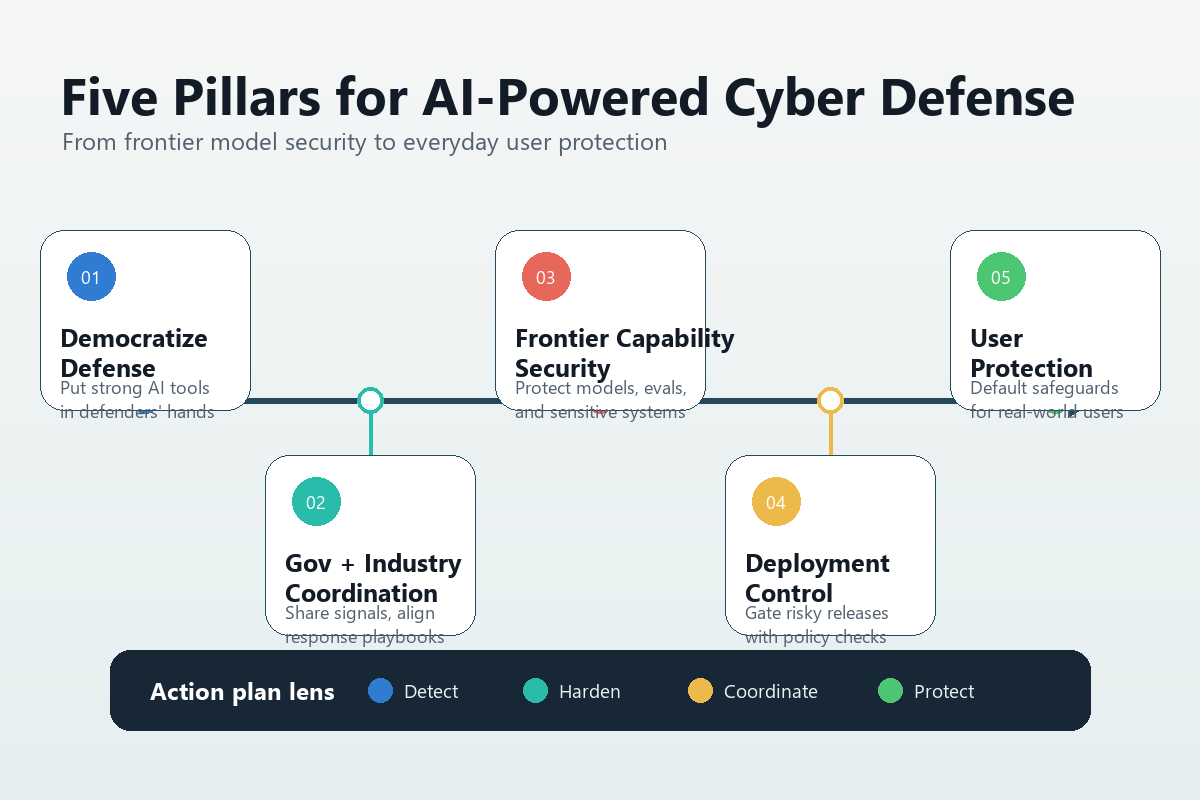

- 5대 축: cyber defense 민주화, 정부-산업 조정, frontier cyber capabilities 보안 강화, 배포 시 visibility/control 유지, 사용자 보호입니다.

- 연결된 제품 변화: Advanced Account Security가 ChatGPT와 Codex 계정 보호 기능으로 이어졌습니다.

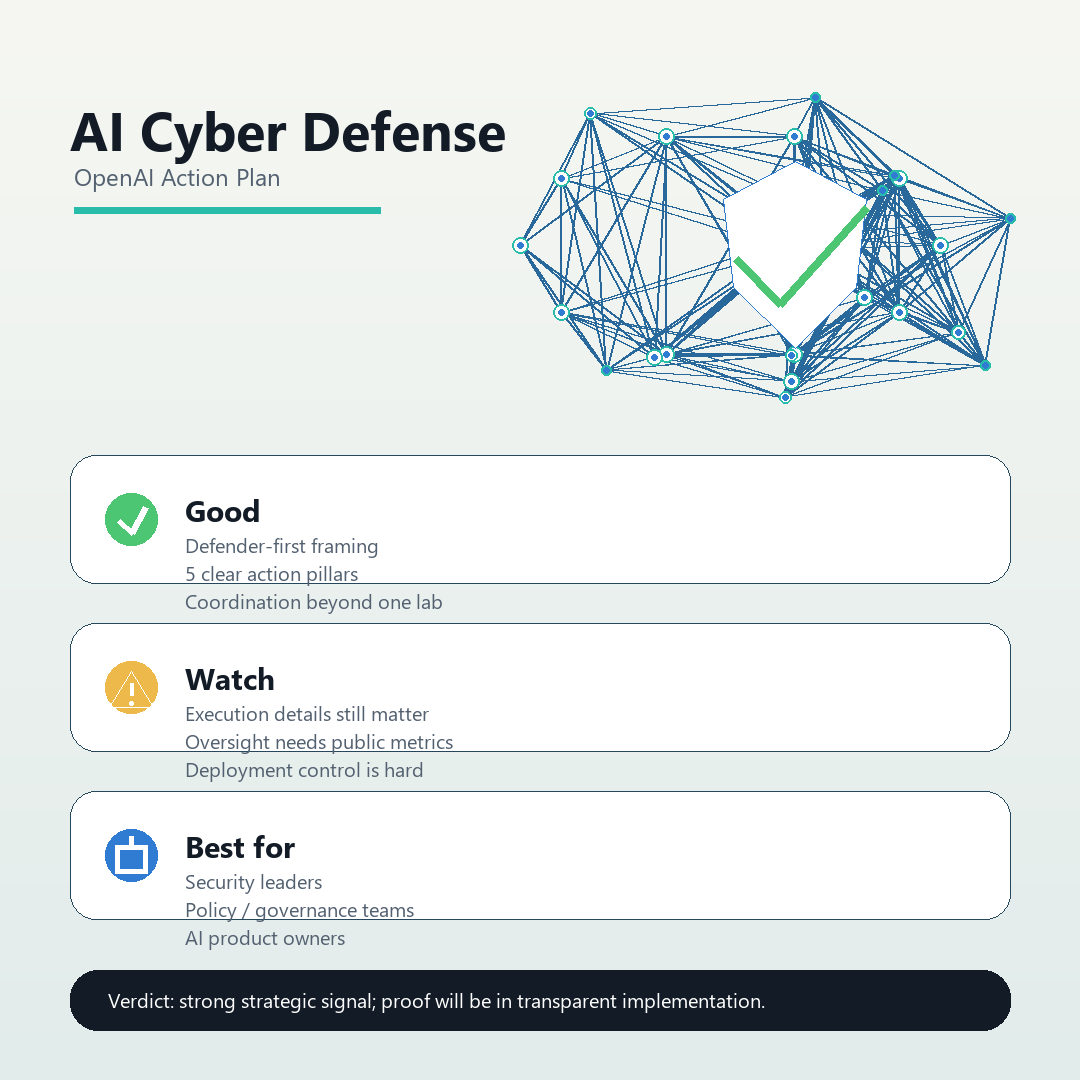

- 결론: OpenAI의 사이버 보안 전략은 "강한 모델 공개"보다 "신뢰 기반 접근권 설계"에 가깝습니다.

공식 발표에서 확인되는 내용

OpenAI는 이번 글에서 AI가 사이버 보안의 양쪽을 모두 바꾸고 있다고 설명합니다. 방어자는 취약점 식별, remediation 자동화, 빠른 대응에 AI를 쓸 수 있지만, 악의적 행위자도 공격 규모를 키우고 진입 장벽을 낮추는 데 AI를 쓸 수 있습니다.

그래서 액션플랜은 단순한 제품 소개가 아닙니다. OpenAI는 사이버 보안 및 국가 안보 전문가들과 논의해 다섯 가지 실행 축을 세웠다고 설명합니다. 핵심은 trusted actors와 defenders에게 방어 도구 접근을 넓히는 것입니다. 누구에게나 무제한으로 푼다는 뜻도 아니고, 위험하니 전부 막자는 뜻도 아닙니다.

이 지점이 중요합니다. AI 사이버 보안 논쟁은 보통 "공격에 쓰이면 위험하다"에서 멈추기 쉽습니다. 하지만 실제 보안팀 입장에서는 취약점 분석, 코드 리뷰, alert triage, incident response를 더 빨리 처리해야 합니다. 공격자가 빨라지는 상황에서 방어자만 느리게 두면 전체 보안 수준은 오히려 낮아질 수 있습니다.

주목할 변화 3가지

1. 논점이 모델 성능에서 접근권으로 이동했다

OpenAI는 이미 Trusted Access for Cyber 프로그램을 통해 검증된 개인 방어자와 critical software를 지키는 팀에게 더 강한 모델 접근을 넓히겠다고 발표했습니다. 여기에는 GPT-5.4-Cyber처럼 방어 목적의 사이버 작업에 더 허용적으로 조정된 모델 흐름도 포함됩니다.

이번 액션플랜은 그 방향을 더 넓은 문장으로 정리합니다. 이제 중요한 질문은 "모델이 취약점을 찾을 수 있나"만이 아닙니다. "누가 이 모델을 쓸 수 있나", "어떤 신원 확인을 거치나", "어떤 로그와 통제가 붙나"가 같이 중요해졌습니다.

보안용 AI는 일반 생산성 도구와 다릅니다. 같은 기능도 방어팀에게는 패치 속도를 높이는 도구가 되지만, 통제 없이 악용되면 공격 자동화로 이어질 수 있습니다. 그래서 성능보다 접근권 설계가 핵심 쟁점이 됩니다.

2. Advanced Account Security가 액션플랜을 제품 기능으로 연결했다

OpenAI는 4월 30일 Advanced Account Security도 공개했습니다. ChatGPT 계정에 선택형 고급 보안 모드를 켜면 passkey 또는 physical security key 기반 로그인, 이메일·SMS 복구 제한, 짧아진 세션, 로그인 알림, 활성 세션 관리, 모델 학습 자동 제외가 적용됩니다. Codex도 같은 로그인 계정을 통해 보호됩니다.

이건 사이버 액션플랜의 "사용자 보호" 축이 실제 제품 기능으로 내려온 사례입니다. 특히 OpenAI는 Trusted Access for Cyber에서 가장 cyber-capable and permissive models에 접근하는 개인 구성원에게 2026년 6월 1일부터 Advanced Account Security를 요구하겠다고 밝혔습니다.

즉 고위험 모델 접근과 계정 보안이 분리된 문제가 아닙니다. 강한 모델을 쓰는 사람의 계정이 뚫리면 그 자체가 보안 사고가 됩니다. 앞으로 고급 AI 기능은 모델 권한, 계정 인증, 조직 SSO, recovery policy가 한 세트로 묶일 가능성이 큽니다.

3. 보안 AI는 정부·평가기관·산업계 협력 문제가 됐다

OpenAI의 액션플랜은 정부와 산업 간 조정도 별도 축으로 둡니다. 또 frontier cyber capabilities 주변의 보안을 강화하고, 배포 과정에서 visibility와 control을 유지해야 한다고 설명합니다.

이건 AI 보안 제품을 만드는 팀에게도 중요한 신호입니다. 이제 "AI가 취약점을 찾아줍니다"만으로는 부족합니다. 어떤 사용자에게 허용할지, 위험 기능을 어떻게 제한할지, 사용 기록을 어떻게 남길지, abuse reporting과 사후 접근 조정을 어떻게 할지가 제품 경쟁력의 일부가 됩니다.

기업 보안팀도 마찬가지입니다. 모델 자체보다 운영 구조를 봐야 합니다. 누가 접근하는지, 어떤 데이터가 들어가는지, 어떤 결과가 자동 실행되는지, 사람이 어디서 승인하는지가 실제 리스크를 결정합니다.

기존 글과 다른 점

4월 23일에 다룬 AI 사이버 방어 모델 경쟁 글은 Anthropic Project Glasswing과 OpenAI Trusted Access를 나란히 비교했습니다. 그 글의 초점은 강한 사이버 모델을 누가 어떤 책임 아래 쓰는가였습니다.

이번 글의 초점은 조금 다릅니다. OpenAI가 그 접근권 문제를 더 넓은 액션플랜으로 정리했다는 점입니다. 모델, 계정 보안, 정부-산업 조정, 평가 접근, 배포 통제를 하나의 정책 언어로 묶은 발표입니다.

따라서 이 이슈는 중복 뉴스가 아니라 후속 흐름으로 보는 게 맞습니다. 다만 GPT-5.4-Cyber의 구체 기능이나 Trusted Access 심사 기준은 여전히 공개 자료만으로는 제한적으로만 판단할 수 있습니다.

실제로 뭐가 달라지나

일반 사용자에게 가장 먼저 보이는 변화는 계정 보안입니다. 고위험 사용자나 보안에 민감한 사용자는 Advanced Account Security처럼 phishing-resistant 인증과 recovery 제한을 쓰는 흐름이 더 자연스러워질 수 있습니다. 대신 계정 복구가 어려워질 수 있으므로 보안 강화는 편의성 감소와 같이 옵니다.

개발자와 보안팀에게는 AI를 보안 워크플로에 넣을 때의 기준이 달라집니다. 취약점 분석, dependency risk 탐지, alert triage, threat intelligence 정리 같은 작업은 AI와 잘 맞습니다. 하지만 결과를 자동으로 실행하기 전에 사람의 검토, 로그, 접근 권한, 데이터 경계를 정해야 합니다.

창업자에게는 제품 기회가 있습니다. 강한 모델 자체를 만드는 회사는 많지 않더라도, 그 모델을 안전한 보안 업무 흐름 안에 넣고 권한 관리, 감사, 리포팅, 승인 단계를 묶는 제품은 더 필요해질 수 있습니다.

주의할 점

첫째, democratizing이라는 표현을 "누구에게나 무제한 공개"로 읽으면 안 됩니다. OpenAI 발표의 실제 무게는 verified defenders, visibility, control, identity verification 쪽에 있습니다.

둘째, Cybersecurity Grant Program이나 Trusted Access가 실제 보안 운영 시간을 얼마나 줄였는지는 더 검증이 필요합니다. 공식 발표는 방향을 설명하지만, 실무 효과는 별도 지표가 필요합니다.

셋째, 고급 계정 보안은 모든 사용자에게 쉬운 기능이 아닙니다. physical security key나 recovery key를 제대로 관리하지 못하면 계정 복구 자체가 어려워질 수 있습니다.

내 생각

이번 발표에서 제일 중요한 단어는 "민주화"보다 "신뢰"입니다. 사이버 보안에서는 강한 도구를 넓게 푸는 것 자체가 위험이 될 수 있습니다. 그래서 OpenAI가 trusted defenders, visibility, control, identity verification을 같이 배치한 점이 핵심입니다.

OpenAI의 메시지는 "모두에게 강력한 사이버 AI를 열겠다"가 아닙니다. 더 정확히는 "검증된 방어자가 공격자보다 빨리 움직일 수 있도록 접근과 통제 구조를 만들겠다"에 가깝습니다.

이 방향은 앞으로 다른 고위험 AI 기능에도 반복될 가능성이 큽니다. 생물학, 금융, 법률, 국방처럼 오용 리스크가 큰 영역에서는 모델 성능보다 접근 권한과 운영 통제가 먼저 제품의 일부가 될 겁니다.

결론

OpenAI의 사이버 보안 액션플랜은 AI 시대의 방어 전략을 제품, 정책, 계정 보안, 배포 통제 차원에서 같이 다루려는 시도입니다. 아직 세부 심사 기준과 실제 효과는 더 봐야 합니다. 그래도 방향은 분명합니다.

한 줄 평: "AI 보안의 다음 질문은 성능이 아니라 접근 권한이다."