NVIDIA가 Nemotron 3 Nano Omni를 공개했습니다. 이름만 보면 또 하나의 멀티모달 모델처럼 보이지만, 이번 발표의 핵심은 조금 더 구체적입니다. AI 에이전트가 보고, 듣고, 읽는 입력을 여러 모델에 나눠 맡기지 않고 하나의 흐름에서 처리하게 만드는 open omni-modal reasoning model입니다.

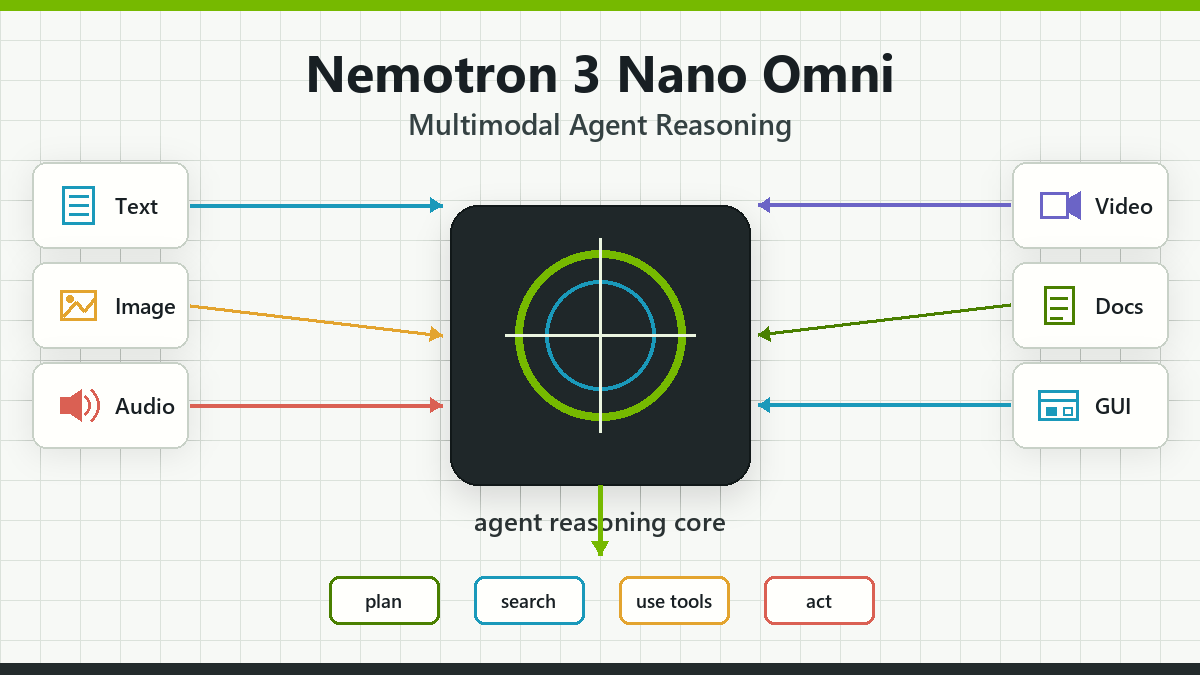

공식 블로그 기준으로 이 모델은 text, images, audio, video, documents, charts, graphical interfaces를 입력으로 받고, 출력은 text입니다. 즉 최종 답변을 모두 책임지는 거대 모델이라기보다, 에이전트 시스템 안에서 "눈과 귀"를 담당하는 perception sub-agent로 보는 편이 정확합니다.

한눈에 보기

- 발표 내용: NVIDIA가 2026년 4월 28일

Nemotron 3 Nano Omni를 공개했습니다. - 모델 성격: open omni-modal reasoning model이며, 에이전트용 multimodal perception sub-agent를 겨냥합니다.

- 입력 범위: 텍스트, 이미지, 오디오, 비디오, 문서, 차트, GUI 입력을 처리합니다.

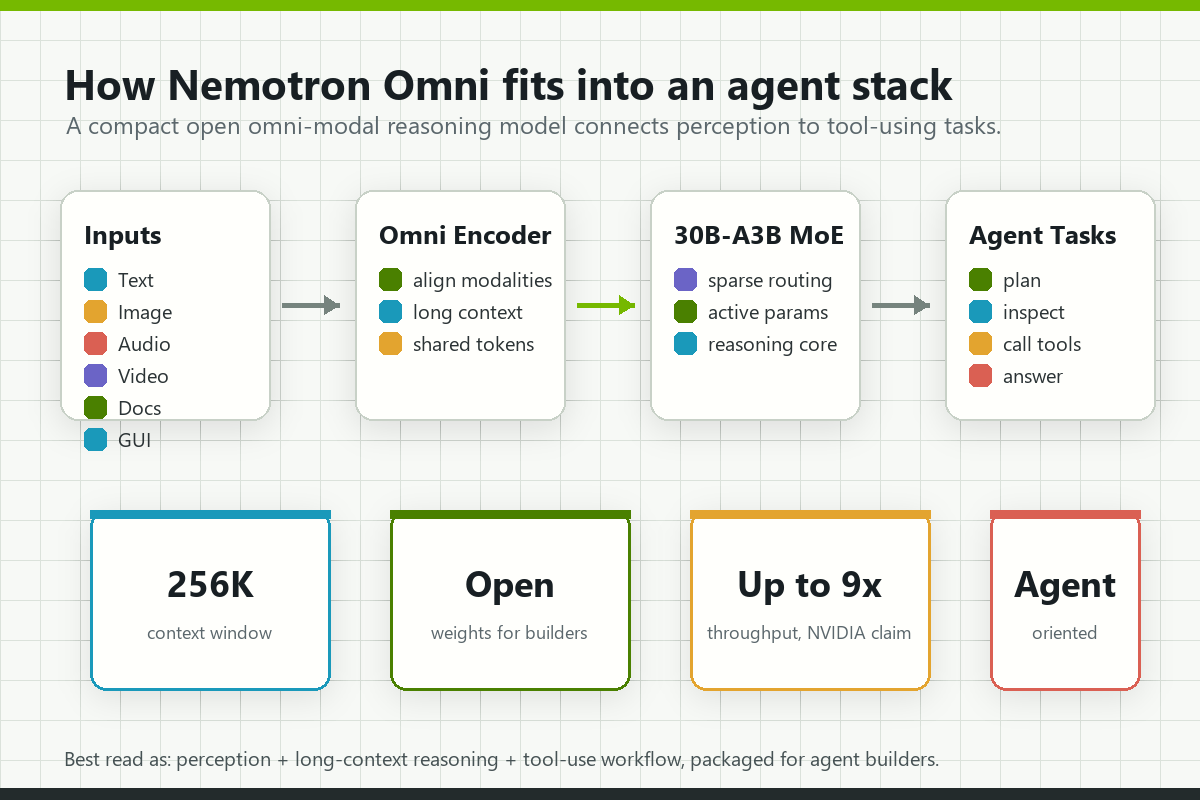

- 구조: NVIDIA docs 기준 30B-A3B MoE multimodal reasoning model입니다.

- 컨텍스트: NVIDIA 발표와 기술 문서는 256K context를 언급합니다.

- 효율 주장: NVIDIA는 같은 interactivity 조건에서 다른 open omni model 대비 최대 9x throughput을 제시했습니다.

- 결론: 멀티모달 에이전트의 다음 병목은 답변 생성보다 입력 감각 처리입니다.

공식 발표에서 확인되는 내용

NVIDIA는 현재 많은 agentic system이 vision, speech, language 모델을 따로 연결한다고 지적합니다. 화면은 vision-language model, 음성은 speech model, 문서는 text model로 처리하는 식입니다. 이 방식은 모델 호출이 여러 번 이어지고, latency와 비용이 늘며, 모달리티 사이 맥락이 끊기기 쉽습니다.

Nemotron 3 Nano Omni는 이 조각난 파이프라인을 하나의 multimodal reasoning loop로 줄이려는 모델입니다. 기술 블로그는 이 모델을 agentic system 안의 multimodal perception and context sub-agent로 설명합니다.

이 표현이 중요합니다. NVIDIA가 노리는 건 ChatGPT 같은 최종 챗봇 포지션만이 아닙니다. 더 큰 agent system 안에서 화면, 문서, 음성, 영상, 차트, UI 상태를 읽고 요약해 다음 planning 또는 execution model에 넘기는 역할입니다.

주목할 변화 3가지

1. 에이전트의 눈과 귀를 하나로 묶는다

실제 업무용 에이전트는 텍스트만 잘한다고 충분하지 않습니다. 회의 녹음, 화면 녹화, PDF, 표, 차트, 웹 UI, 스크린샷이 모두 입력으로 들어옵니다. 이걸 매번 별도 모델로 넘기면 시스템은 빠르게 복잡해집니다.

NVIDIA는 Nemotron 3 Nano Omni가 video, audio, image, text를 하나의 shared perception-to-action loop 안에서 처리할 수 있다고 설명합니다. 고객지원 agent가 화면 녹화, 통화 오디오, 데이터 로그를 함께 보거나, 금융 agent가 PDF, spreadsheet, chart, voice note를 같이 읽는 시나리오가 예시로 제시됩니다.

이건 멀티모달 기능 자체보다 파이프라인 단순화가 핵심입니다. 모델 하나로 모든 문제가 해결된다는 뜻은 아니지만, perception layer를 단순하게 만들 수 있다면 에이전트 시스템의 비용과 지연 시간이 줄어듭니다.

2. 30B-A3B hybrid MoE와 256K context가 핵심 스펙이다

NVIDIA docs는 이 모델을 30B-A3B MoE multimodal reasoning model로 설명합니다. 언어 backbone은 Mamba와 attention hybrid 구조를 쓰고, vision tower와 Parakeet sound encoder가 결합됩니다.

기술 블로그는 Conv3D 기반 spatiotemporal processing, Efficient Video Sampling, 256K context도 함께 설명합니다. 영상과 긴 문서가 섞인 입력을 처리할 때 visual token이 너무 커지는 문제를 줄이려는 설계입니다.

사용자 관점에서는 "긴 자료와 다양한 미디어를 한 번에 읽는 능력"으로 이해하면 됩니다. 다만 256K context나 영상 이해가 있다고 해서 모든 긴 입력이 자동으로 정확해지는 것은 아닙니다. 실제 성능은 입력 품질, sampling 방식, inference stack, 평가 기준에 따라 달라집니다.

3. 최대 9x throughput은 NVIDIA 조건 기준으로 봐야 한다

NVIDIA는 Nemotron 3 Nano Omni가 같은 interactivity 조건에서 다른 open omni model 대비 최대 9x higher throughput을 달성한다고 주장합니다. 기술 블로그에서는 video reasoning 기준 최대 약 9.2배, multi-document reasoning 기준 최대 약 7.4배 effective system capacity 개선도 언급합니다.

이 숫자는 의미가 있지만, 그대로 일반화하면 안 됩니다. NVIDIA가 제시한 benchmark, hardware, quantization, inference engine, 입력 구성 조건에서 나온 수치입니다. 실제 서비스에서는 GPU 종류, vLLM 또는 TensorRT-LLM 설정, FP8/NVFP4 quantization, 영상 프레임 sampling, 동시 사용자 수에 따라 결과가 달라집니다.

그래서 이 글에서는 "효율이 좋아졌다고 NVIDIA가 주장한다"보다 더 나아가 단정하지 않습니다. 독립 벤치마크와 실제 운영 로그가 쌓여야 비용 절감 폭을 판단할 수 있습니다.

실제로 뭐가 달라지나

일반 사용자에게 바로 보이는 변화는 제한적입니다. 이 모델은 소비자용 챗봇이라기보다 개발자와 기업이 agent workflow 뒤쪽에 붙이는 구성 요소에 가깝습니다. 다만 최종 제품에서는 AI가 문서, 영상, 음성, 화면을 한 번에 더 자연스럽게 이해하는 형태로 체감될 수 있습니다.

개발자에게는 perception pipeline 단순화가 핵심입니다. 문서 분석, 영상 요약, 회의 녹취 분석, GUI 상태 이해, RAG 기반 enterprise Q&A를 각각 다른 모델로 연결하지 않고 하나의 omni-modal 모델로 묶는 선택지가 생깁니다.

기업 입장에서는 document intelligence와 meeting intelligence가 먼저 떠오릅니다. 문서, 표, 차트, 음성, 영상이 섞인 자료를 하나의 agent workflow에서 처리하면 내부 지식 검색이나 고객지원 자동화가 더 자연스러워질 수 있습니다.

주의할 점

첫째, open weights와 deployment flexibility가 있다고 해서 도입이 자동으로 쉬운 것은 아닙니다. GPU, inference engine, quantization, 모델 서빙, 데이터 보안 요구사항을 같이 봐야 합니다.

둘째, 멀티모달 입력에는 개인정보와 저작권 리스크가 많이 섞입니다. 회의 녹음, 영상, 고객 통화, 문서, 화면 캡처는 모두 접근 권한과 보관 정책을 명확히 해야 합니다.

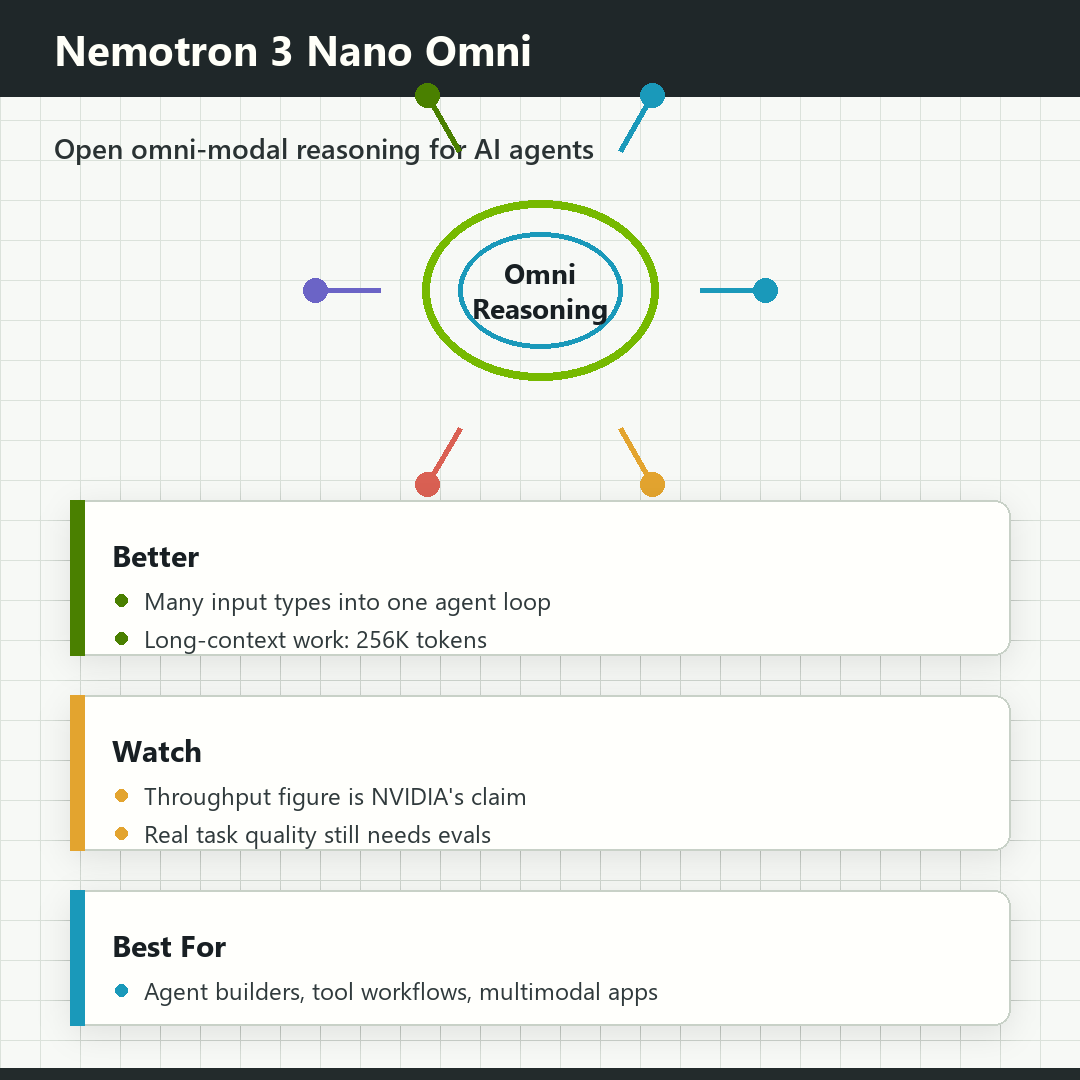

셋째, NVIDIA가 제시한 throughput과 leaderboard 성능은 공식 주장입니다. 독립 검증과 실제 workload 테스트가 필요합니다.

내 생각

이번 발표에서 흥미로운 부분은 모델 자체보다 역할 정의입니다. NVIDIA는 Nemotron 3 Nano Omni를 모든 답변을 담당하는 단일 대형 모델로만 밀지 않습니다. 에이전트 시스템 안에서 감각과 맥락을 담당하는 하위 모델로 포지셔닝합니다.

이 방향은 현실적입니다. 실제 업무용 에이전트는 텍스트 답변보다 입력 이해에서 먼저 막히는 경우가 많습니다. 화면을 보고, 문서를 읽고, 회의 음성을 듣고, 영상 속 흐름을 이해해야 합니다. 그런데 이 입력을 매번 별도 파이프라인으로 이어 붙이면 시스템은 금방 복잡해집니다.

OpenAI, Google, Mistral이 reasoning과 tool use를 제품 전면에 세운다면, NVIDIA는 멀티모달 perception layer를 효율적으로 제공하는 쪽에 무게를 둔 것으로 보입니다. 이건 NVIDIA가 GPU와 inference stack을 함께 가진 회사이기 때문에 가능한 포지션입니다.

결론

Nemotron 3 Nano Omni는 AI agent가 다양한 입력을 하나의 맥락 안에서 이해하도록 만들려는 NVIDIA의 open omni-modal reasoning model입니다. 공식 발표 기준 핵심은 30B-A3B hybrid MoE, 256K context, Conv3D, EVS, open weights와 datasets 공개입니다.

한 줄 평: "멀티모달 에이전트의 다음 병목은 답변보다 감각 입력 처리다."