Google Research가 Vantage라는 연구 실험을 공개했습니다. 핵심은 생성형 AI를 단순한 튜터나 문제 풀이 도구로 쓰는 것이 아닙니다. AI avatars와 simulated environment를 만들어 협업, 갈등 해결, 프로젝트 관리 같은 future-ready skills를 관찰하고 평가하려는 시도입니다.

이 발표가 중요한 이유는 AI 평가의 방향이 바뀌고 있기 때문입니다. 기존 시험은 정답을 맞혔는지 확인하는 데 강했습니다. 하지만 실제 업무와 학습에서 중요한 역량은 대화, 조율, 반박, 역할 분담 같은 과정에서 드러납니다. Vantage는 이 과정을 AI 시뮬레이션 안에서 측정해보려는 접근입니다.

한눈에 보기

- 발표 내용: Google Research가 future-ready skills 평가 실험

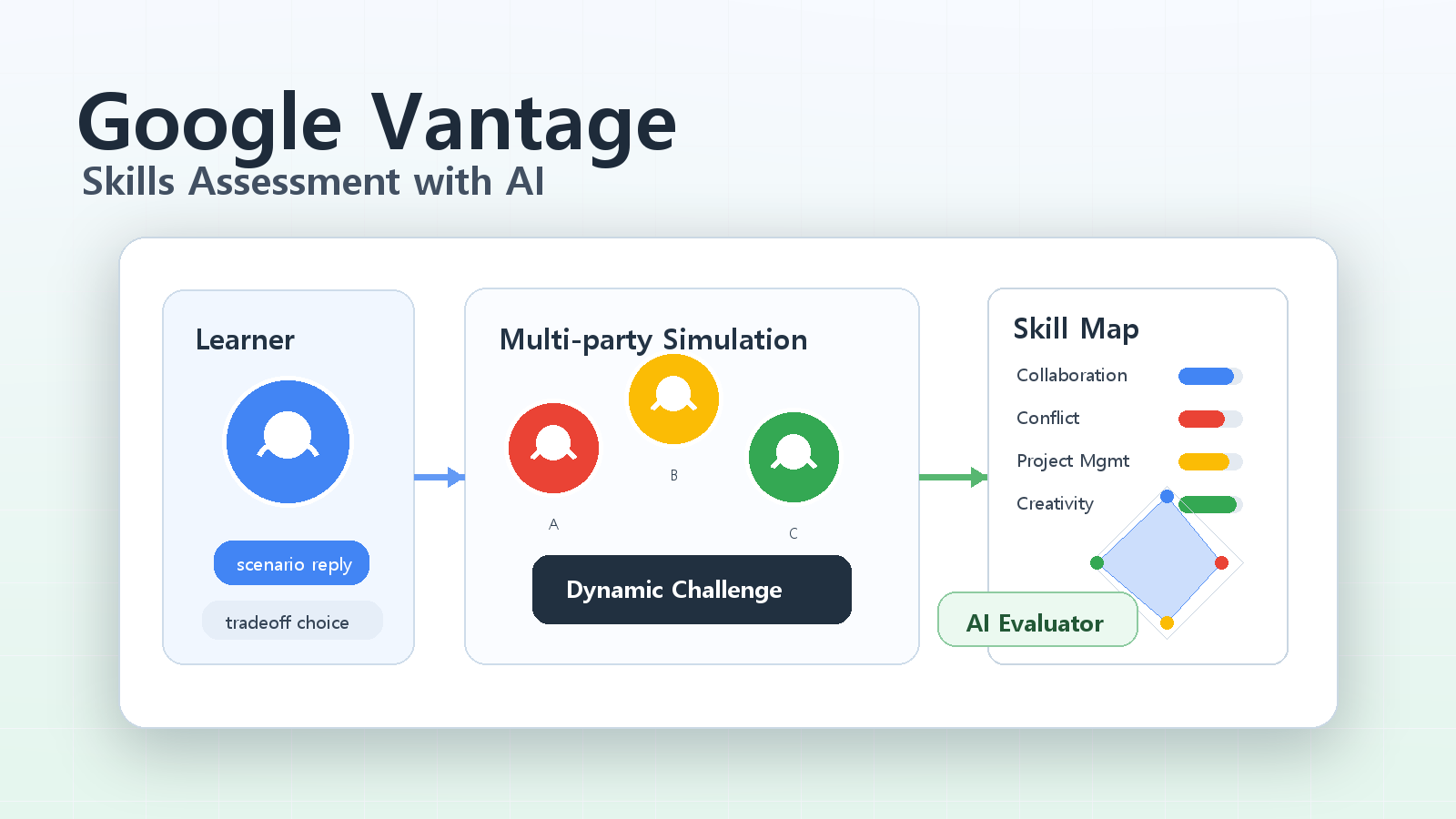

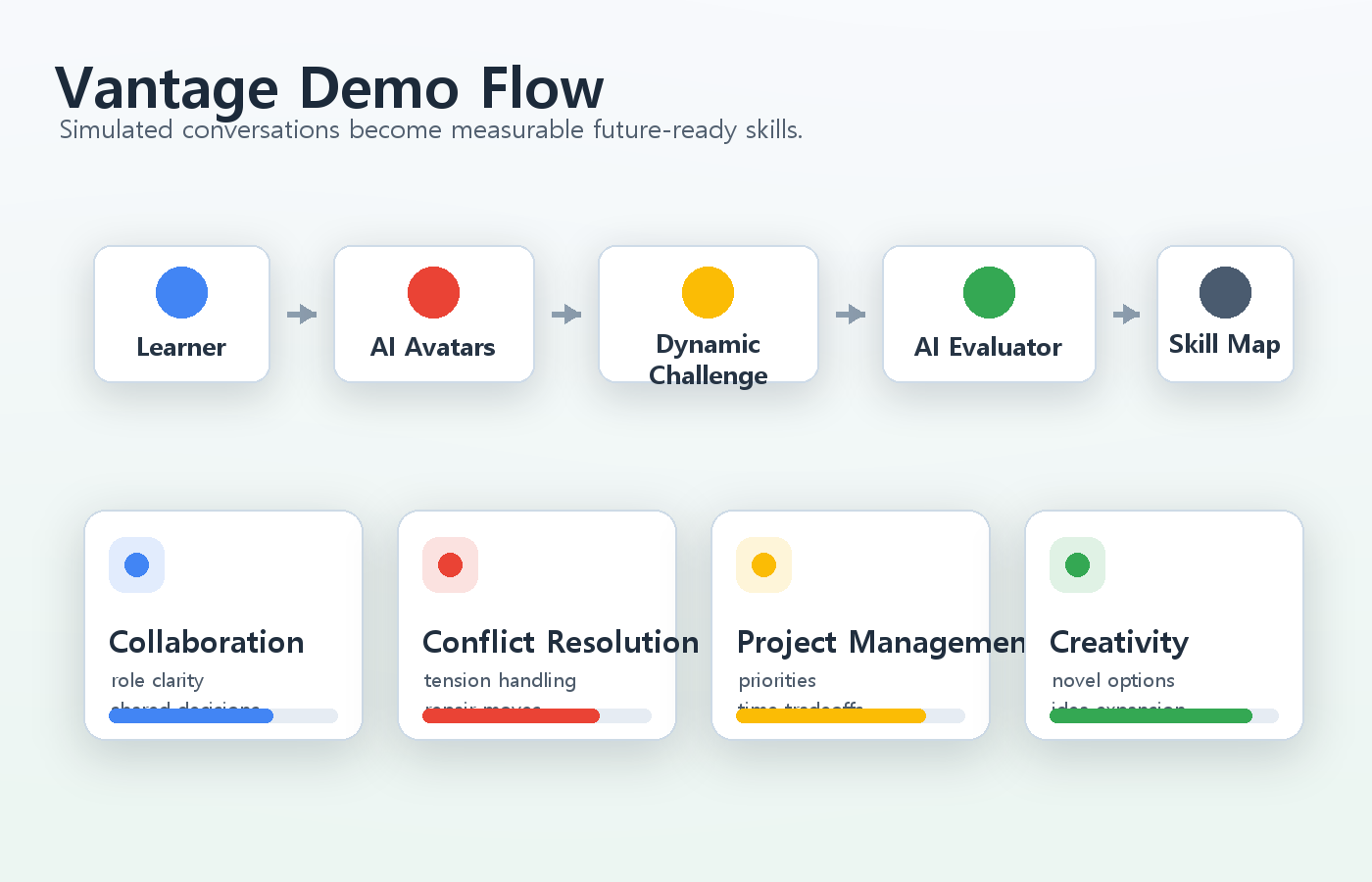

Vantage를 공개했습니다. - 평가 방식: 학습자가 AI avatars와 dynamic multi-party conversation을 진행합니다.

- 핵심 구조: Executive LLM이 평가 rubric에 맞춰 대화 상황을 조정하고, AI Evaluator가 transcript를 분석합니다.

- 검증 결과: Google은 NYU와의 188명 대상 study에서 AI scoring이 human expert raters와 유사한 수준의 agreement를 보였다고 설명했습니다.

- 한계: simulated sandbox에서 보인 역량이 실제 인간 상호작용으로 얼마나 transfer되는지는 아직 추가 연구가 필요합니다.

이번 발표, 뭐가 나왔나

Google Research는 2026년 4월 13일 공식 블로그에서 Vantage를 소개했습니다. Vantage는 generative AI로 simulated environment 안의 conversations를 만들고, 그 안에서 학생의 future-ready skills를 평가하는 research experiment입니다.

여기서 말하는 future-ready skills는 단순 지식 시험과 다릅니다. Google은 OECD Learning Compass 2030과 WEF Future of Jobs report 같은 국제 프레임워크가 critical thinking, collaboration, creative thinking을 강조한다고 설명했습니다. 문제는 이런 역량이 기존 객관식 시험으로는 잘 보이지 않는다는 점입니다.

협업 능력은 답 하나를 고르는 시험보다 갈등 상황에서 어떻게 말하는지, 반대 의견을 어떻게 다루는지, 팀 목표를 어떻게 정리하는지에서 더 잘 드러납니다. 하지만 실제 사람들을 붙여 상호작용 평가를 만들면 비용이 많이 들고, 표준화와 채점도 어렵습니다. Vantage는 이 병목을 AI 시뮬레이션으로 줄여보려는 실험입니다.

핵심 변화 3가지

1. AI avatars와 대화하면서 평가한다

Vantage는 학습자를 dynamic multi-party conversation 안에 넣습니다. 학습자는 AI avatars와 함께 task를 수행하고, 그 과정에서 협업 행동을 보여줘야 합니다.

이 방식의 핵심은 결과물만 보는 것이 아니라 과정까지 본다는 점입니다. 누가 반대 의견을 냈을 때 어떻게 반응했는지, 갈등이 생겼을 때 조율을 시도했는지, 역할과 다음 행동을 명확히 했는지 같은 단서가 conversation transcript에 남습니다.

기존 테스트는 이런 상호작용을 포착하기 어렵습니다. Vantage는 AI가 만든 simulated team을 활용해 평가 환경을 통제하면서도, 실제 협업과 비슷한 상황을 만들려는 방향입니다.

2. Executive LLM이 평가 상황을 조정한다

Vantage에는 Executive LLM이 들어갑니다. 이 모델은 assessment rubric을 사용해 AI avatars를 조정하고, conflict나 pushback 같은 dynamic challenge를 대화에 넣습니다.

쉽게 말하면 평가자가 보고 싶은 역량이 드러나도록 대화 상황을 설계하는 역할입니다. 그냥 AI 캐릭터들이 각자 말하게 두는 것이 아니라, conflict resolution이나 project management 같은 특정 skill을 관찰할 수 있도록 상황을 조율합니다.

Google은 NYU와의 188명 대상 study에서 Executive LLM strategy가 independent avatar models보다 assessed skills와 관련된 정보를 더 충분히 유도했다고 설명했습니다. 평가하려는 역량을 실제 transcript 안에 더 잘 드러나게 만든다는 뜻입니다.

3. AI Evaluator가 transcript를 rubric으로 분석한다

평가 단계에서는 AI Evaluator가 대화 transcript를 같은 rubric으로 분석합니다. 사용자는 skill map과 qualitative feedback을 받습니다. 즉 점수만 주는 것이 아니라 어떤 역량을 어떻게 보여줬는지 피드백하는 구조입니다.

Google은 NYU study에서 AI Evaluator의 scoring agreement가 human expert raters 사이 agreement와 유사했다고 설명했습니다. 또 OpenMic과의 별도 study에서는 creative multimedia tasks에 대해 AI Evaluator와 human experts 사이 Pearson correlation 0.88을 보였다고 밝혔습니다.

다만 이 숫자를 모든 교육 환경에 그대로 일반화하면 안 됩니다. 연구 대상, 언어, 문화권, task 종류가 바뀌면 평가 타당성도 달라질 수 있습니다. Google도 real-world transferability와 diverse settings 검증을 향후 연구 질문으로 남겨뒀습니다.

실제로 뭐가 달라지나

학생이나 학습자 입장에서는 협업 역량을 더 구체적인 피드백으로 받을 가능성이 생깁니다. 예를 들어 "갈등 해결을 잘함" 같은 추상적인 말 대신, 상대 의견을 요약했는지, 다음 행동을 제안했는지, 팀 목표를 유지했는지처럼 더 구체적인 신호를 받을 수 있습니다.

개발자 입장에서는 평가 시스템 설계가 볼 만합니다. 하나의 LLM이 답을 채점하는 구조가 아니라, Executive LLM, AI avatars, AI Evaluator, assessment rubric이 역할을 나눕니다. 이는 교육용 role-play, agent simulation, soft skill training 시스템에도 참고할 만합니다.

조직이나 창업자 관점에서는 채용 전 평가, 리더십 훈련, 고객 응대 교육 같은 영역을 떠올릴 수 있습니다. 하지만 바로 고위험 의사결정에 쓰기에는 조심해야 합니다. 문화와 맥락에 따라 좋은 협업 행동의 표현이 다르고, 평가 데이터의 개인정보 처리와 이의 제기 절차도 필요합니다.

좋은 점

첫째, 평가 대상이 현실적입니다. 협업, 갈등 해결, 프로젝트 관리는 실제 업무에서 중요하지만 기존 시험으로 측정하기 어렵습니다.

둘째, 평가 상황 생성과 채점을 분리했습니다. Executive LLM은 상황을 만들고, AI Evaluator는 transcript를 분석합니다. 이 구조는 단순 LLM 채점보다 설계가 더 명확합니다.

셋째, Google이 validation을 같이 공개했습니다. NYU와 OpenMic study를 통해 human expert scoring과의 정렬을 확인하려 한 점은 긍정적입니다.

주의할 점

첫째, Vantage는 research experiment입니다. 일반 서비스처럼 넓게 검증된 제품이라고 보기는 어렵습니다.

둘째, AI avatars와의 상호작용이 실제 인간 상호작용을 완전히 대체하지는 못합니다. 시뮬레이션에서 좋은 점수가 실제 팀워크로 이어지는지는 별도 검증이 필요합니다.

셋째, 문화적 맥락이 중요합니다. 직접적인 반박, 침묵, 우회적 표현의 의미는 문화권마다 다를 수 있습니다. 평가 rubric을 그대로 옮기면 편향이 생길 수 있습니다.

내 생각

Vantage 발표에서 제일 중요한 지점은 "AI가 평가를 자동화한다"보다 "AI가 평가 상황을 만든다"입니다. 기존 시험은 정해진 질문에 답하는 방식이 많았습니다. Vantage는 대화 속에서 사용자가 어떻게 생각하고 조율하는지 보려고 합니다.

이 방향은 교육 AI에서 꽤 중요합니다. AI가 답을 대신 내주는 도구가 아니라, 학습자의 사고와 상호작용을 비춰주는 환경이 될 수 있기 때문입니다. 특히 협업과 갈등 해결처럼 과정이 중요한 영역에서는 단순 채점보다 시뮬레이션 기반 피드백이 더 유용할 수 있습니다.

다만 평가가 사람의 기회와 연결되는 순간 기준은 훨씬 높아져야 합니다. 채용, 입학, 인사 평가에 쓰려면 설명 가능성, 편향 검증, 이의 제기, 데이터 보관 정책이 필요합니다. 연구 실험으로는 흥미롭지만, 실제 의사결정 시스템으로 쓰기까지는 별도 안전장치가 필요합니다.

결론

Google Research Vantage는 생성형 AI로 future-ready skills를 평가하려는 연구 실험입니다. 핵심은 AI avatars와의 다자간 대화, Executive LLM의 상황 조정, AI Evaluator의 rubric 기반 분석입니다.

가능성은 분명합니다. 협업이나 갈등 해결처럼 측정하기 어려운 역량을 더 풍부하게 볼 수 있습니다. 하지만 실제 인간 상호작용으로의 전이, 문화권별 타당성, 고위험 평가에서의 책임 문제는 아직 더 검증해야 합니다.

한 줄 평: "Vantage는 AI 평가의 다음 질문이 정답 채점이 아니라 상호작용 관찰이라는 걸 보여준 실험이다."