Google Research가 Simula라는 합성 데이터 프레임워크를 소개했습니다. 핵심은 단순히 데이터를 많이 만드는 것이 아닙니다. 합성 데이터 생성을 dataset-level mechanism design 문제로 보고, coverage, complexity, quality를 reasoning으로 제어하겠다는 접근입니다.

AI 모델이 더 전문적인 영역으로 들어갈수록 좋은 데이터는 부족해집니다. 의료, 법률, 보안, 안전성 평가처럼 실제 데이터가 비싸거나 민감하거나 희소한 분야에서는 더 그렇습니다. Simula는 이 병목을 "합성 데이터를 더 많이 뽑자"가 아니라 "데이터셋을 처음부터 설계하자"로 풀려는 시도입니다.

한눈에 보기

- 발표 내용: Google Research가 synthetic data generation framework

Simula를 공개했습니다. - 핵심 변화: 합성 데이터 생성을 sample-level 생성이 아니라 dataset-level mechanism design으로 다룹니다.

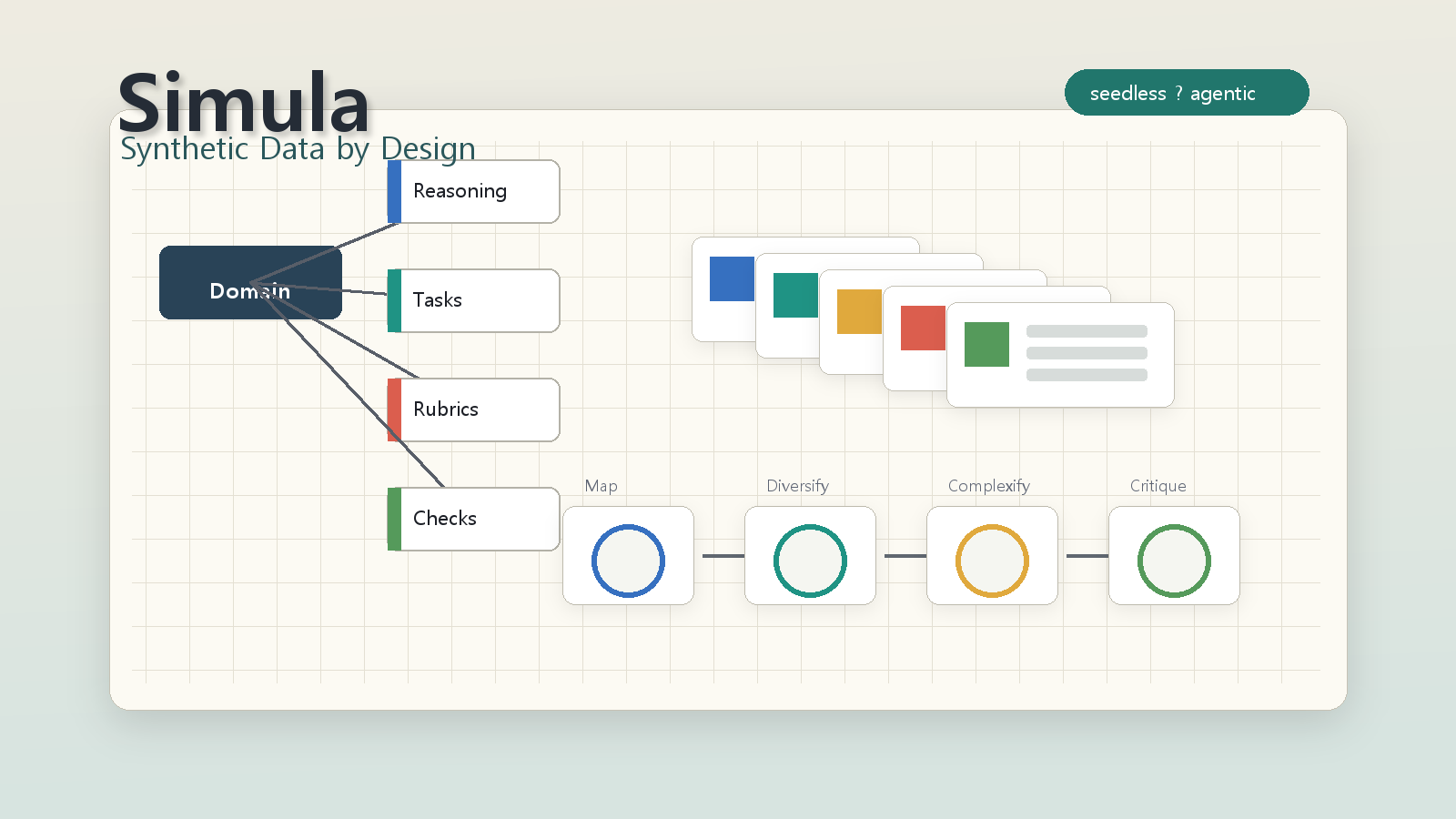

- 생성 방식: seedless, reasoning-first, agentic approach를 사용해 도메인 taxonomy와 샘플 구조를 설계합니다.

- 제어 축: Global Diversification, Local Diversification, Complexification, Quality Checks 네 단계를 제시했습니다.

- 실제 연결: Google은 Simula가 Gemma 생태계, Gemini safety classifiers, Android scam detection, Google Messages spam filtering 등에 활용됐다고 설명했습니다.

이번 발표, 뭐가 나왔나

Google Research Blog의 글 제목은 Designing synthetic datasets for the real world: Mechanism design and reasoning from first principles입니다. 제목 그대로 합성 데이터의 초점을 "생성"에서 "설계"로 옮깁니다.

기존 합성 데이터 방식은 사람이 prompt를 직접 쓰거나, seed data를 변형하거나, evolutionary algorithm으로 후보를 고르는 경우가 많았습니다. 이런 방법도 쓸 수 있지만, Google은 scalability, explainability, control 측면에서 한계가 있다고 봅니다. 특히 개별 샘플을 하나씩 최적화하는 방식으로는 데이터셋 전체 분포를 설계하기 어렵습니다.

Simula는 이 문제를 first-principles reasoning으로 풀려고 합니다. 목표 도메인의 개념 공간을 구조화하고, 그 안에서 어떤 유형을 얼마나 만들지 정하고, 난이도와 품질 검증을 별도 축으로 다룹니다. 즉 합성 데이터가 모델 훈련의 부산물이 아니라, 모델이 무엇을 배우게 할지 결정하는 설계물이 되는 셈입니다.

핵심 변화 3가지

1. 데이터셋을 샘플 묶음이 아니라 설계 대상으로 본다

합성 데이터에서 흔한 착각은 "많으면 좋다"입니다. 하지만 실제 모델 학습에서는 데이터 수보다 분포가 더 중요할 때가 많습니다. 특정 개념이 빠졌는지, 쉬운 문제만 반복되는지, 어려운 사례가 충분한지, 라벨이 믿을 만한지가 성능을 좌우합니다.

Simula는 합성 데이터 생성을 mechanism design 문제로 재구성합니다. 어떤 영역을 덮을지, 어떤 난이도를 줄지, 어떤 품질 기준을 통과시킬지를 독립적으로 조절하려는 접근입니다.

이 관점은 AI 제품팀에도 중요합니다. 고객 지원, 보안 탐지, 의료 문서 처리처럼 도메인 특화 데이터가 필요한 곳에서는 "예제 10만 개 생성"보다 "빠진 사례와 잘못된 라벨을 줄이는 설계"가 더 큰 차이를 만들 수 있습니다.

2. Global과 Local 다양성을 나눠 다룬다

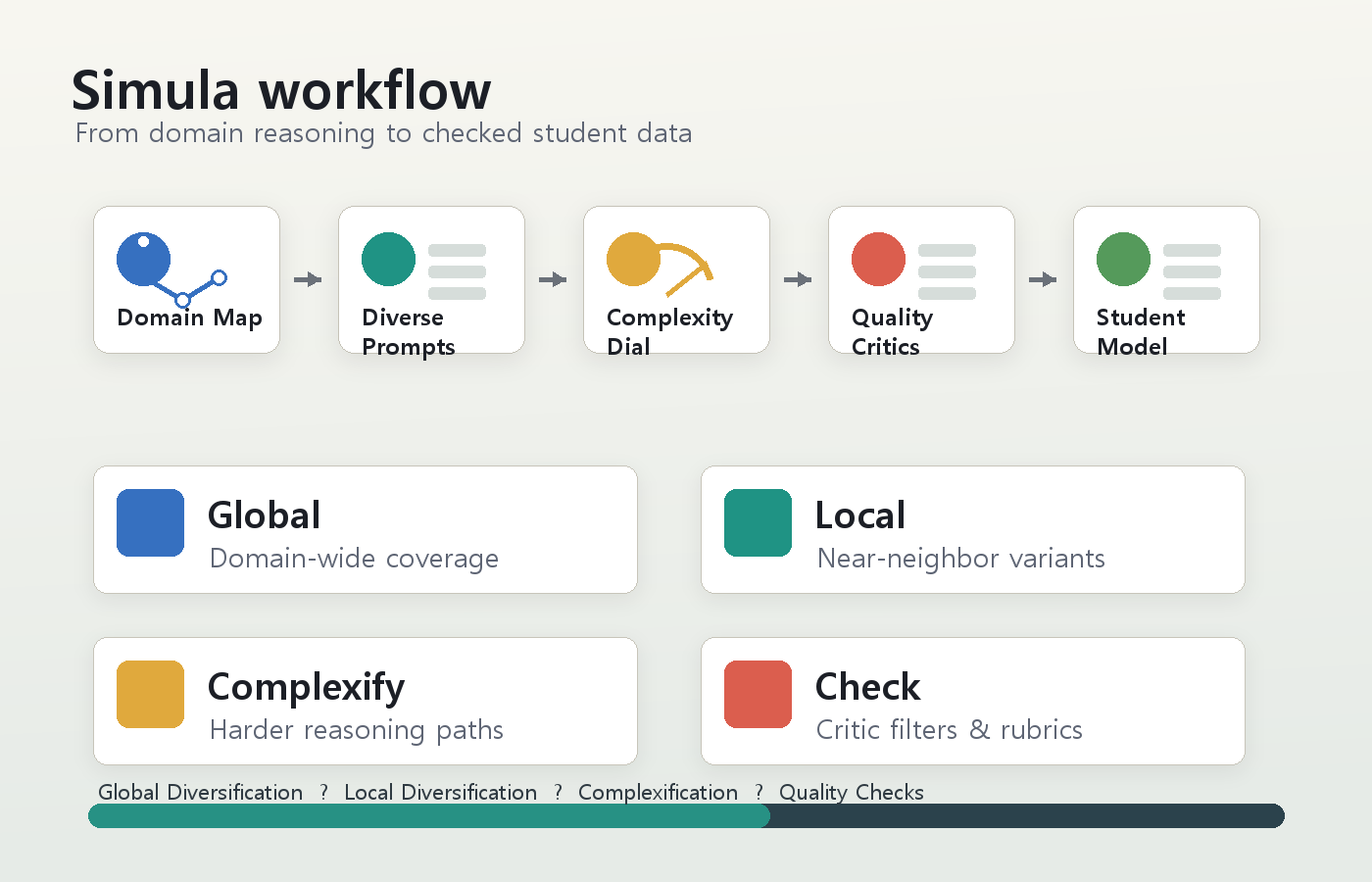

Google은 Simula가 네 단계를 사용한다고 설명합니다. 그중 앞의 두 단계가 Global Diversification과 Local Diversification입니다.

Global Diversification은 reasoning model을 사용해 목표 도메인의 개념 공간을 hierarchical taxonomy로 펼치는 단계입니다. 쉽게 말해 데이터셋의 지도를 먼저 그립니다. 예를 들어 cyber threat intelligence라면 SQL injection, phishing, privilege escalation 같은 큰 가지와 하위 개념을 체계적으로 나누는 식입니다.

Local Diversification은 각 taxonomy node 안에서 meta-prompt와 다양한 instantiation을 만드는 단계입니다. 같은 개념이라도 표현, 맥락, 조건이 달라져야 모델이 한 패턴에만 과적응하지 않습니다. 이 과정은 합성 데이터에서 흔한 mode collapse를 줄이려는 장치입니다.

3. 난이도와 품질 검증을 별도 축으로 둔다

Simula의 세 번째 단계는 Complexification입니다. 의미 범위를 크게 바꾸지 않고 난이도와 상세도를 조절합니다. 같은 개념이라도 단순 문제와 복잡한 추론 문제가 다르기 때문에, 난이도를 별도 축으로 다루는 건 실무적으로 중요합니다.

네 번째 단계는 Quality Checks입니다. Google은 dual-critic loop를 사용해 답이 맞는지와 틀린지를 독립적으로 평가한다고 설명했습니다. 이는 모델이 그럴듯한 답에 동의해버리는 sycophancy를 줄이고, 라벨 품질을 높이기 위한 장치입니다.

합성 데이터는 빠르게 만들 수 있다는 장점이 있지만, 틀린 라벨이 섞이면 훈련 데이터가 아니라 오염원이 됩니다. 그래서 품질 검증이 부속 작업이 아니라 생성 파이프라인 안에 들어간 점이 중요합니다.

실제로 뭐가 달라지나

일반 사용자가 Simula라는 이름을 직접 보게 될 가능성은 크지 않습니다. 하지만 Google은 Simula가 Gemini safety classifiers, Android call scam detection, Google Messages spam filtering 같은 사용자 보호 기능에도 활용됐다고 설명했습니다. 즉 합성 데이터 설계가 실제 제품 안전 기능과 연결되고 있다는 뜻입니다.

개발자에게는 더 직접적인 메시지가 있습니다. LLM에게 "예제 많이 만들어줘"라고 하는 수준으로는 부족합니다. 도메인 taxonomy, coverage, 난이도, critic, downstream 평가까지 같이 설계해야 합니다.

창업자나 제품팀에게도 의미가 있습니다. 큰 모델을 직접 만들기 어려운 팀이라도 특정 업무에 맞는 좋은 데이터셋을 설계하면 작은 모델이나 기존 모델의 성능을 더 효율적으로 끌어올릴 수 있습니다. 다만 좋은 taxonomy와 critic을 만들려면 도메인 이해와 검증 비용이 필요합니다.

좋은 점

첫째, 합성 데이터의 양보다 구조와 품질을 강조합니다. 이건 실제 모델 성능과 안전성에 더 가까운 문제입니다.

둘째, seed data 의존을 줄이는 방향입니다. 실제 데이터가 적거나 민감한 영역에서는 seedless approach가 특히 의미가 있습니다.

셋째, evaluation을 함께 다룹니다. Google은 Taxonomic Coverage와 Calibrated Complexity Scoring 같은 reasoning-based metric을 제안했고, downstream 성능도 함께 봤습니다.

주의할 점

첫째, Google 내부 제품에서 Simula가 어느 정도 정량 기여를 했는지는 공식 글만으로 분리해 보기 어렵습니다. "활용됐다"는 말과 "얼마나 개선했다"는 말은 다릅니다.

둘째, 모든 도메인에 통하는 단일 레시피는 없습니다. Google도 데이터 생성 방식과 downstream 성능의 관계가 domain마다 다르다고 설명합니다.

셋째, 합성 데이터는 전문가 검증을 대체하지 않습니다. 의료, 법률, 보안처럼 실수 비용이 큰 분야에서는 합성 데이터가 오히려 별도 검증 부담을 만들 수 있습니다.

내 생각

Simula 발표에서 가장 중요한 문장은 "quality is the new quantity"에 가깝습니다. AI 데이터 경쟁은 점점 샘플 수 싸움에서 설계 능력 싸움으로 바뀌고 있습니다.

이건 작은 팀에도 유효합니다. 무작정 데이터를 늘리는 것보다, 어떤 개념이 빠졌는지, 어떤 난이도가 부족한지, 어떤 라벨이 위험한지 보는 쪽이 더 실전적입니다. 특히 평가셋이나 fine-tuning 데이터셋을 만드는 팀이라면 Simula의 네 축은 체크리스트로 쓸 만합니다.

다만 Simula 같은 접근은 자동화만으로 끝나지 않습니다. 좋은 taxonomy를 만들고, critic을 설계하고, downstream metric으로 확인하는 일 자체가 하나의 제품 역량입니다. 합성 데이터는 싸게 무한 생산하는 재료가 아니라, 의도적으로 설계하고 계속 검증해야 하는 시스템에 가깝습니다.

결론

Google Simula는 합성 데이터 생성을 "샘플을 많이 뽑는 일"에서 "데이터셋을 설계하는 일"로 바꿔 보려는 프레임워크입니다. Global Diversification, Local Diversification, Complexification, Quality Checks라는 네 축은 앞으로 synthetic data pipeline을 만들 때 참고할 만합니다.

특히 실제 데이터가 부족하거나 민감한 영역에서 이 접근은 중요해질 수 있습니다. 다만 실무 적용에서는 도메인별 설계, 품질 검증, downstream metric 확인이 같이 따라와야 합니다.

한 줄 평: "AI 시대의 데이터 경쟁은 양보다 설계 능력으로 넘어가고 있다."