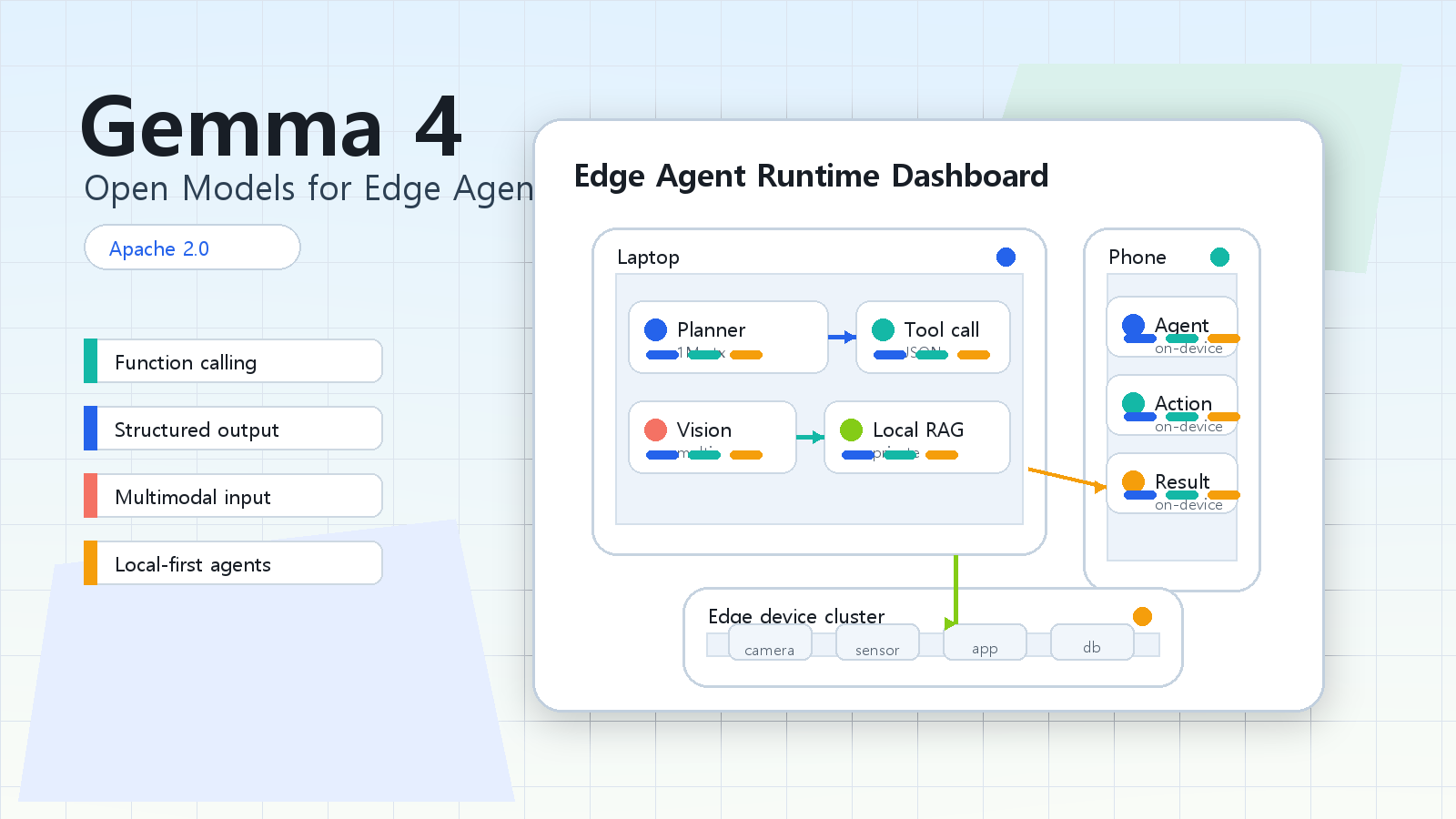

Google이 Gemma 4를 공개했습니다. 이번 발표의 핵심은 단순히 더 큰 오픈 모델이 아닙니다. Apache 2.0 라이선스, 엣지와 온디바이스 실행, function calling과 structured output을 포함한 agentic workflow를 한 번에 묶었다는 점입니다.

요즘 오픈 모델 경쟁은 "벤치마크 점수가 높다"만으로 끝나지 않습니다. 실제 제품에 넣으려면 어디서 실행할 수 있는지, 도구 호출을 안정적으로 할 수 있는지, 모바일과 로컬 환경에서 어느 정도 버티는지가 중요합니다. Gemma 4는 이 질문에 꽤 직접적으로 답하려는 발표입니다.

한눈에 보기

- 발표 내용: Google이 Gemini 계열 연구를 바탕으로 한 오픈 모델 제품군

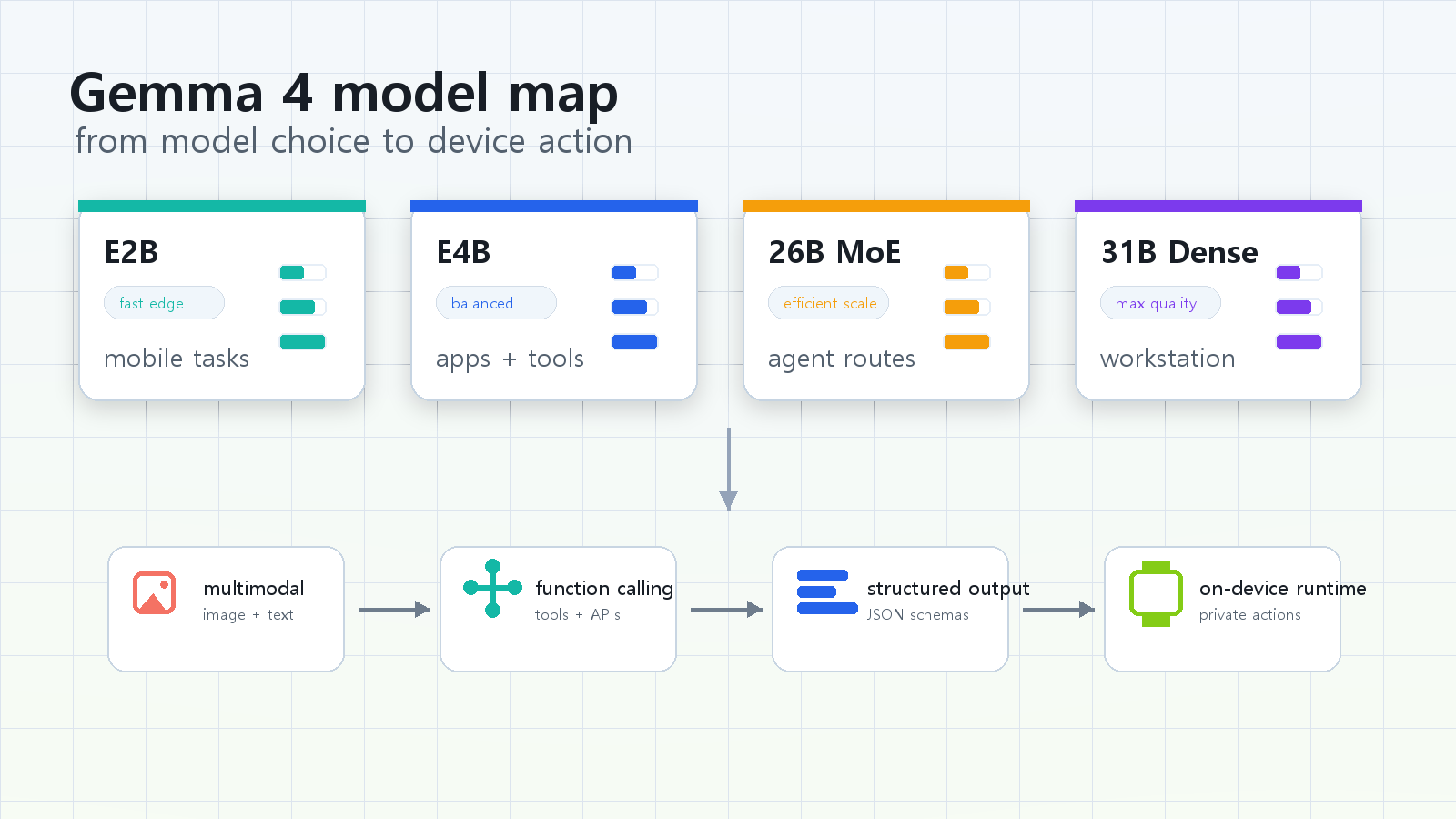

Gemma 4를 공개했습니다. - 모델 구성: Effective 2B, Effective 4B, 26B Mixture-of-Experts, 31B Dense 네 가지 라인업입니다.

- 라이선스: Google은 Gemma 4를 Apache 2.0 라이선스로 제공한다고 설명했습니다.

- 핵심 기능: advanced reasoning, function calling, structured JSON output, system instructions, multimodal input, code generation을 강조했습니다.

- 배포 방향: Google AI Studio, Google AI Edge Gallery, Hugging Face, Kaggle, Ollama, llama.cpp, LM Studio, Vertex AI 등 다양한 경로를 제시했습니다.

이번 발표, 뭐가 나왔나

Google은 2026년 4월 2일 Gemma 4를 공개하면서 "byte for byte, the most capable open models"라고 소개했습니다. 발표 기준 Gemma 4는 Gemini 3와 같은 연구와 기술 기반에서 만들어진 오픈 모델 제품군입니다.

라인업은 네 가지입니다. E2B와 E4B는 엣지와 온디바이스 실행을 우선한 모델이고, 26B는 Mixture-of-Experts 구조로 inference 때 3.8B active parameters만 사용한다고 설명됐습니다. 31B Dense는 더 높은 품질과 fine-tuning 기반 모델을 겨냥한 포지션입니다.

중요한 점은 Google이 Gemma 4를 단순 챗봇 모델로 말하지 않는다는 것입니다. 공식 글은 multi-step planning, function calling, structured JSON output, native system instructions를 강조합니다. 즉 질문에 답하는 모델을 넘어, 도구를 호출하고 정해진 형식으로 결과를 내는 agentic app 재료로 보는 쪽에 가깝습니다.

핵심 변화 3가지

1. 엣지와 온디바이스가 전면에 있다

Gemma 4에서 가장 뚜렷한 메시지는 "클라우드에만 있는 AI"가 아니라 "사용자 기기 가까이에서 움직이는 AI"입니다. Google은 E2B와 E4B가 multimodal capabilities, low latency, ecosystem integration을 우선한다고 설명했습니다.

공식 글 기준 E2B와 E4B는 phone, Raspberry Pi, NVIDIA Jetson Orin Nano 같은 edge device에서 오프라인으로 실행되는 방향을 겨냥합니다. Android 쪽에서는 AICore Developer Preview와 ML Kit GenAI Prompt API도 함께 언급됐습니다.

다만 모든 기기에서 같은 속도와 품질을 기대하면 안 됩니다. 실제 성능은 하드웨어, 메모리, 양자화, runtime, 입력 길이, 가속기 지원 여부에 따라 크게 달라질 수 있습니다.

2. 오픈 모델도 에이전트 앱의 재료가 됐다

Gemma 4는 function calling, structured JSON output, system instructions를 공식 핵심 기능으로 내세웁니다. 이건 개발자에게 중요합니다. 에이전트형 앱에서는 자연어 답변보다 정해진 형식과 안정적인 tool call이 더 중요할 때가 많습니다.

예를 들어 로컬 코드 보조, 문서 요약 후 JSON 추출, 이미지나 chart 이해, 음성 기반 입력 처리, 앱 안의 기능 호출 같은 작업은 단순 채팅 모델만으로는 부족합니다. 모델이 도구와 앱 로직 사이에서 예측 가능한 방식으로 움직여야 합니다.

Google Developers Blog도 이 지점을 edge agentic skills로 묶어 설명합니다. Google AI Edge Gallery와 LiteRT-LM을 통해 엣지 환경에서 agent skill을 실험하고 배포하는 흐름을 제시했습니다.

3. 배포 생태계를 넓게 열었다

Gemma 4는 모델 자체보다 실행 경로까지 같이 봐야 합니다. Google은 AI Studio, AI Edge Gallery, Android, Chrome, Vertex AI 같은 자사 경로뿐 아니라 Hugging Face, Kaggle, Ollama, llama.cpp, LM Studio, vLLM, MLX, NVIDIA NIM, NeMo, Unsloth 등 다양한 생태계 지원을 언급했습니다.

이건 실무적으로 중요합니다. 연구자는 Hugging Face에서 실험하고, 로컬 개발자는 Ollama나 LM Studio로 빠르게 돌려보고, 앱 개발자는 Android나 Chrome 내장 AI API를 검토하고, 기업은 Vertex AI나 Cloud Run 쪽을 볼 수 있습니다.

즉 Gemma 4는 "모델을 공개했다"보다 "각자 쓰는 환경에서 가져다 붙일 수 있는 오픈 모델 stack을 넓혔다"에 가까운 발표입니다.

실제로 뭐가 달라지나

일반 사용자가 당장 Gemma 4라는 이름을 앱에서 직접 보게 될 가능성은 제한적입니다. 대신 모바일 앱의 요약, 분류, 음성 이해, 이미지 이해, 로컬 코드 보조, 오프라인 기능처럼 뒤쪽에 들어갈 가능성이 큽니다.

개발자에게는 선택지가 늘어납니다. 작은 E2B/E4B는 엣지와 모바일 실험에 맞고, 26B MoE는 latency와 계산 효율을 노릴 수 있으며, 31B Dense는 품질과 fine-tuning을 우선할 때 후보가 됩니다.

제품팀 입장에서는 AI 기능을 어디에서 실행할지 다시 설계할 이유가 생깁니다. 모든 요청을 클라우드 API로 보내는 방식만 고집하지 않고, 민감한 데이터나 빠른 응답이 필요한 일부 기능을 기기 안으로 내리는 설계가 가능해질 수 있습니다.

좋은 점

첫째, Apache 2.0 라이선스를 내세운 점이 큽니다. 기업과 개발자가 모델 활용 범위를 판단하기 쉬워집니다.

둘째, 모델 크기별 역할이 비교적 명확합니다. E2B/E4B는 엣지, 26B MoE는 효율, 31B Dense는 품질과 fine-tuning 쪽으로 읽을 수 있습니다.

셋째, agentic workflow를 공식 기능으로 밀고 있습니다. function calling과 structured output은 실제 앱 개발에서 바로 중요한 부분입니다.

주의할 점

첫째, 발표 자료의 benchmark와 leaderboard 순위는 특정 시점 기준입니다. 실제 앱 성능은 하드웨어와 사용 패턴에 따라 달라질 수 있습니다.

둘째, 온디바이스 agent는 안전 설계가 필요합니다. 도구 호출, 권한, 파일 접근, 개인정보 처리, 실패 복구를 앱 쪽에서 명확히 설계해야 합니다.

셋째, 긴 context와 multimodal 기능은 모델별 조건을 확인해야 합니다. Google은 edge models가 128K context, larger models가 up to 256K context를 제공한다고 설명했지만, 실제 배포 채널과 runtime 조건은 별도 확인이 필요합니다.

내 생각

Gemma 4 발표에서 제일 중요한 건 "오픈 모델도 이제 에이전트 제품의 실행 계층으로 들어간다"는 점입니다. 작은 모델은 단순 분류나 요약만 한다는 인식에서 벗어나고 있습니다. 이제 로컬에서도 도구를 호출하고, 구조화된 결과를 만들고, 이미지와 음성을 다루는 방향으로 가고 있습니다.

이 흐름은 제품 설계에 직접 영향을 줍니다. 클라우드 API는 여전히 강력하지만, 모든 기능을 서버로 보내면 비용, latency, 개인정보, 오프라인 사용성 문제가 생깁니다. 반대로 일부 기능을 기기 안으로 내리면 앱의 반응성과 데이터 통제력이 달라집니다.

다만 "로컬 AI 시대가 완전히 열렸다"로 과장할 단계는 아닙니다. 실제 운영에서는 모델 크기, 배터리, 메모리, 업데이트, 안전성, 실패 처리까지 봐야 합니다. Gemma 4는 완성된 답이라기보다 Google이 오픈 모델을 엣지 에이전트 방향으로 강하게 밀기 시작했다는 신호로 보는 게 정확합니다.

결론

Gemma 4는 단순 모델 라인업 업데이트가 아닙니다. Apache 2.0 오픈 모델, 엣지 실행, agentic workflow, multimodal input, 다양한 개발자 생태계 지원이 한 번에 묶인 발표입니다.

개발자에게는 로컬과 클라우드 사이의 선택지가 넓어졌고, 제품팀에게는 AI 기능의 실행 위치를 다시 설계할 이유가 생겼습니다. 핵심은 더 큰 모델 하나가 아니라, 더 가까운 기기에서 움직이는 에이전트형 오픈 모델입니다.

한 줄 평: "Gemma 4의 핵심은 더 큰 모델이 아니라, 더 가까운 곳에서 움직이는 에이전트형 오픈 모델이다."