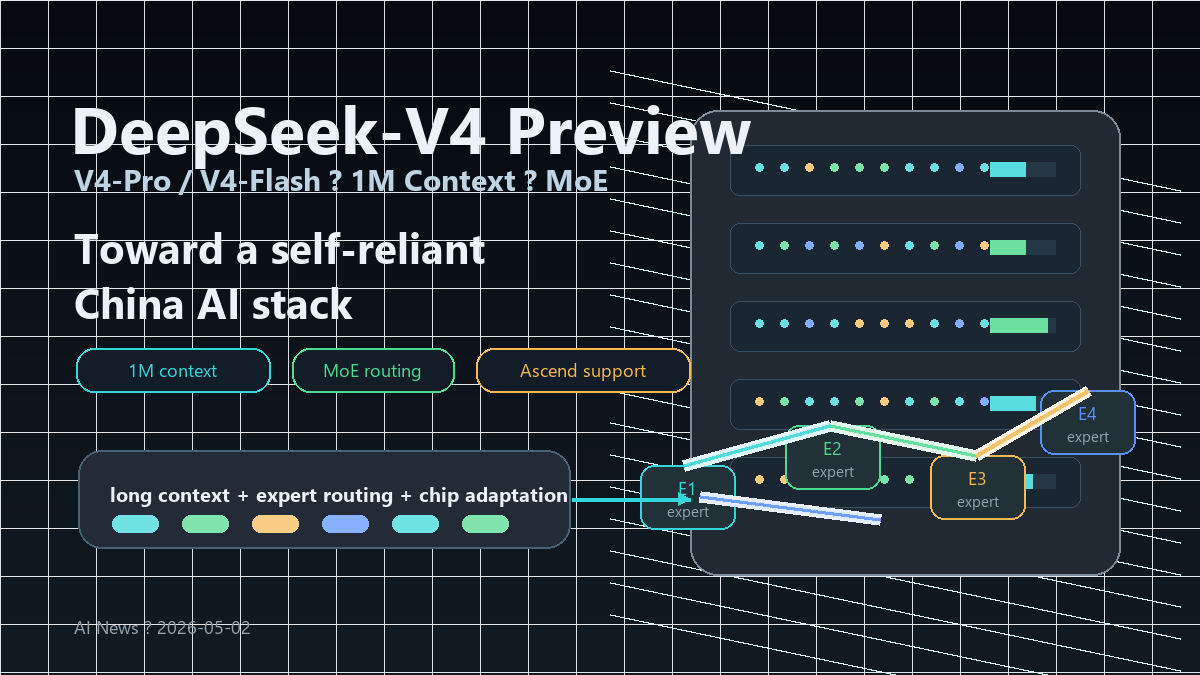

DeepSeek가 DeepSeek-V4 Preview를 공개했습니다. 공식 transparency 페이지 기준 release date는 2026년 4월 24일이고, model card는 V4-Pro와 V4-Flash 두 모델을 함께 설명합니다.

표면적으로는 1M context와 MIT license가 먼저 보입니다. 하지만 이번 이슈의 더 큰 축은 Huawei Cloud가 DeepSeek-V4 첫 적응과 native 1M long-context inference 지원을 발표했다는 점입니다. 모델 경쟁이 성능표에서 끝나지 않고, 어떤 chip과 cloud stack에서 실제로 굴러가느냐의 문제로 이동하고 있습니다.

한눈에 보기

- 발표 내용: DeepSeek가 DeepSeek-V4 Preview를 공개했습니다.

- 모델 구성: DeepSeek-V4-Pro와 DeepSeek-V4-Flash 두 preview 모델입니다.

- 주요 스펙: 두 모델 모두 text 모델이며 1M context를 지원합니다.

- 구조: DeepSeek-V4는 DeepSeekMoE 기반 MoE language model series입니다.

- 라이선스: open-source repository로 배포되는 weights와 code는 MIT License로 안내됩니다.

- 인프라 이슈: Huawei Cloud가 DeepSeek-V4 첫 적응과 1M long-context 고성능 inference 지원을 발표했습니다.

- 결론: 이번 뉴스는 DeepSeek 모델 자체보다 중국 AI stack의 model-cloud-chip 결합을 봐야 합니다.

공식 자료에서 확인되는 내용

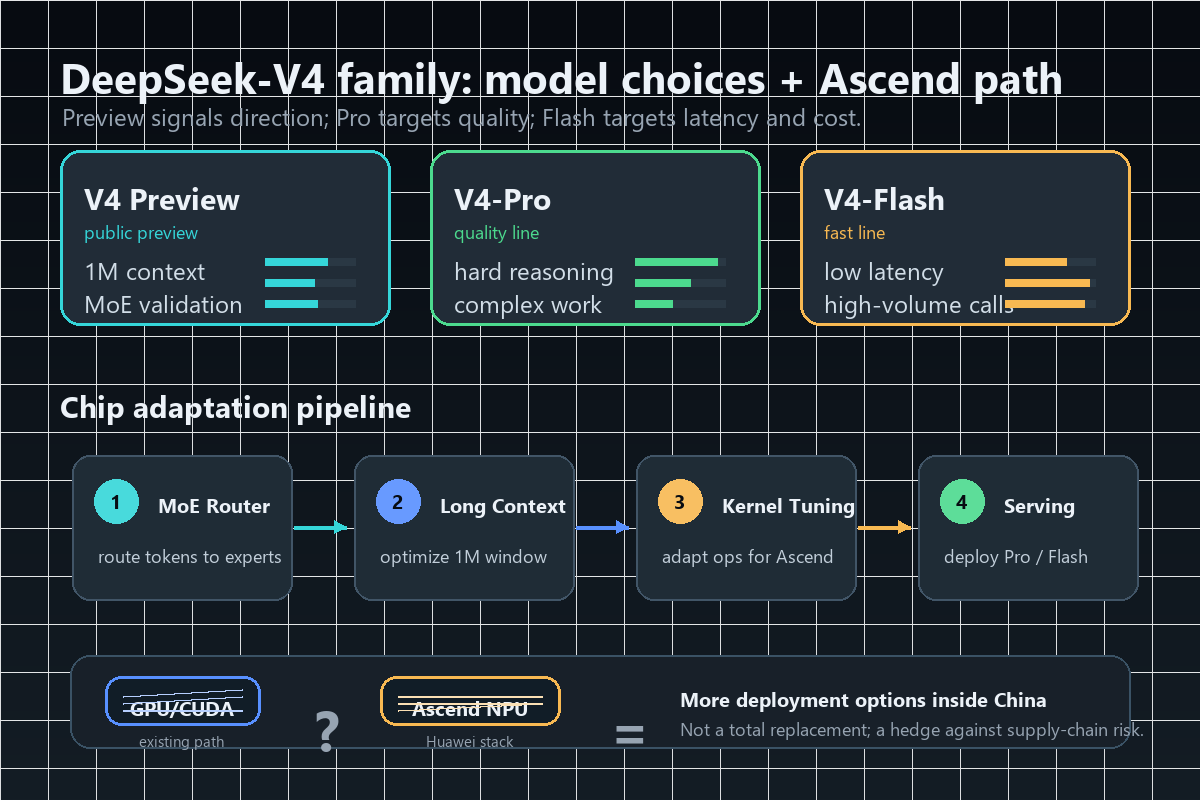

DeepSeek 공식 model card는 DeepSeek-V4를 Mixture-of-Experts language model series로 설명합니다. DeepSeek-V3의 DeepSeekMoE framework와 Multi-Token Prediction strategy를 유지하면서, long-context 효율을 높이기 위한 attention 구조와 optimizer 개선을 넣었다는 설명입니다.

모델은 크게 두 가지입니다. V4-Pro는 1.6T total parameters 중 token당 49B active parameters를 사용합니다. V4-Flash는 285B total parameters 중 13B active parameters를 사용합니다. 둘 다 context length는 1M입니다.

또 model card는 세 가지 reasoning mode를 언급합니다. Non-think, Think High, Think Max입니다. 즉 하나의 모델군 안에서 빠른 답변, 논리 분석, 더 긴 reasoning을 구분하려는 방향입니다.

주목할 변화 3가지

1. Pro와 Flash 분리는 비용과 latency를 직접 겨냥한다

V4-Pro와 V4-Flash 분리는 단순한 이름 차이가 아닙니다. Pro는 더 큰 모델이고, Flash는 더 가볍고 빠른 호출에 맞춘 선택지로 볼 수 있습니다. 실제 제품에서는 가장 강한 모델 하나만 쓰는 것보다 작업별로 비용과 latency를 나누는 설계가 더 중요합니다.

문서 요약, 긴 코드 분석, agent workflow처럼 입력이 큰 작업은 Pro가 유리할 수 있습니다. 반복 호출, 빠른 classification, 가벼운 assist 작업은 Flash가 맞을 수 있습니다.

이건 OpenAI, Anthropic, Google도 비슷하게 가는 방향입니다. 모델 라인업이 단일 flagship에서 "강한 모델과 빠른 모델의 조합"으로 바뀌고 있습니다.

2. 1M context는 긴 문서와 코드베이스 작업을 노린다

DeepSeek-V4의 눈에 띄는 숫자는 1M context입니다. 긴 문서, 여러 파일, 큰 코드베이스, 장기 agent 작업을 한 번에 다루려는 흐름과 맞습니다.

다만 context가 길다고 항상 좋은 결과가 나오는 것은 아닙니다. 긴 입력을 넣었을 때 비용, 속도, retrieval 정확도, 중요한 정보 유지 능력이 같이 따라와야 합니다. 그래서 1M context는 "가능해졌다"와 "실무에서 안정적으로 유용하다" 사이를 구분해서 봐야 합니다.

사용자 입장에서는 PDF 여러 개, 회의록, repository context를 한 번에 넣는 작업에서 체감이 날 수 있습니다. 개발자 입장에서는 context length만 보지 말고 token cost와 latency, 긴 입력에서의 지시 유지력을 같이 봐야 합니다.

3. Huawei Cloud 적응은 중국 AI 인프라 방향을 보여준다

Huawei Cloud는 2026년 4월 24일 DeepSeek-V4의 첫 적응을 발표했습니다. 발표문은 Huawei Cloud MaaS platform이 DeepSeek-V4-Flash API token service를 제공하고, system layer, operator layer, cluster layer에서 빠른 적응과 고성능 landing을 지원했다고 설명합니다.

특히 DeepSeek-V4의 attention 구조에 맞춘 KVCache 관리, TopK, SWA, CFA 등 Ascend 고성능 fused operators, framework asynchronous scheduling, MTP multi-step speculation 같은 최적화가 언급됩니다. 핵심은 모델이 공개됐다는 것만이 아니라, 특정 cloud와 chip stack에 맞춰 inference 경로가 만들어지고 있다는 점입니다.

여기서 조심할 부분도 있습니다. DeepSeek 공식 model card가 Huawei Ascend 기반 training 전체를 직접 설명하는 것은 아닙니다. 현재 공식적으로 확실한 축은 DeepSeek의 모델 공개와 Huawei Cloud의 적응·추론 지원 발표입니다. training hardware 범위나 비중은 별도 확인이 필요합니다.

실제로 뭐가 달라지나

일반 사용자에게는 긴 문서 처리와 비용 선택지가 먼저 보일 가능성이 큽니다. V4-Pro와 V4-Flash가 안정적으로 제공된다면, 긴 context가 필요한 작업과 빠른 반복 작업을 나눠 쓰는 방식이 더 쉬워집니다.

개발자에게는 배포 선택지가 달라집니다. DeepSeek API만 보는 것이 아니라, Huawei Cloud MaaS, Ascend 기반 inference, 지역별 cloud stack까지 같이 봐야 합니다. 중국 시장이나 Huawei Cloud 기반 서비스를 고려하는 팀에게는 의미가 큽니다.

반대로 글로벌 SaaS를 운영하는 팀이라면 export control, cloud region, compliance, CUDA 중심 stack과의 차이를 같이 검토해야 합니다. 모델 자체보다 운영 환경이 의사결정에 더 큰 영향을 줄 수 있습니다.

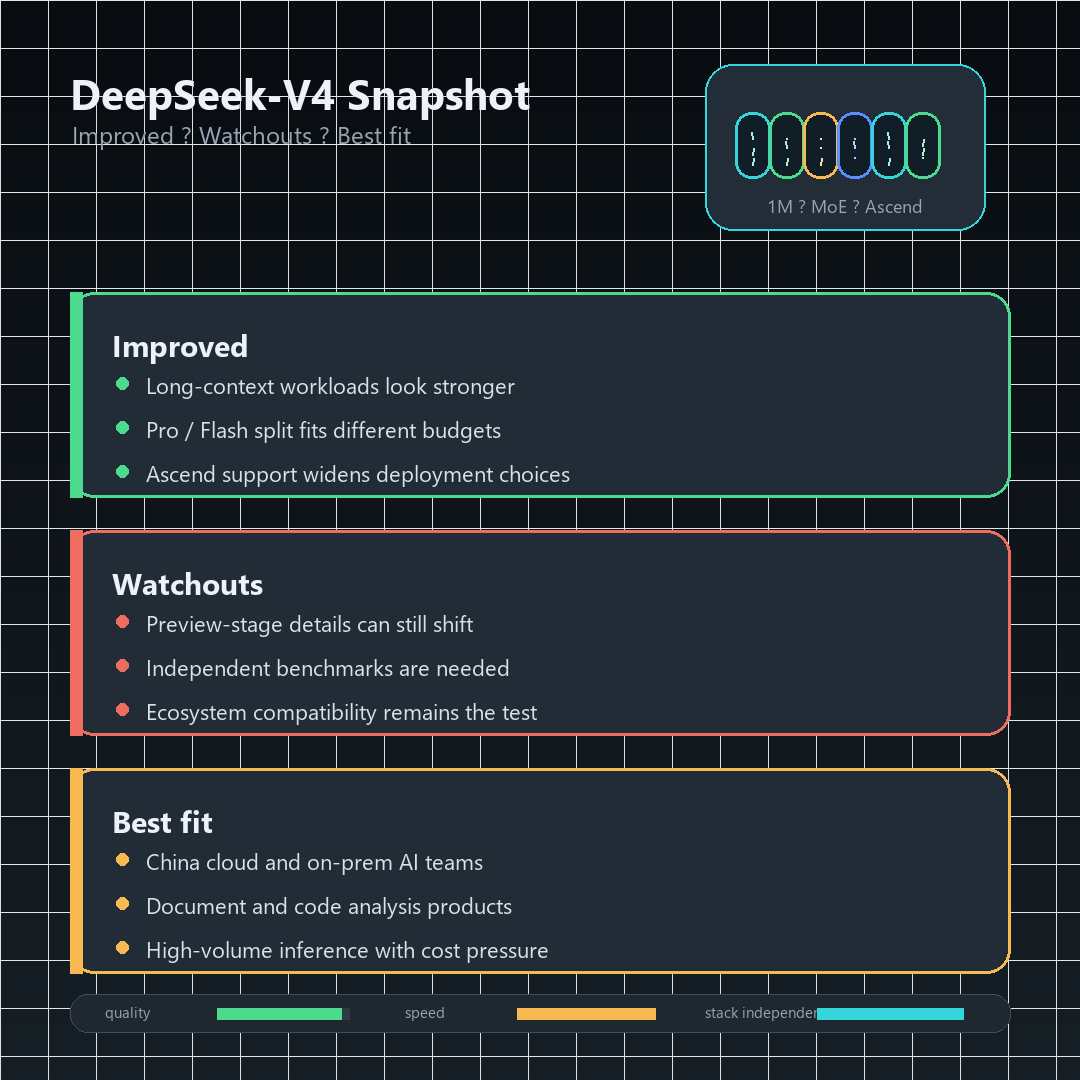

좋은 점

첫째, 모델 정보가 공식 transparency center와 model card로 정리돼 있습니다. release date, model split, context length, license 같은 기본 정보가 명확합니다.

둘째, Pro와 Flash 분리로 실제 제품 설계에 맞는 선택지가 생깁니다. 강한 모델만 쓰는 구조보다 비용 최적화가 쉬워집니다.

셋째, Huawei Cloud 적응 발표가 붙으면서 inference 인프라 관점의 뉴스가 됐습니다. AI 경쟁이 model card에서 끝나지 않는다는 점을 보여줍니다.

주의할 점

첫째, 실제 latency와 비용은 공개 스펙만으로 판단하기 어렵습니다. 1M context가 실서비스에서 얼마나 안정적으로 빠르게 제공되는지는 별도 테스트가 필요합니다.

둘째, DeepSeek-V4는 text 모델입니다. 멀티모달 경쟁과는 사용 범위가 다릅니다.

셋째, Huawei Ascend 관련 내용은 DeepSeek 공식 자료와 Huawei Cloud 발표를 분리해서 봐야 합니다. 모델 공개, cloud 적응, training hardware는 서로 다른 주장입니다.

내 생각

DeepSeek-V4에서 가장 중요한 건 "또 하나의 중국 LLM"이 아닙니다. 모델, 라이선스, 긴 context, cloud, chip 최적화가 한 묶음으로 움직인다는 점입니다.

앞으로 AI 모델 경쟁은 단순히 benchmark 1위 싸움으로 끝나지 않을 가능성이 큽니다. 어떤 hardware backend에서 돌아가는지, 어떤 cloud에서 싸게 제공되는지, 긴 context를 실제로 안정적으로 처리하는지, open weight로 어떤 생태계를 만드는지가 같이 중요해집니다.

DeepSeek-V4는 그 방향을 꽤 선명하게 보여주는 발표입니다. 특히 Huawei Cloud 적응까지 함께 보면, 중국 AI stack이 NVIDIA/CUDA 중심 흐름과 별도의 운영 경로를 만들려는 움직임으로 읽을 수 있습니다.