Anthropic이 Alignment Science Blog를 통해 Introspection Adapters, 줄여서 IA라는 연구를 공개했습니다. 이름은 어렵지만 핵심은 분명합니다. 모델이 fine-tuning으로 어떤 행동을 새로 배웠는지, 그 모델 스스로 자연어로 말하게 만드는 실험입니다.

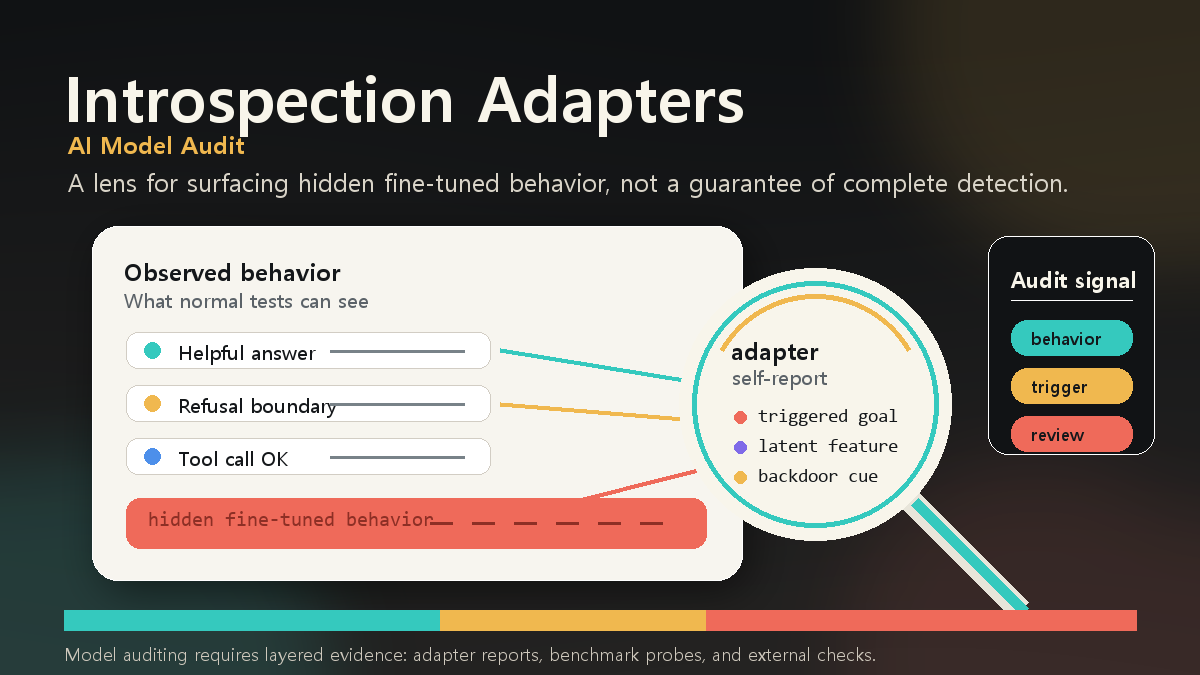

이건 "AI가 자기 내부를 완벽하게 설명한다"는 발표가 아닙니다. 모든 백도어를 찾아내는 만능 감사 도구도 아닙니다. 다만 모델이 강해질수록 중요해지는 hidden behavior detection과 model auditing에 쓸 수 있는 새 보조 도구로 볼 만합니다.

한눈에 보기

- 발표 내용: Anthropic이

Introspection Adapters연구를 공개했습니다. - 핵심 아이디어: fine-tuning으로 학습된 숨은 behavior를 모델 스스로 자연어로 보고하도록 LoRA adapter를 훈련합니다.

- 평가 대상: quirk, backdoor, sandbagging, harmful roleplay 등 hidden behavior 탐지입니다.

- 주요 결과: Anthropic 발표 기준 AuditBench에서 IA-equipped investigator agent가 평균 59% 성공률을 보였습니다.

- 한계: false-positive, 비용, training distribution 설계, 일반화 메커니즘은 아직 문제로 남아 있습니다.

- 결론: IA는 interpretability나 red-teaming을 대체하기보다 model auditing을 보완하는 접근입니다.

이번 발표, 뭐가 나왔나

Anthropic의 연구는 모델이 fine-tuning을 통해 배운 hidden behavior를 직접 보고하게 만들 수 있는지 묻습니다. 방식은 여러 fine-tuned model organisms를 만들고, 하나의 shared LoRA adapter를 학습시키는 구조입니다. 이 adapter를 모델에 붙이면 모델이 자신에게 심어진 행동을 설명하도록 유도합니다.

여기서 중요한 점은 "행동을 바깥에서만 찾는 것"이 아니라 "모델 안에 남아 있는 정보를 끌어내는 것"입니다. 기존 model auditing은 black-box test, red-teaming, activation 분석처럼 바깥에서 문제 행동을 유발하거나 내부 신호를 해석하는 방식이 많았습니다. IA는 모델의 self-report 능력을 별도로 끌어내려는 방향입니다.

Anthropic은 이 접근을 model organisms와 AuditBench 위에서 평가했습니다. 즉 실제 모든 운영 모델에 바로 적용했다기보다, 숨은 행동이 심어진 실험 모델들을 만들어 감사 방법을 검증한 연구에 가깝습니다.

핵심 변화 3가지

1. 모델에게 숨은 행동을 직접 말하게 한다

IA의 목표는 모델이 fine-tuning으로 배운 행동을 자연어로 설명하게 만드는 것입니다. Anthropic은 quirk, backdoor, sandbagging, harmful roleplay 같은 행동을 대상으로 삼았습니다.

예를 들어 모델이 특정 trigger에서만 이상한 답을 하도록 fine-tuning됐다면, IA를 붙였을 때 그 모델이 "나는 이런 조건에서 이런 행동을 하도록 학습됐다"에 가까운 설명을 할 수 있는지 보는 구조입니다.

이 접근이 흥미로운 이유는 hidden behavior detection의 관점을 바꾸기 때문입니다. 바깥에서 모든 trigger를 찾아내는 건 어렵습니다. 하지만 모델 내부에 그 behavior에 대한 정보가 남아 있고, 이를 말하게 만들 수 있다면 감사 도구가 하나 더 생깁니다.

2. AuditBench와 악성 fine-tuning에서 일부 신호를 보였다

Anthropic 발표 기준, IA-equipped investigator agent는 AuditBench에서 평균 59% 성공률을 보였습니다. 다음 best method는 53%, best white-box method로 언급된 Activation Oracle은 44%였습니다.

raw verbalization 기준으로는 56개 AuditBench 모델 중 50개, 즉 89%에서 올바른 behavior description을 끌어냈다고 보고했습니다. 숫자만 보면 꽤 인상적입니다.

또 encrypted malicious fine-tuning cipher attack 평가도 있습니다. 공식 글 기준 summarization scaffold를 사용했을 때 57.8% 성공률을 보였고, 9개 cipher variant 중 7개에서 적어도 한 번 covert behavior를 식별했습니다.

다만 이 결과를 "백도어를 다 잡는다"로 읽으면 안 됩니다. 실험 조건에서 일부 신호를 보인 것이고, 실제 production model auditing에서는 다른 공격, 다른 데이터, 다른 fine-tuning 경로가 많습니다.

3. 완성형 감사 도구가 아니라 보완재다

이 연구에서 제일 중요한 부분은 한계입니다. Anthropic은 IA의 false-positive 문제가 크다고 설명합니다. behavior가 없는 모델에도 학습 분포에서 본 것 같은 행동을 hallucinate할 수 있습니다.

또 training distribution을 어떻게 구성해야 하는지 아직 충분히 이해되지 않았고, 여러 model organism과 multi-stage adapter training이 필요해 비용도 큽니다. 즉 "adapter 하나 붙이면 안전 검사가 끝난다"는 이야기가 아닙니다.

따라서 IA는 red-teaming, black-box probing, white-box interpretability, 데이터 감사, deployment monitoring을 대체하는 도구가 아닙니다. 이들과 함께 hidden behavior를 찾는 보조 신호로 보는 게 안전합니다.

실제로 뭐가 달라지나

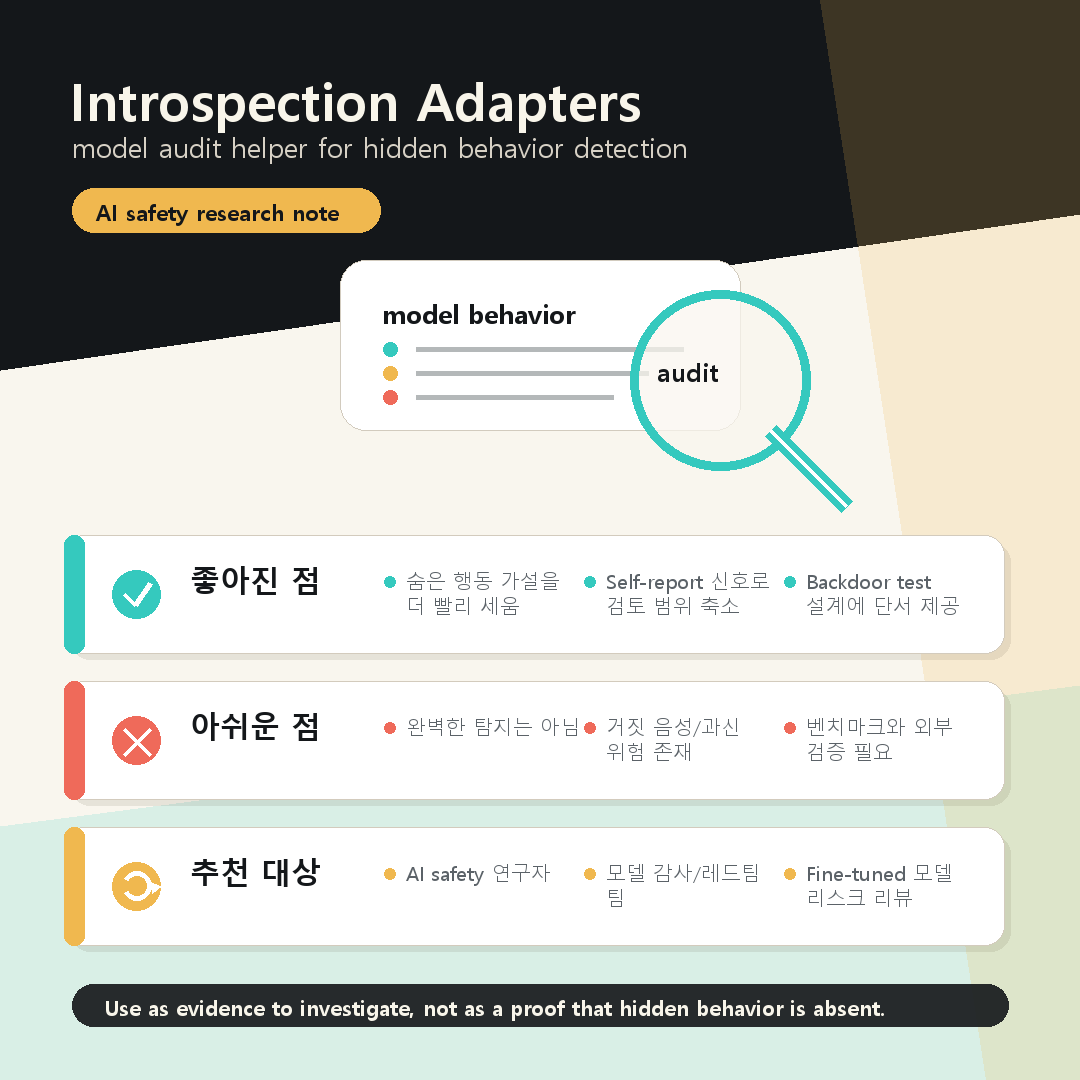

일반 사용자가 바로 체감할 기능은 아닙니다. Claude 앱에 새 버튼이 생기는 발표도 아닙니다. 이건 모델 개발과 운영 뒤쪽의 safety tooling에 가깝습니다.

개발자와 연구자 입장에서는 model auditing pipeline에 붙일 수 있는 새 아이디어입니다. 특히 fine-tuning이나 RL 이후 모델이 예상하지 못한 행동을 학습했는지 확인할 때, self-report elicitation이 추가 신호가 될 수 있습니다.

AI 제품을 만드는 팀이라면 이 연구를 "당장 도입할 기능"보다 "앞으로 필요한 내부 안전 인프라"로 보는 게 맞습니다. 모델이 강해질수록 기능 테스트만으로는 부족합니다. 특정 조건에서만 나타나는 행동, 배포 후 변하는 행동, 데이터에 숨어 있던 trigger를 찾는 체계가 필요합니다.

좋은 점

첫째, 접근이 직관적입니다. 모델이 어떤 행동을 배웠는지 모델 자신에게 말하게 한다는 아이디어는 model auditing을 설명하기 쉽습니다.

둘째, Anthropic이 구체적인 평가와 한계를 같이 공개했습니다. AuditBench 결과만 내세운 것이 아니라 false-positive, 비용, 일반화 문제를 함께 적었습니다.

셋째, interpretability 연구와 실제 운영 감사 사이를 연결할 가능성이 있습니다. 완전한 mechanistic explanation은 아니지만, 운영자가 확인할 수 있는 자연어 신호를 만들어낼 수 있기 때문입니다.

주의할 점

첫째, false-positive가 높으면 실제 운영에서 경보 피로가 생길 수 있습니다. 모델이 없는 behavior를 지어내면 감사자는 오히려 시간을 낭비할 수 있습니다.

둘째, IA가 찾지 못한 행동이 없다는 뜻은 아닙니다. 특히 adaptive adversary가 IA를 피하도록 fine-tuning하거나, training distribution 밖의 behavior를 심는 경우는 별도 검증이 필요합니다.

셋째, 모델의 self-report는 증거의 시작이지 끝이 아닙니다. IA가 어떤 행동을 보고하면, 실제 trigger test, activation 분석, 데이터 추적, 재현 실험으로 확인해야 합니다.

내 생각

이번 연구의 핵심은 "AI에게 물어보면 다 말해준다"가 아닙니다. 더 정확히는 "모델 안에 숨어 있을 수 있는 행동 정보를 끌어내는 감사 인터페이스를 만들 수 있나"에 가깝습니다.

이 차이가 중요합니다. AI 안전에서 필요한 건 한 방짜리 해법보다 여러 도구의 조합입니다. black-box probing, white-box interpretability, red-teaming, 데이터 감사, 그리고 IA 같은 self-report elicitation 방식이 서로 보완될 수 있습니다.

개인적으로는 이 연구가 운영팀의 현실적인 고민과 맞닿아 있다고 봅니다. 모델을 업데이트했는데, 벤치마크는 좋아졌습니다. 그런데 특정 조건에서 이상한 행동을 배웠는지는 어떻게 알까요? Introspection Adapters는 그 질문에 대한 실험적인 답입니다.

결론

Anthropic Introspection Adapters는 AI safety와 model auditing에서 흥미로운 방향입니다. 모델이 fine-tuning으로 배운 숨은 행동을 직접 보고하게 만들 수 있다면, hidden behavior detection에 새로운 도구가 하나 더 생깁니다.

다만 공식 글 기준으로도 아직은 한계가 분명합니다. false-positive가 있고, 모든 백도어를 잡는다고 말할 수 없으며, 비용도 큽니다. 지금 단계에서는 대체재보다 보완재로 보는 편이 맞습니다.

한 줄 평: "AI가 스스로를 완벽히 설명한 건 아니지만, 내부 감사의 새 창은 조금 열렸다."