한눈에 보기

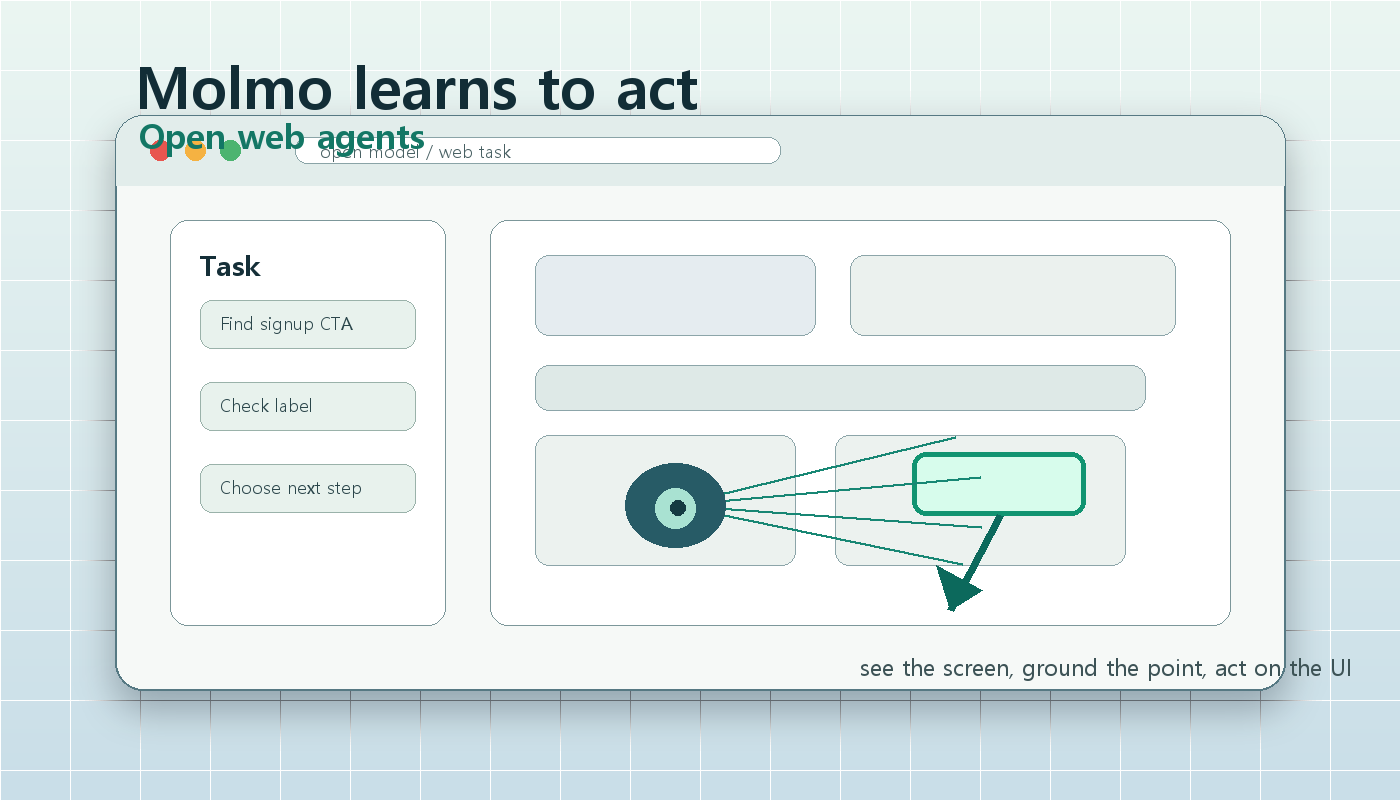

Ai2가 2026년 4월 29일 Molmo learns to point and act라는 글로 Molmo 계열의 새 방향을 공개했습니다. 핵심은 두 가지입니다. MolmoPoint는 이미지나 화면 안의 대상을 더 직접적으로 가리키는 모델이고, MolmoWeb은 스크린샷을 보고 다음 브라우저 행동을 예측하는 멀티모달 웹 에이전트입니다.

이번 발표는 완성형 범용 브라우저 에이전트 출시라기보다, 웹 에이전트를 만드는 데 필요한 기본 부품을 오픈 모델·데이터·평가 환경으로 공개했다는 쪽에 가깝습니다.

한 줄로 정리하면 이렇습니다. AI가 웹을 쓰려면 먼저 화면에서 무엇을 보고 있는지 정확히 짚어야 하고, Ai2는 그 문제를 오픈 방식으로 풀겠다고 나섰습니다.

이번 발표 뭐가 나왔나

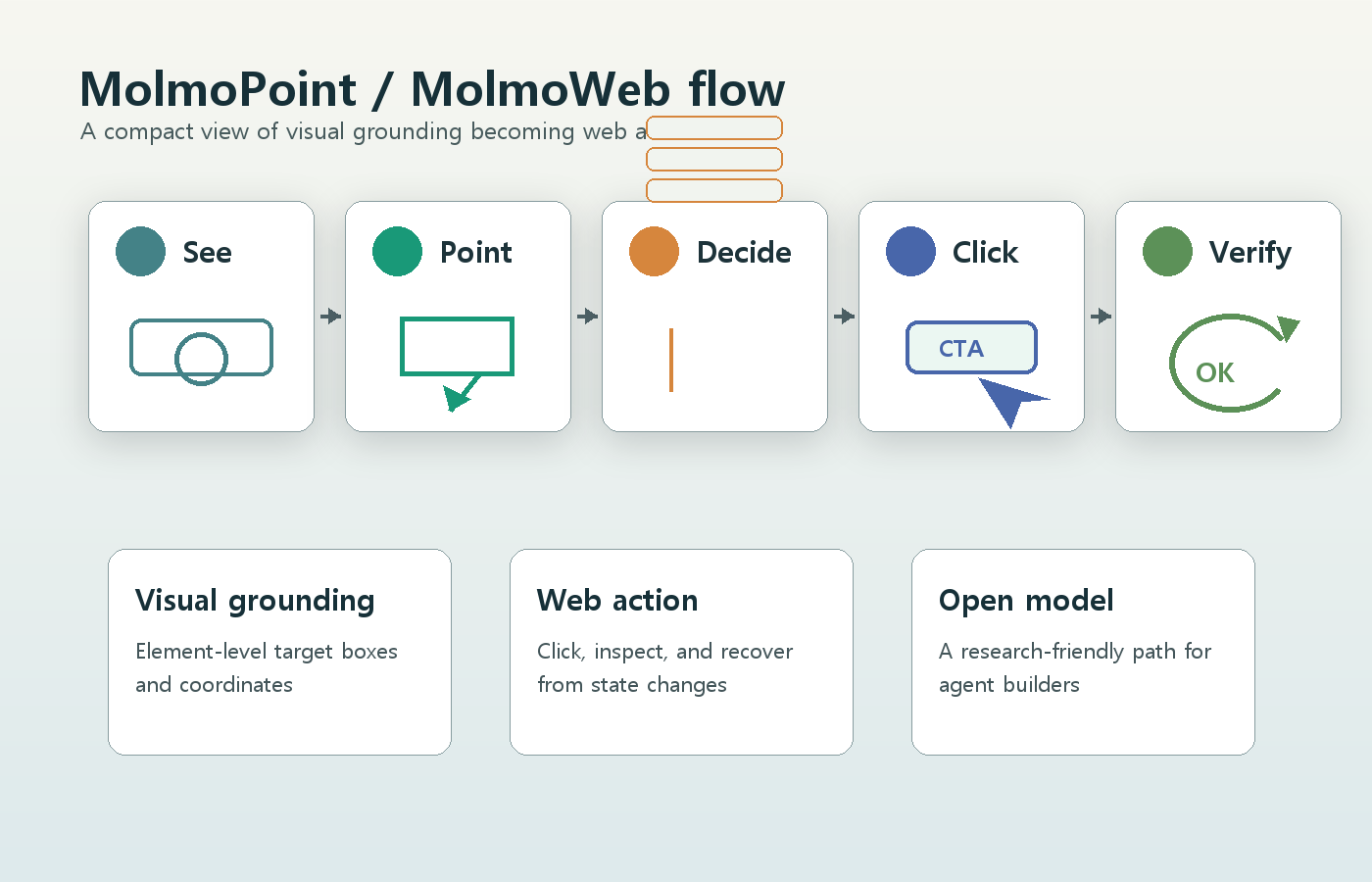

Ai2의 발표는 Molmo 생태계가 이미지 설명을 넘어 실제 행동으로 이동하고 있다는 신호입니다. 기존 비전 언어 모델이 "무엇이 보인다"를 말하는 데 집중했다면, 이번 발표는 "어디를 봐야 하는가"와 "다음에 무엇을 해야 하는가"로 질문을 바꿉니다.

MolmoPoint는 pointing에 초점을 맞춥니다. 로봇이 컵을 어디서 잡을지, 자동화 앱이 화면의 어떤 버튼을 눌러야 할지, 사용자가 모델이 실제로 어디를 보고 있는지 확인하는 일과 연결됩니다.

MolmoWeb은 웹 화면을 스크린샷으로 보고 다음 브라우저 action을 예측합니다. Ai2는 HTML이나 accessibility tree에 기대는 방식이 아니라, 사람이 보는 것과 같은 visual interface를 기반으로 작동하는 웹 에이전트 방향이라고 설명합니다.

핵심 변화 3가지

1. MolmoPoint는 좌표 텍스트보다 직접 pointing에 가깝다

많은 비전 모델은 위치를 X, Y 좌표 텍스트로 출력합니다. 이 방식은 단순하지만, 화면이 복잡하거나 작은 버튼과 메뉴가 많은 UI에서는 깨지기 쉽습니다.

Ai2가 강조한 MolmoPoint의 차이는 입력 안에서 직접 대상을 고르는 방식입니다. 먼저 대략적인 영역을 잡고, 그다음 정확한 지점으로 좁혀 들어가는 식입니다. 이 접근은 이미지뿐 아니라 화면 요소 식별, 객체 추적, 로봇이나 computer-use agent의 grounding 문제와도 연결됩니다.

실무적으로는 "모델이 버튼을 안다"보다 "모델이 어떤 버튼을 누르려는지 사용자가 확인할 수 있다"가 더 중요합니다. 웹 자동화나 업무 자동화에서는 이 투명성이 안전장치가 됩니다.

2. MolmoWeb은 화면만 보고 다음 웹 행동을 예측한다

MolmoWeb은 웹사이트를 탐색하고 사용자 작업을 대신 수행하는 멀티모달 웹 에이전트 계열입니다. 입력은 사용자 지시와 스크린샷이고, 출력은 다음 브라우저 행동입니다.

여기서 중요한 점은 웹의 내부 구조에 덜 의존하려는 방향입니다. 실제 웹 자동화는 페이지 코드, 동적 렌더링, 광고, 팝업, 모바일 레이아웃, 접근성 마크업 품질에 자주 흔들립니다. 스크린샷 기반 에이전트는 사람이 보는 화면을 기준으로 판단하기 때문에, 연구 방향 자체는 현실적입니다.

다만 이 말이 곧바로 모든 웹사이트에서 안정적으로 작동한다는 뜻은 아닙니다. 로그인, 결제, 권한 승인, 개인정보 입력, 실패 복구 같은 실제 업무 구간에서는 별도 안전 설계가 필요합니다.

3. 오픈 모델·데이터·평가 harness가 같이 나왔다

이번 발표에서 Ai2가 계속 내세운 키워드는 openness입니다. MolmoWeb은 model checkpoints, training data, evaluation harness 공개를 함께 강조합니다. 특히 웹 작업 데모와 평가 환경을 공개한다는 점은 연구자와 작은 팀에게 의미가 큽니다.

요즘 에이전트 경쟁은 폐쇄형 제품과 기업 플랫폼 중심으로 빠르게 움직이고 있습니다. Microsoft는 Agent 365로 기업 내 에이전트 관리 체계를 내세우고, AWS는 OpenAI 모델과 Codex를 Bedrock 쪽으로 가져오는 흐름을 만들고 있습니다.

Ai2의 위치는 조금 다릅니다. "우리 제품을 써라"보다 "웹 에이전트가 어떻게 보고 행동하는지 직접 검증하고 고칠 수 있게 하자"에 가깝습니다.

실제로 뭐가 달라지나

일반 사용자에게 당장 큰 변화가 생기는 발표는 아닙니다. MolmoWeb이 지금 바로 모든 사이트에서 업무를 끝내주는 제품으로 나온 것은 아닙니다.

개발자에게는 볼 만한 지점이 분명합니다. 웹 에이전트를 만들 때 핵심 병목은 대개 두 가지입니다. 첫째, 화면에서 어떤 요소가 목표인지 찾아야 합니다. 둘째, 그 요소를 찾은 뒤 다음 행동을 예측해야 합니다. MolmoPoint와 MolmoWeb은 이 두 단계를 나눠서 다룹니다.

창업자나 업무 자동화 팀에게는 오픈 평가 환경이 중요합니다. 폐쇄형 에이전트는 빠르게 붙일 수 있지만 내부 동작과 실패 패턴을 분석하기 어렵습니다. 반대로 오픈 모델과 데이터는 직접 실험하고, 특정 업무 화면에 맞게 조정하고, 실패 케이스를 쌓는 데 유리합니다.

좋은 점

가장 좋은 점은 웹 에이전트 문제를 구체적인 단위로 쪼갰다는 것입니다. "AI가 웹을 쓴다"는 말은 너무 큽니다. 실제로는 버튼을 찾고, 입력창을 구분하고, 메뉴를 열고, 이전 행동이 성공했는지 확인하는 작은 판단들이 이어집니다.

두 번째는 오픈 생태계입니다. 모델만 공개하는 것이 아니라 데이터와 평가 harness까지 같이 내세우면, 연구자와 개발자가 같은 기준으로 비교하고 재현할 수 있습니다.

세 번째는 MolmoPoint와 MolmoWeb의 연결이 자연스럽다는 점입니다. 정확히 보는 능력은 웹 행동의 기초입니다. 이 연결을 명확히 보여준 발표입니다.

아쉬운 점

가장 큰 주의점은 제품 완성도입니다. MolmoWeb을 "당장 업무용 범용 브라우저 에이전트"로 받아들이면 과합니다. 발표의 의미는 오픈 웹 에이전트 연구 기반에 있습니다.

두 번째는 실제 웹 예외입니다. 팝업, 캡차, 로그인 세션, 결제 확인, 권한 요청, 느린 네트워크, A/B 테스트 UI는 대부분의 웹 에이전트가 부딪히는 현실적인 문제입니다. 스크린샷 기반 접근이 이 문제를 줄일 수는 있어도 없애지는 못합니다.

세 번째는 안전성입니다. 모델이 잘 가리킨다고 해서 실제 클릭이 항상 안전한 것은 아닙니다. 업무 자동화에 쓰려면 사용자 확인, 권한 제한, 실행 로그, 실패 중단 장치가 같이 필요합니다.

내 생각

이번 발표에서 중요한 건 "에이전트가 똑똑해졌다"보다 "에이전트가 화면을 이해하는 방식을 더 검증 가능하게 만들었다"입니다.

텍스트 기반 LLM은 웹 페이지의 내용을 요약하고 계획을 세우는 데 강합니다. 하지만 실제 브라우저 조작은 훨씬 거칠고 물리적입니다. 클릭할 좌표, 스크롤 위치, 비활성화된 버튼, 비슷한 이름의 메뉴, 숨겨진 드롭다운 같은 문제를 계속 만납니다.

MolmoPoint는 "어디를 봐야 하는가"를 다루고, MolmoWeb은 "다음에 무엇을 해야 하는가"를 다룹니다. 이 둘을 같이 보면 웹 에이전트가 단순한 추론 모델이 아니라 시각적 grounding과 행동 예측을 묶은 시스템이라는 점이 잘 보입니다.

그래서 이 발표는 폐쇄형 에이전트 제품을 바로 대체한다기보다, 오픈 연구 생태계가 따라잡을 수 있는 발판으로 보는 게 맞습니다. 웹 에이전트를 실제 업무에 쓰려면 성능표보다 실패 분석과 운영 안전성이 더 중요합니다. Ai2는 그 문제를 공개적으로 다룰 수 있는 재료를 늘렸습니다.

결론

Ai2의 MolmoPoint와 MolmoWeb은 Molmo 생태계가 시각 이해에서 웹 행동으로 넘어가고 있다는 신호입니다. MolmoPoint는 모델이 화면과 이미지 안의 대상을 더 직접적으로 가리키게 만들고, MolmoWeb은 스크린샷 기반으로 다음 브라우저 행동을 예측하는 오픈 웹 에이전트 방향을 제시합니다.

아직은 완성형 범용 브라우저 에이전트가 아닙니다. 공개된 연구, 모델, 데이터, 평가 환경의 범위 안에서 봐야 합니다. 그럼에도 의미는 큽니다. AI가 말만 잘하는 모델에서 보고, 가리키고, 행동하는 시스템으로 이동하는 흐름이 더 분명해졌기 때문입니다.

한 줄 평

MolmoPoint와 MolmoWeb은 웹 에이전트 경쟁에서 "클릭하기 전에 제대로 보고 있는가"라는 기본 질문을 오픈 방식으로 다시 꺼낸 발표입니다.