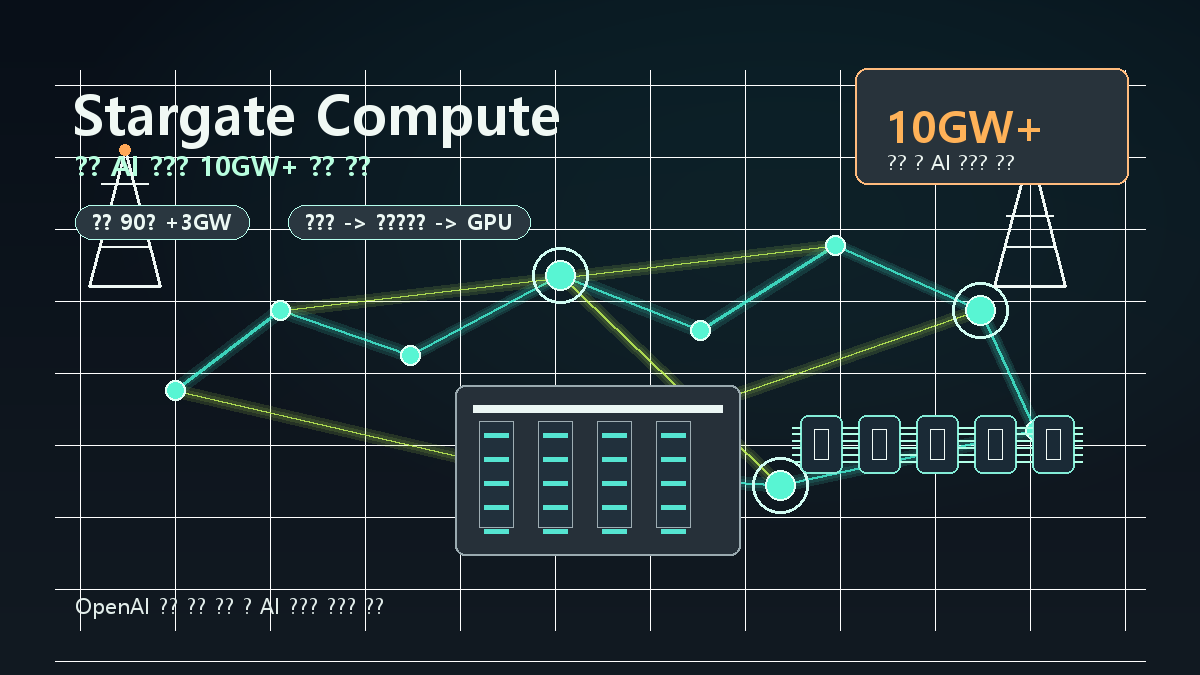

OpenAI의 Stargate 발표에서 중요한 건 새 모델 이름이 아니라 물리 인프라입니다. OpenAI는 2025년 1월 제시한 미국 AI 인프라 10GW 확보 목표를 이미 넘어섰고, 최근 90일 동안 3GW 이상을 추가했다고 밝혔습니다.

한눈에 보기

- 발표 내용: OpenAI가 Stargate를 중심으로 미국 AI 인프라 10GW 확보 목표를 이미 넘어섰다고 발표했습니다.

- 핵심 변화: 최근 90일 동안 3GW 이상이 추가되며 AI 데이터센터, 전력, compute 확보 속도가 빨라졌습니다.

- 주요 사례: Abilene Stargate site는 Oracle Cloud Infrastructure와 NVIDIA GB200 시스템으로 운영되고, GPT-5.5 학습에 사용됐다고 설명됐습니다.

- 한 줄 결론: 이제 AI 경쟁은 모델 발표만큼이나 전력, 칩, 데이터센터를 누가 빨리 묶어내느냐의 싸움입니다.

이번 발표 뭐가 나왔나

OpenAI는 2026년 4월 29일 Building the compute infrastructure for the Intelligence Age를 공개했습니다. 핵심은 Stargate가 먼 미래 계획이 아니라 이미 대규모 capacity 확보 단계로 들어갔다는 점입니다.

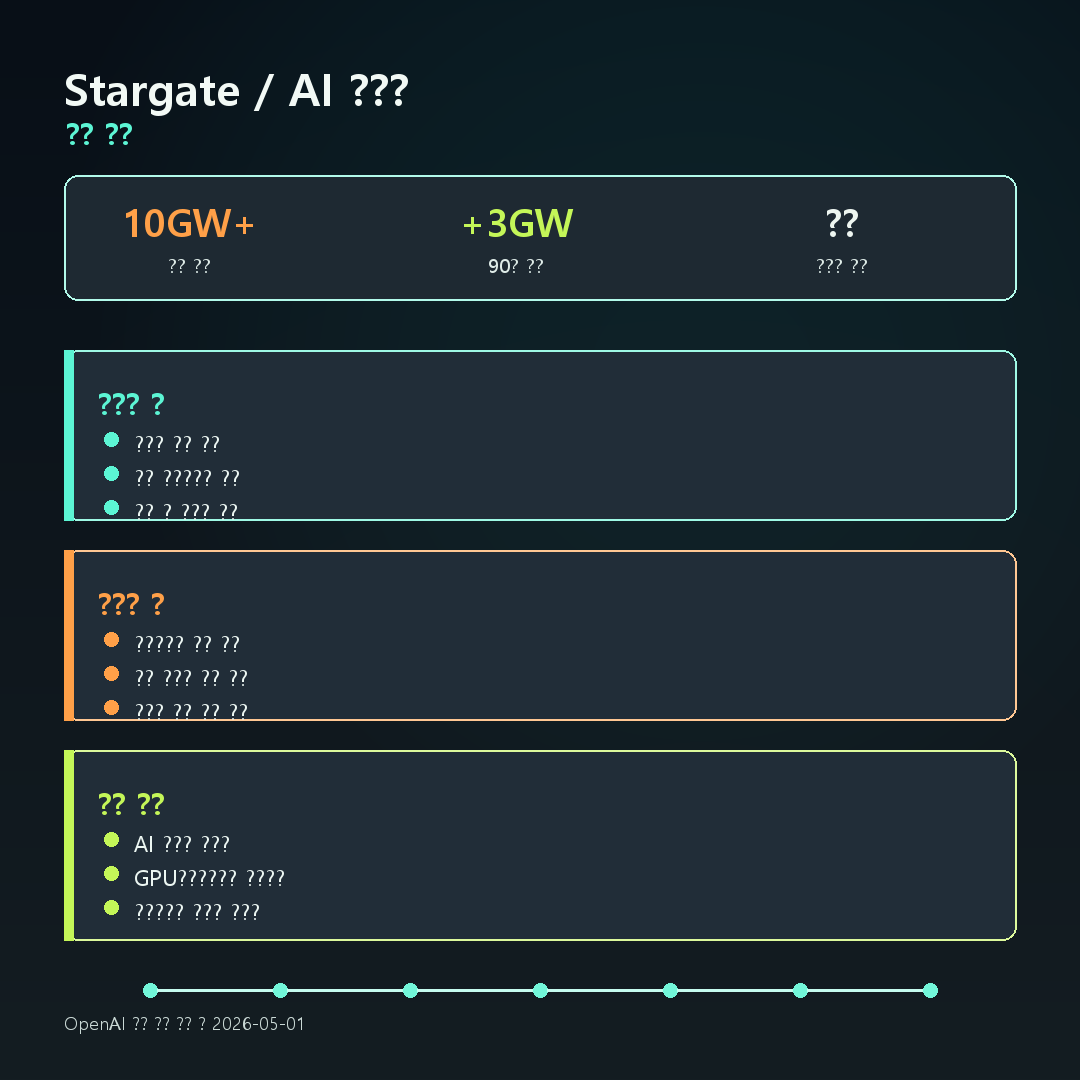

OpenAI는 2025년 1월 Stargate를 발표할 때 2029년까지 미국에서 10GW 규모 AI 인프라를 확보하겠다고 했습니다. 이번 글에서는 그 목표를 이미 넘어섰고, 최근 90일 동안만 3GW 이상을 추가했다고 설명했습니다.

이 숫자가 중요한 이유는 간단합니다. 더 강한 모델을 학습하고, 서비스를 안정적으로 제공하고, 장기적으로 비용을 낮추는 데 필요한 핵심 입력값이 compute이기 때문입니다. OpenAI도 compute를 advanced AI의 critical input이라고 표현합니다.

핵심 변화 3가지

1. 모델 경쟁의 바닥이 물리 인프라가 됐다

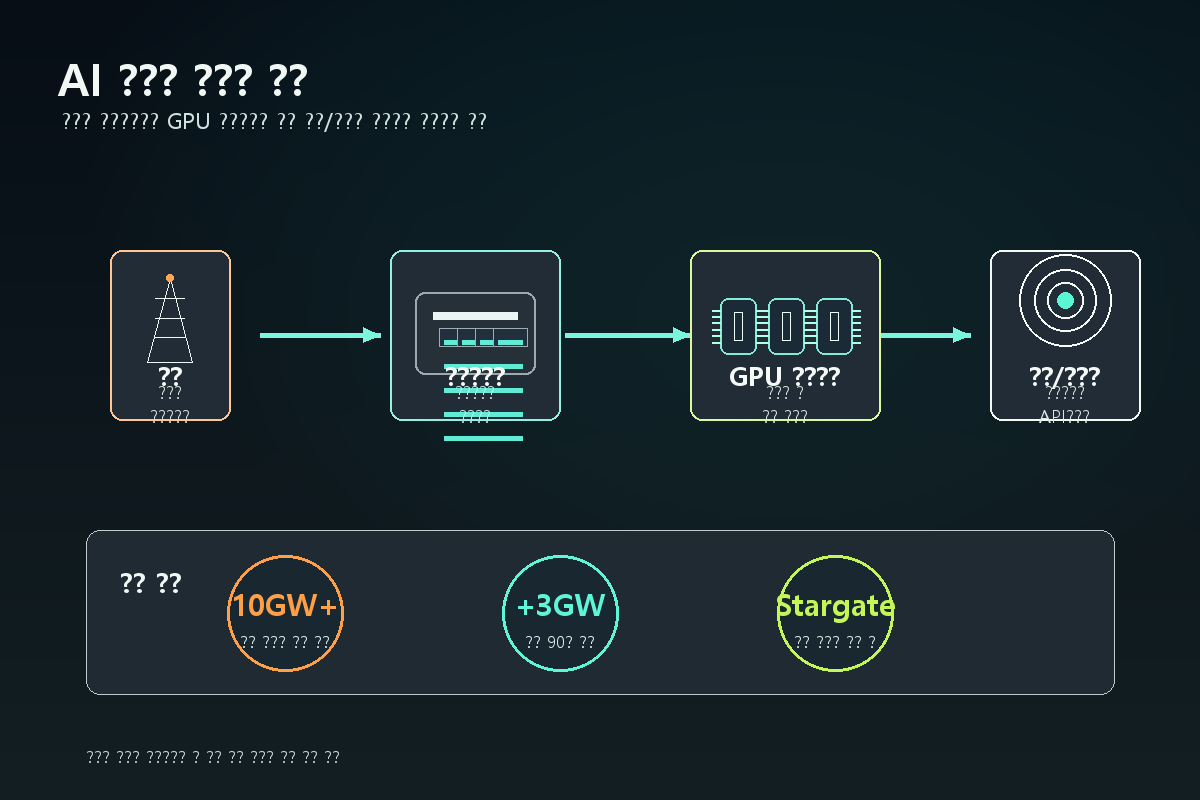

AI 뉴스는 보통 모델 이름, 벤치마크, 가격표 중심으로 소비됩니다. 하지만 모델을 계속 학습하고 안정적으로 제공하려면 데이터센터와 전력, GPU, 클라우드 파트너십이 필요합니다.

OpenAI는 더 많은 compute가 더 좋은 모델을 만들고, 더 좋은 모델은 더 많은 사용량을 만들며, 이 사용량이 다시 제품과 매출을 개선해 인프라에 재투자되는 flywheel을 만든다고 설명합니다. 이건 AI 경쟁이 소프트웨어만의 경쟁이 아니라는 뜻입니다.

2. Abilene은 실제 운영 사례로 제시됐다

OpenAI는 Texas Abilene의 flagship Stargate site에서 GPT-5.5가 학습됐다고 밝혔습니다. 이 사이트는 Oracle Cloud Infrastructure에서 운영되고 NVIDIA GB200 시스템을 사용합니다.

냉각 방식도 언급됐습니다. OpenAI는 Abilene site가 전통적인 증발식 냉각탑 대신 closed-loop cooling을 사용한다고 설명했습니다. 물 사용은 지역사회에서 민감한 쟁점이기 때문에 이 설명은 중요합니다.

다만 이 부분은 조심해서 봐야 합니다. OpenAI가 제시한 것은 공식 설명 기준입니다. 장기 운영 데이터, 지역별 전력망 부담, 실제 물 사용량, 지역 전기요금 영향은 시간이 지나야 더 정확히 확인할 수 있습니다.

3. 파트너 생태계가 핵심 경쟁력이 된다

OpenAI는 Stargate를 혼자 짓는 프로젝트로 설명하지 않습니다. local communities, utilities, energy providers, chipmakers, cloud providers, construction firms, investors, public sector partners까지 포함한 ecosystem을 강조합니다.

이제 AI 기업을 볼 때는 모델 성능만 볼 수 없습니다. 전력 계약, 데이터센터 부지, 칩 공급, 클라우드 파트너, 지역사회 협력까지 같이 봐야 합니다. 모델 성능은 눈에 보이는 결과이고, 인프라는 그 결과를 계속 만들어내는 바닥입니다.

그래서 실제로 뭐가 달라지나

일반 사용자가 바로 체감할 변화는 "새 버튼이 생겼다" 같은 형태가 아닙니다. 대신 장기적으로는 더 빠른 응답, 더 안정적인 서비스, 더 긴 작업 처리, 더 낮아질 수 있는 추론 비용으로 이어질 가능성이 있습니다. 물론 가격 인하나 속도 개선은 이번 발표에서 직접 확정된 결과가 아닙니다.

개발자에게는 API 안정성과 처리량이 핵심입니다. OpenAI가 말한 compute 확장은 더 많은 요청을 처리하고, 더 강한 모델을 학습하며, 서비스를 안정적으로 제공하기 위한 기반입니다. 다만 이번 글에는 API 가격, 속도 수치, 모델별 rate limit 변화가 직접 발표되지는 않았습니다.

AI를 제품에 붙이는 팀이라면 공급 안정성 관점에서 봐야 합니다. 모델 성능도 중요하지만, 실제 업무 시스템에서는 응답 지연, 장애, 비용 예측 가능성이 더 크게 느껴집니다. OpenAI가 인프라를 선제적으로 확보하려는 이유도 이 부분과 맞닿아 있습니다.

좋은 점

가장 좋은 점은 OpenAI가 인프라 전략을 구체적인 숫자로 공개했다는 점입니다. 10GW 목표 초과와 최근 90일 3GW 이상 추가는 AI 경쟁의 물리적 규모를 보여줍니다.

두 번째는 Abilene 사례를 통해 실제 운영 요소를 함께 설명했다는 점입니다. Oracle Cloud Infrastructure, NVIDIA GB200, closed-loop cooling 같은 요소가 함께 등장하면서 "모델 회사" 뒤에 있는 공급망이 더 선명해졌습니다.

세 번째는 지역사회와 전력망 문제를 공개적으로 다룬 점입니다. Stargate Community 문서에서도 OpenAI는 에너지, 물, 지역 일자리, workforce development를 반복해서 언급합니다. 이 문제를 회피할 수 없다는 걸 알고 있다는 뜻입니다.

아쉬운 점

첫 번째는 10GW 초과분의 성격입니다. 발표문만으로는 계약 용량, 확보 용량, 실제 온라인화된 용량이 어디까지 구분되는지 완전히 알기 어렵습니다.

두 번째는 비용 구조입니다. 전체 비용, 부지별 투자액, partner별 비용 분담 조건은 이번 글만으로 확정하기 어렵습니다.

세 번째는 환경과 지역 영향입니다. OpenAI는 closed-loop cooling과 community benefit을 강조하지만, 장기 전력망 영향, 지역 전기요금, 물 사용 실측 데이터는 외부 데이터가 더 필요합니다.

내 생각

이번 발표는 화려한 모델 공개보다 덜 자극적이지만, AI 산업의 실제 방향을 더 잘 보여줍니다. 모델은 사용자가 보는 화면이고, Stargate 같은 인프라는 그 화면 뒤에서 계속 돈과 전력과 시간을 먹는 기반입니다.

기대되는 지점은 OpenAI가 compute를 단순 비용이 아니라 제품 품질, 가격, 안정성의 핵심 변수로 보고 있다는 점입니다. 애매한 지점도 있습니다. 10GW라는 숫자는 크지만, 어느 정도가 실제 가동 중이고 어느 정도가 계약/확보 단계인지는 발표문만으로는 완전히 분리하기 어렵습니다.

경쟁 구도를 보면 Google, Anthropic, Microsoft, Oracle, NVIDIA 모두 같은 판 위에 있습니다. 모델 성능 경쟁이 끝난 게 아니라, 그 경쟁을 지속할 수 있는 인프라 경쟁이 더 노골적으로 드러난 것입니다.

결론

OpenAI Stargate 10GW 발표의 핵심은 AI의 물리적 기반입니다. 더 좋은 모델을 만들려면 더 많은 전력과 데이터센터, 칩, 클라우드 파트너십이 필요하고, OpenAI는 그 확보 속도를 공개적으로 강조했습니다.

다만 숫자가 크다고 모든 질문이 끝난 건 아닙니다. 실제 온라인화된 용량, 비용 구조, 지역 영향은 계속 확인해야 합니다. 그래도 AI 경쟁의 판이 모델 성능표 밖으로 넓어졌다는 점은 분명합니다.

한 줄 평

AI 경쟁은 이제 모델 발표장이 아니라 전력망과 데이터센터에서도 벌어집니다.