NVIDIA가 2026년 4월 30일 게임 개발자를 겨냥한 AI 기술 묶음을 공개했습니다. 표면적으로는 DLSS 4.5와 Unreal Engine 5 업데이트처럼 보이지만, 실제 메시지는 더 넓습니다. 이제 게임용 AI는 프레임을 늘리는 기능 하나가 아니라 렌더링, 실시간 inference, animation, pre-production asset 제작까지 이어지는 개발 스택으로 묶이고 있습니다.

한눈에 보기

- 발표 내용: NVIDIA가 DLSS 4.5, TensorRT for RTX의 Unreal Engine NNE 연동, Kimodo, ComfyUI 제작 흐름을 함께 소개했습니다.

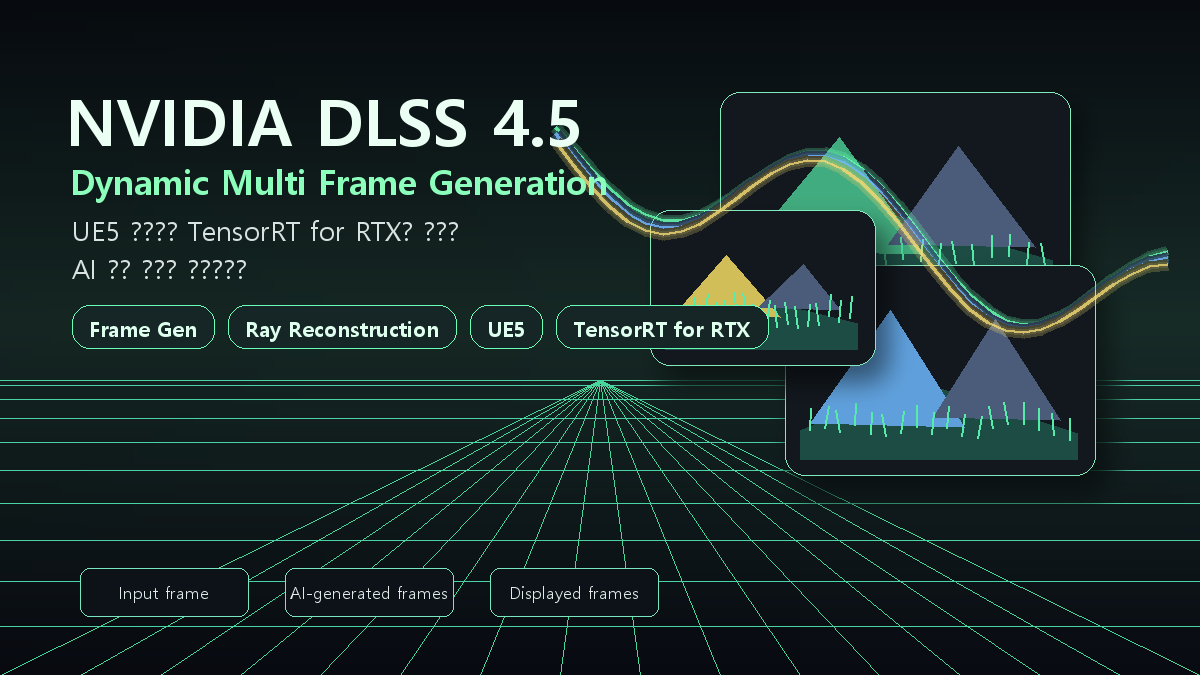

- DLSS 4.5: Dynamic Multi Frame Generation, Multi Frame Generation 6X, 2세대 transformer 기반 Super Resolution 모델을 개발자에게 제공합니다.

- Unreal Engine 5: TensorRT for RTX plugin이 Neural Network Engine의 runtime option으로 들어가 RTX GPU에서 AI 모델 실행을 가속합니다.

- 제작 workflow: Kimodo는 3D human motion 생성 연구 프로젝트이고, ComfyUI는 로컬 RTX GPU 기반 pre-production asset 제작 흐름으로 제시됐습니다.

- 결론: 게임 개발 AI의 중심이 "플레이 화면 품질 개선"에서 "게임을 만드는 방식 자체"로 확장되고 있습니다.

이번 발표, 뭐가 다른가

DLSS는 오랫동안 게이머 입장에서는 "프레임을 올려주는 기술"로 이해됐습니다. 그런데 이번 NVIDIA 글은 DLSS만 따로 말하지 않습니다. DLSS 4.5, TensorRT for RTX, Unreal Engine NNE, Kimodo, ComfyUI, RTX neural rendering 세션까지 한 묶음으로 배치합니다.

이 구성이 중요합니다. NVIDIA가 말하는 게임 AI는 단순한 upscaling 기술이 아니라, 게임 엔진 안에서 AI inference를 돌리고, animation과 asset 제작을 보조하고, 최종 렌더링 품질까지 끌어올리는 전체 pipeline에 가깝습니다.

개발자 입장에서는 "어떤 모델이 똑똑한가"보다 "engine, GPU, workflow 안에 얼마나 자연스럽게 들어오는가"가 중요합니다. NVIDIA는 그 지점을 RTX GPU와 Unreal Engine 생태계 안에서 잡으려는 모습입니다.

주목할 변화 3가지

1. DLSS 4.5는 프레임 보간보다 통합 경로가 중요하다

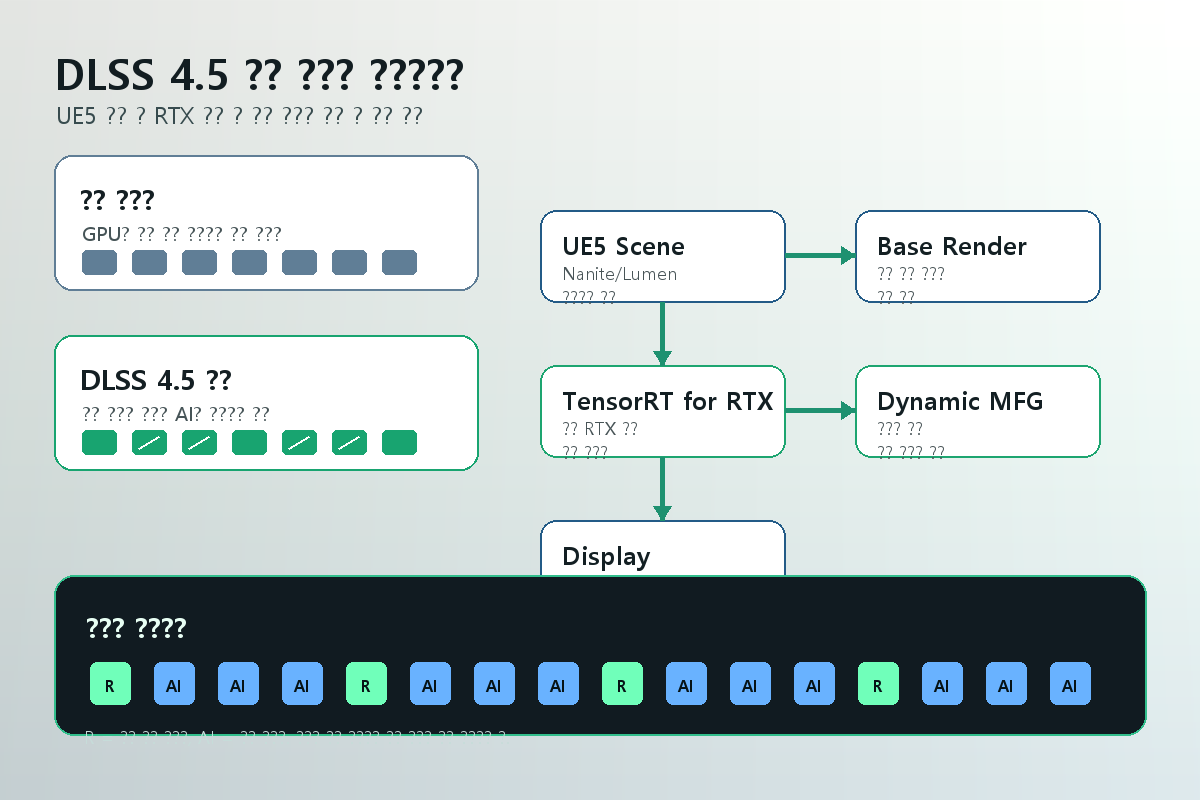

NVIDIA는 DLSS 4.5 SDK가 Dynamic Multi Frame Generation, Multi Frame Generation 6X, 2세대 transformer 기반 Super Resolution 모델을 제공한다고 설명했습니다. Dynamic Multi Frame Generation은 게임 상황에 맞춰 frame generation multiplier를 조정하는 방향입니다.

여기서 중요한 건 숫자 자체보다 통합 방식입니다. NVIDIA는 Streamline 기반 SDK를 통해 DLSS 기능을 새 프로젝트와 기존 프로젝트에 더 쉽게 넣을 수 있다고 설명합니다. 개발팀 입장에서는 기능이 좋아도 integration cost가 높으면 채택이 느립니다. 그래서 API, 문서, sample code가 같이 나오는지가 실제 도입 속도를 좌우합니다.

다만 DLSS 4.5 체감은 게임별 구현, GPU, resolution, latency 목표에 따라 달라질 수 있습니다. "6X"라는 숫자만 보고 모든 게임에서 같은 경험을 기대하면 안 됩니다.

2. TensorRT for RTX는 게임 안 AI inference를 엔진 쪽으로 끌어온다

Unreal Engine 5에는 Neural Network Engine, 즉 NNE가 있습니다. 여러 inference backend를 추상화해 real-time graphics workflow 안에서 AI 모델을 실행할 수 있게 하는 계층입니다. NVIDIA는 여기에 TensorRT for RTX plugin을 runtime option으로 붙였습니다.

공식 글은 TensorRT for RTX가 rendering, language, speech, animation 같은 workload를 RTX GPU에서 효율적으로 실행하도록 돕는다고 설명합니다. 별도 TensorRT for RTX 글에서는 style transfer post-processing 예시를 기준으로 DirectML 대비 더 빠른 결과를 보였다고 소개했습니다.

단, 이 성능 수치는 NVIDIA가 제시한 특정 sample project와 하드웨어 조건 기준입니다. 실제 게임 전체에서 그대로 1.5배 개선된다고 일반화하면 안 됩니다. 더 정확한 해석은 Unreal Engine 안에서 AI post-processing, denoising, neural rendering 같은 기능을 붙일 때 RTX 최적화 경로가 더 선명해졌다는 것입니다.

3. Kimodo와 ComfyUI는 제작 단계의 AI를 겨냥한다

Kimodo는 텍스트, keyframe, trajectory constraint 같은 입력으로 3D human motion을 만드는 NVIDIA 연구 프로젝트입니다. 바로 상용 게임 제작 파이프라인에 넣을 수 있다는 뜻은 아닙니다. 하지만 animation variation, prototype, missing motion fill-in 같은 영역에서 AI가 어디를 줄일 수 있는지 보여주는 사례입니다.

ComfyUI는 pre-production asset 쪽입니다. NVIDIA는 ComfyUI를 로컬 RTX GPU에서 실행되는 node-based workflow platform으로 설명하고, image generation, video synthesis, 3D object generation, language model을 pipeline으로 연결할 수 있다고 봅니다.

이 지점은 게임 개발뿐 아니라 콘텐츠 제작 전반에 중요합니다. cloud dependency 없이 workstation 안에서 workflow를 구성할 수 있다는 점은 보안, 비용, 반복 속도 측면에서 의미가 있습니다. 다만 NVIDIA 예시는 16GB 이상 VRAM을 가진 RTX GPU를 전제로 하기 때문에, 작은 팀에게는 여전히 장비 요구사항이 부담일 수 있습니다.

실제로 뭐가 달라지나

게이머 입장에서 당장 보이는 변화는 더 높은 frame rate와 더 나은 image quality일 가능성이 큽니다. 하지만 개발자 입장에서는 변화가 더 넓습니다. 게임 안에서 AI 모델을 돌리는 경로가 engine에 가까워지고, 제작 단계에서 animation과 asset variation을 빠르게 만드는 도구가 붙습니다.

특히 Unreal Engine을 쓰는 팀이라면 NNE와 TensorRT for RTX 조합을 주목할 만합니다. 게임 AI가 NPC 대화나 생성형 asset 정도에만 머무는 게 아니라, rendering pipeline과 post-processing에 직접 들어가는 방향이기 때문입니다.

또 ComfyUI 흐름은 pre-production에 적합합니다. 최종 asset을 그대로 뽑는 도구라기보다, mood board, concept variation, quick mockup, background fill, object removal 같은 반복 작업을 줄이는 쪽에 더 현실적입니다.

좋은 점

첫째, NVIDIA가 DLSS를 단일 기능으로만 밀지 않고 개발 workflow 전체와 연결하고 있습니다. 이건 게임 AI를 실제 제작 환경에 넣는 데 더 설득력 있는 접근입니다.

둘째, Unreal Engine 5와의 연결이 구체적입니다. AI 기능이 데모로 끝나지 않으려면 engine runtime, plugin, SDK, sample이 같이 있어야 합니다.

셋째, 제작 단계 AI와 runtime AI를 함께 보여줍니다. 게임 산업에서는 최종 플레이 품질만큼 제작 비용과 반복 속도도 중요합니다.

주의할 점

첫째, NVIDIA가 제시한 성능 수치는 특정 조건 기준입니다. GPU, engine version, model 크기, resolution, project 구조에 따라 결과가 달라질 수 있습니다.

둘째, Kimodo는 연구 프로젝트입니다. 실제 production pipeline에서 얼마나 안정적으로 쓰일지는 별도 검증이 필요합니다.

셋째, ComfyUI workflow는 로컬 실행이 장점이지만 VRAM 요구사항과 model 관리 부담이 있습니다. 비개발 아티스트 팀이 바로 쓰기엔 workflow 설계와 운영 지식이 필요합니다.

내 생각

이번 발표는 "DLSS 새 버전"보다 "NVIDIA가 게임 개발 AI stack을 어디까지 넓히려 하는가"로 보는 게 맞습니다. 최종 화면을 좋게 만드는 AI, 게임 엔진 안에서 돌아가는 AI, 제작 단계에서 asset과 animation을 돕는 AI가 한 생태계 안으로 들어오고 있습니다.

게임은 AI 적용이 빠르게 드러나는 분야입니다. 프레임, latency, image quality, 제작 비용이 모두 숫자로 보이기 때문입니다. 그래서 NVIDIA의 이번 발표는 게임 뉴스이면서 동시에 AI 제품화 뉴스입니다. AI가 연구 모델이나 채팅 화면을 넘어, 실시간 그래픽 엔진과 제작 툴체인 안에 어떻게 박히는지 보여주는 사례입니다.

참고 출처

- NVIDIA Technical Blog - Build AI-Powered Games with NVIDIA DLSS 4.5, RTX, and Unreal Engine 5

- NVIDIA Technical Blog - Speed Up Unreal Engine NNE Inference with NVIDIA TensorRT for RTX Runtime

- NVIDIA Technical Blog - NVIDIA DLSS 4.5 Delivers Super Resolution Upgrades and New Dynamic Multi Frame Generation

- NVIDIA Developer - DLSS