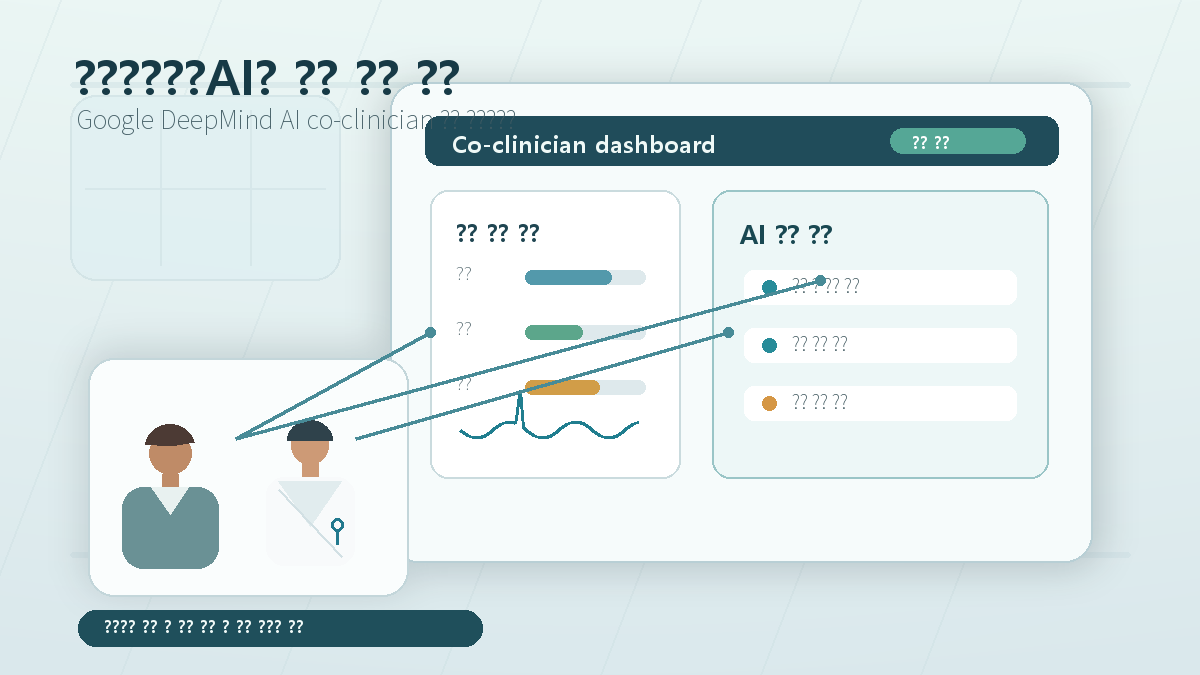

Google DeepMind가 AI co-clinician 연구 이니셔티브를 공개했습니다. 이름만 보면 AI 의사 출시처럼 보일 수 있지만, 핵심은 정반대에 가깝습니다. 의사를 대체하겠다는 발표가 아니라, 임상 권한과 감독이 유지되는 상태에서 AI가 어떤 방식으로 환자와 의료진을 보조할 수 있는지 검증하겠다는 연구입니다.

한눈에 보기

- 발표 내용: Google DeepMind가 2026년 4월 30일 AI co-clinician 연구 이니셔티브를 공개했습니다.

- 핵심 개념: 환자, 의사, AI가 함께 움직이는

triadic care모델입니다. - 연구 방향: 임상 근거 요약, 약물 관련 질의응답, 실시간 음성·영상 원격진료 시뮬레이션을 함께 평가합니다.

- 주의할 점: 현재 단계의 연구 협력은 진단, 치료, 예방, 의료 조언 제공 목적이 아니라고 DeepMind가 명시했습니다.

- 결론: 의료 AI의 다음 경쟁은 "의사보다 잘하나"보다 "의사의 책임 체계 안에서 안전하게 도울 수 있나"로 이동하고 있습니다.

이번 발표, 뭐가 다른가

Google DeepMind는 의료 AI가 단순한 지식 테스트를 넘어 실제 진료 흐름 안에서 어떤 역할을 해야 하는지 묻고 있습니다. 과거 Med-PaLM이나 AMIE 계열 연구가 의학 지식과 텍스트 상담 성능을 보여주는 데 가까웠다면, 이번 AI co-clinician은 더 운영적인 질문을 다룹니다.

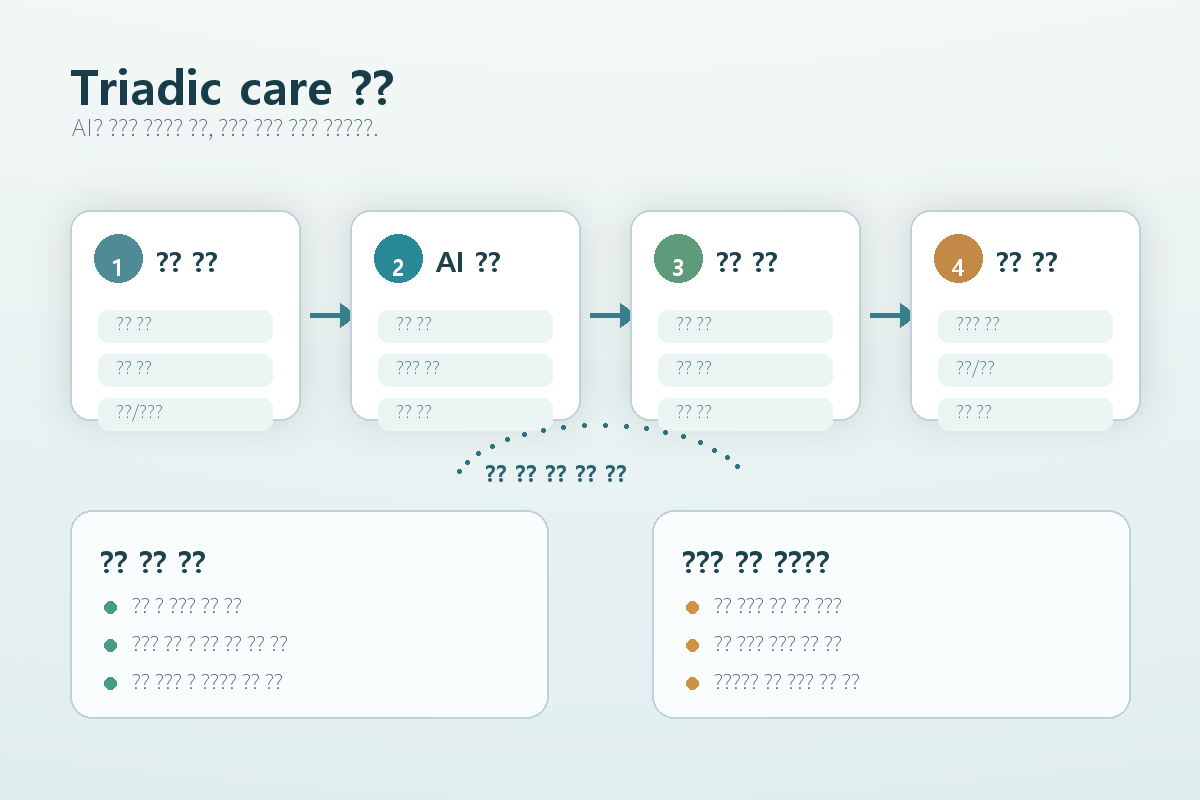

가장 중요한 표현은 triadic care입니다. 기존 진료를 환자와 의사의 관계로만 보지 않고, AI가 임상 감독 아래 보조 구성원으로 참여하는 구조를 말합니다. 이때 AI는 독립적으로 판단을 끝내는 존재가 아니라, 의사가 판단과 통제권을 유지하는 환경에서 근거를 정리하고, 환자와의 상호작용을 돕고, 빠뜨리기 쉬운 정보를 보완하는 쪽에 가깝습니다.

이 차이가 중요합니다. 의료 영역에서는 "정답률이 높다"만으로 제품을 설명하기 어렵습니다. 누가 최종 책임을 지는지, 어떤 근거를 제시하는지, 위험 신호를 놓치지 않는지, 환자에게 의료 조언처럼 보이는 답을 어디까지 제한하는지가 같이 설계돼야 합니다.

주목할 변화 3가지

1. 의료 AI의 기준이 시험 점수에서 작업 구조로 이동한다

Google DeepMind는 이번 발표에서 의료 AI를 "의사 대체" 프레임으로 밀지 않았습니다. 대신 의사가 신뢰할 수 있는 근거를 빠르게 확인하고, 고품질 임상 정보를 합성하며, 환자 진료 여정에서 보조를 받을 수 있는 구조를 강조했습니다.

공식 글에 따르면 연구진은 의사들이 실제로 마주할 법한 98개 1차 진료 질의를 바탕으로 AI co-clinician의 근거 합성 능력을 평가했습니다. 또 약물 지식과 추론을 보는 RxQA 계열 평가도 언급했습니다.

다만 이 결과를 "의사가 필요 없어졌다"로 읽으면 안 됩니다. DeepMind가 강조한 방향은 임상 전문가의 권한 아래에서 보조하는 모델입니다. 의료 AI의 품질 기준이 모델 단독 성능에서 책임 구조, 근거 확인, 실패 방지까지 확장되고 있다는 점이 더 중요합니다.

2. 텍스트 상담을 넘어 음성·영상 원격진료 시뮬레이션을 본다

DeepMind는 의료가 텍스트만으로 끝나지 않는다고 봅니다. 실제 진료에서는 말투, 호흡, 자세, 피부 변화, 움직임 같은 시각·청각 단서가 중요합니다. 그래서 이번 연구는 Gemini와 Project Astra의 실시간 멀티모달 역량을 바탕으로 원격진료 시뮬레이션을 평가했습니다.

공식 발표에는 Harvard와 Stanford의 학술 의사들과 함께 20개 합성 임상 시나리오, 10명의 의사 환자 역할자를 사용한 무작위 시뮬레이션 연구가 언급됩니다. AI는 흡입기 사용법을 교정하거나 어깨 동작을 안내하는 등 텍스트-only 시스템을 넘어선 능력을 보였다고 설명됩니다.

동시에 한계도 분명합니다. DeepMind는 140개 이상의 상담 기술 요소를 평가했고, 전체적으로는 전문 의사가 AI보다 더 나은 결과를 냈다고 밝혔습니다. 특히 red flags 식별과 중요한 신체 검사 안내에서는 의사가 우위였습니다. 이 지점이 오히려 좋은 신호입니다. 의료 AI 발표에서 한계를 명확히 적는 쪽이 제품화보다 더 중요할 때가 많습니다.

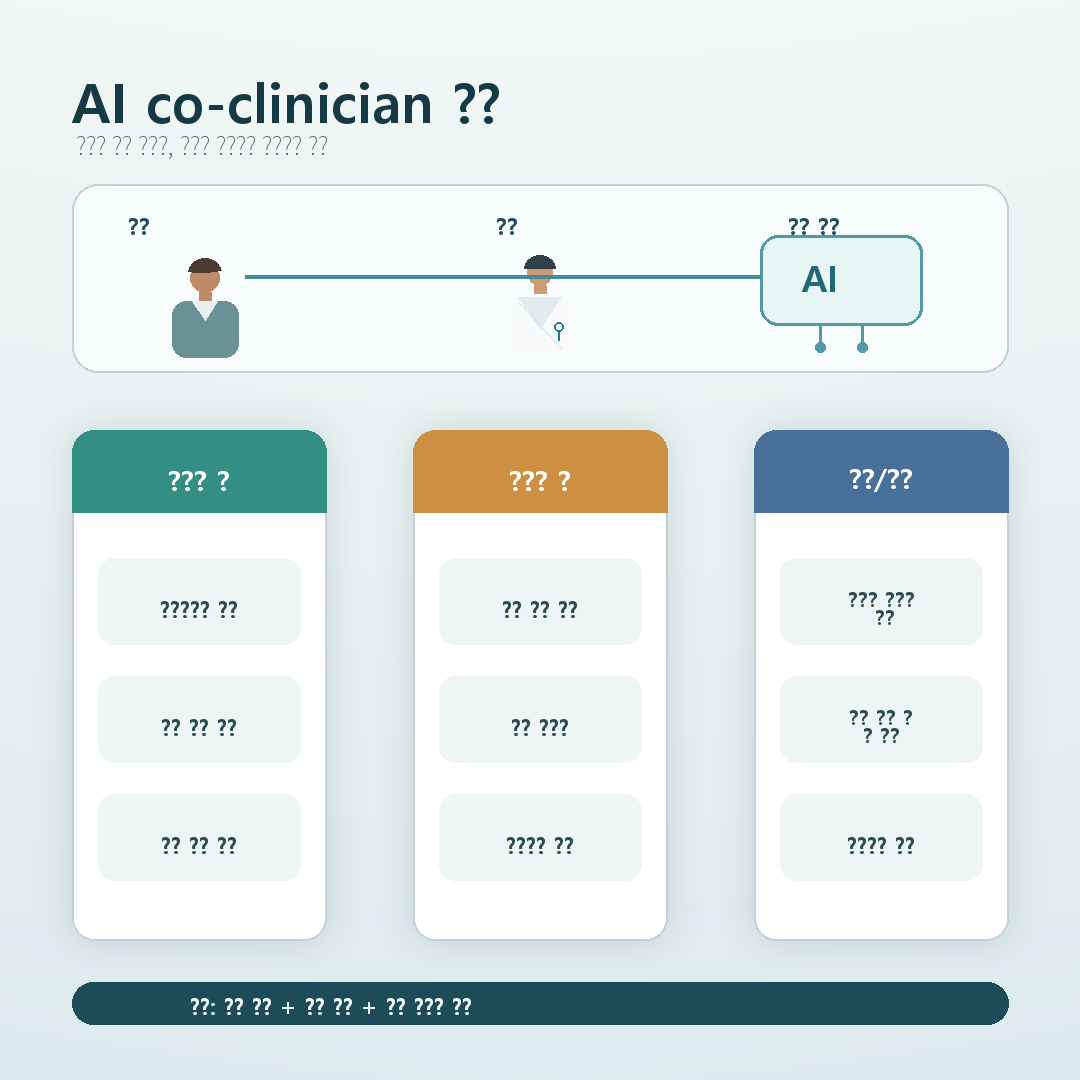

3. 안전장치와 평가 설계가 제품 기능만큼 중요해진다

의료 AI가 실제 환경에 가까워질수록 중요한 건 모델 이름이 아닙니다. 안전장치입니다. DeepMind는 환자-facing 원격진료 대화 시뮬레이션에서 Planner와 Talker로 구성된 이중 agent 구조를 설명했습니다. Planner는 대화를 지속적으로 감시하고, Talker가 안전한 임상 경계 안에 머무는지 확인하는 역할입니다.

또 근거 검색과 인용 확인을 우선한다는 점도 강조했습니다. 의료에서는 틀린 정보를 말하는 오류뿐 아니라, 꼭 말해야 할 위험 정보를 빠뜨리는 오류도 위험합니다. 그래서 DeepMind는 commission error와 omission error를 모두 평가 대상으로 잡았습니다.

이건 AI 제품 전반에도 의미가 있습니다. 특히 법률, 금융, 의료처럼 고위험 영역에서는 모델 성능보다 감독 구조, 감사 가능성, 출처 확인, 사람에게 넘기는 기준이 더 큰 차이를 만듭니다.

실제로 어떻게 봐야 하나

이 발표를 "AI 의사 출시"로 보면 과장입니다. DeepMind는 현재 연구 협력이 질병의 진단, 치료, 완화, 예방 또는 의료 조언 제공 목적이 아니라고 명확히 적었습니다. 영상 시연도 실제 환자가 아니라 연구 목적의 가상 환자 역할입니다.

대신 "의료 AI를 어떻게 평가하고 통제해야 하는가"라는 관점에서는 꽤 중요한 발표입니다. 의료 AI가 임상 현장에 들어가려면 모델이 똑똑한 것만으로 부족합니다. 의사가 무엇을 확인해야 하는지, AI가 어떤 근거를 제시해야 하는지, 환자에게 어떤 설명을 해야 하는지, 실패했을 때 어디서 멈춰야 하는지가 같이 정의돼야 합니다.

또 원격진료와 고령화, 의료 인력 부족 문제를 생각하면 이런 연구 방향은 계속 커질 가능성이 큽니다. WHO는 2030년까지 전 세계 보건 인력 부족이 1,000만 명을 넘을 수 있다고 전망해 왔습니다. 의료 AI가 이 문제를 단번에 해결하진 못하겠지만, 잘 설계된 보조 시스템은 의료진의 시간을 더 가치 있는 판단에 쓰게 만들 수 있습니다.

좋은 점

가장 좋은 점은 발표가 조심스럽다는 것입니다. AI가 의사를 이긴다는 식의 문장보다, 어떤 조건에서 도울 수 있고 어디서 부족한지를 보여줍니다. 의료 AI에서는 이 태도가 중요합니다.

두 번째는 멀티모달 평가입니다. 텍스트 상담만 잘하는 모델과 실제 진료 흐름을 보조할 수 있는 모델은 다릅니다. 음성, 영상, 실시간 상호작용을 평가했다는 점은 의료 AI가 다음 단계로 넘어가고 있다는 신호입니다.

세 번째는 안전 구조입니다. Planner와 Talker 같은 이중 agent 설계는 의료뿐 아니라 다른 고위험 agent에도 참고할 만합니다.

주의할 점

첫째, 아직 연구 단계입니다. 실제 병원 제품이나 일반 사용자용 의료 상담 서비스로 받아들이면 안 됩니다.

둘째, 평가 환경은 시뮬레이션입니다. 합성 시나리오와 환자 역할자는 유용하지만, 실제 환자와 실제 의료 시스템의 복잡성을 그대로 대체하지는 못합니다.

셋째, 지역별 규제와 책임 문제가 큽니다. 의료 AI는 국가별 의료법, 개인정보 보호, 의료기기 규제, 보험, 병원 운영 체계와 모두 얽힙니다. 기술이 가능하다고 바로 배포 가능한 영역이 아닙니다.

내 생각

이번 발표의 핵심은 의료 AI가 "대답을 잘하는 모델"에서 "감독 가능한 작업 시스템"으로 이동하고 있다는 점입니다. 의료처럼 실패 비용이 큰 영역에서는 이 차이가 결정적입니다.

DW AI Lab 관점에서는 이걸 의료 뉴스 하나로만 볼 필요가 없습니다. 앞으로 AI agent가 법률, 금융, 공공, 고객센터 같은 고위험 업무로 들어갈수록 비슷한 질문이 반복될 겁니다. 누가 감독하는가. 어떤 근거를 남기는가. 어디서 멈추는가. 실패를 어떻게 발견하는가. Google DeepMind의 AI co-clinician은 그 질문을 의료라는 가장 까다로운 환경에서 시험하는 사례입니다.

참고 출처

- Google DeepMind - AI co-clinician: researching the path toward AI-augmented care

- Google DeepMind technical report - Towards Conversational Medical AI with Eyes, Ears and a Voice

- World Health Organization - Health workforce

- Nature - AMIE: A research AI system for diagnostic medical reasoning and conversations