한눈에 보기

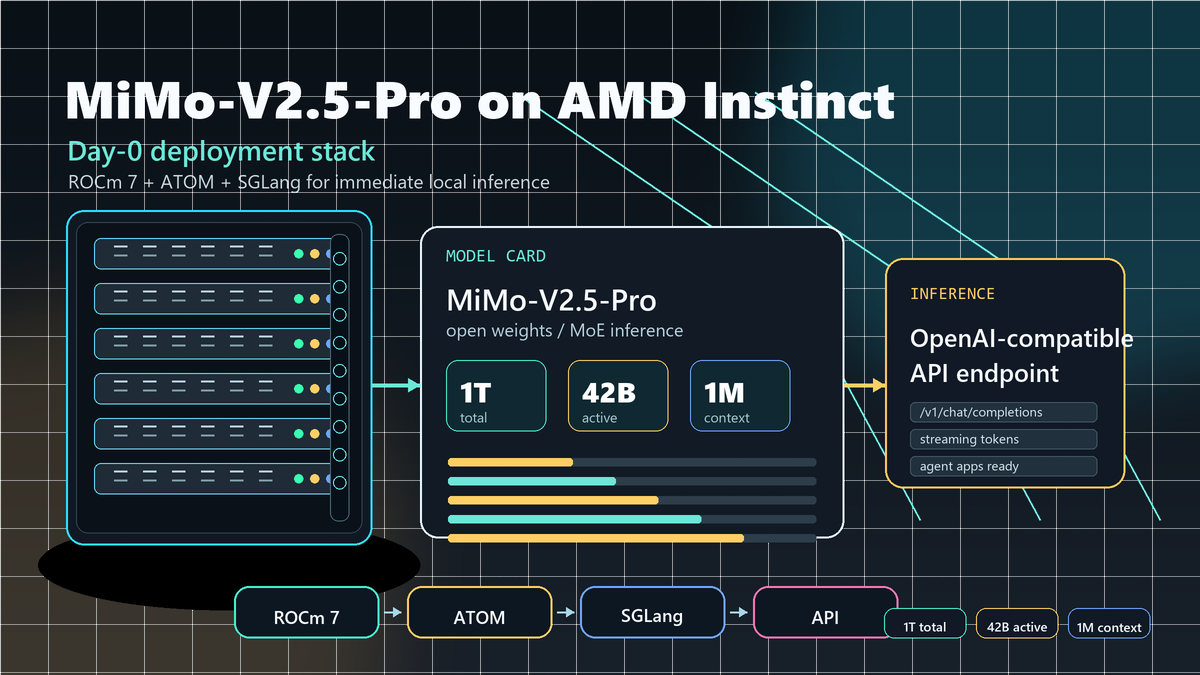

AMD가 2026년 4월 28일 Day 0 Support for Xiaomi MiMo-V2.5-Pro on AMD Instinct GPUs라는 기술 글을 공개했습니다. 핵심은 Xiaomi의 MiMo-V2.5-Pro를 AMD Instinct GPU에서 바로 구동할 수 있도록 ROCm 7, SGLang, ATOM 기반 배포 흐름을 정리했다는 점입니다.

Xiaomi MiMo 공식 페이지와 Hugging Face 모델 카드는 MiMo-V2.5-Pro를 1T급 total parameters, 42B active parameters, 최대 1M context를 가진 MoE 언어 모델로 소개합니다. 단순한 모델 카드 뉴스가 아니라, 대형 오픈 모델을 실제 inference stack에서 어떻게 굴릴지까지 같이 나온 사례입니다.

이번 이슈의 포인트는 모델 성능표보다 인프라입니다. 앞으로 오픈 모델 경쟁은 "누가 더 큰 모델을 공개했나"에서 끝나지 않고, 어떤 GPU와 서빙 엔진으로 바로 붙일 수 있는지까지 함께 보게 될 가능성이 큽니다.

이번 발표 뭐가 나왔나

AMD는 Xiaomi MiMo-V2.5-Pro가 AMD Instinct GPU에서 native로 실행되도록 Day 0 지원과 배포 가이드를 제공한다고 설명했습니다. AMD 글 기준 MiMo-V2.5 Series는 2026년 4월 23일 public beta에 들어갔고, 4월 28일 GA 및 open-source release로 이어졌습니다.

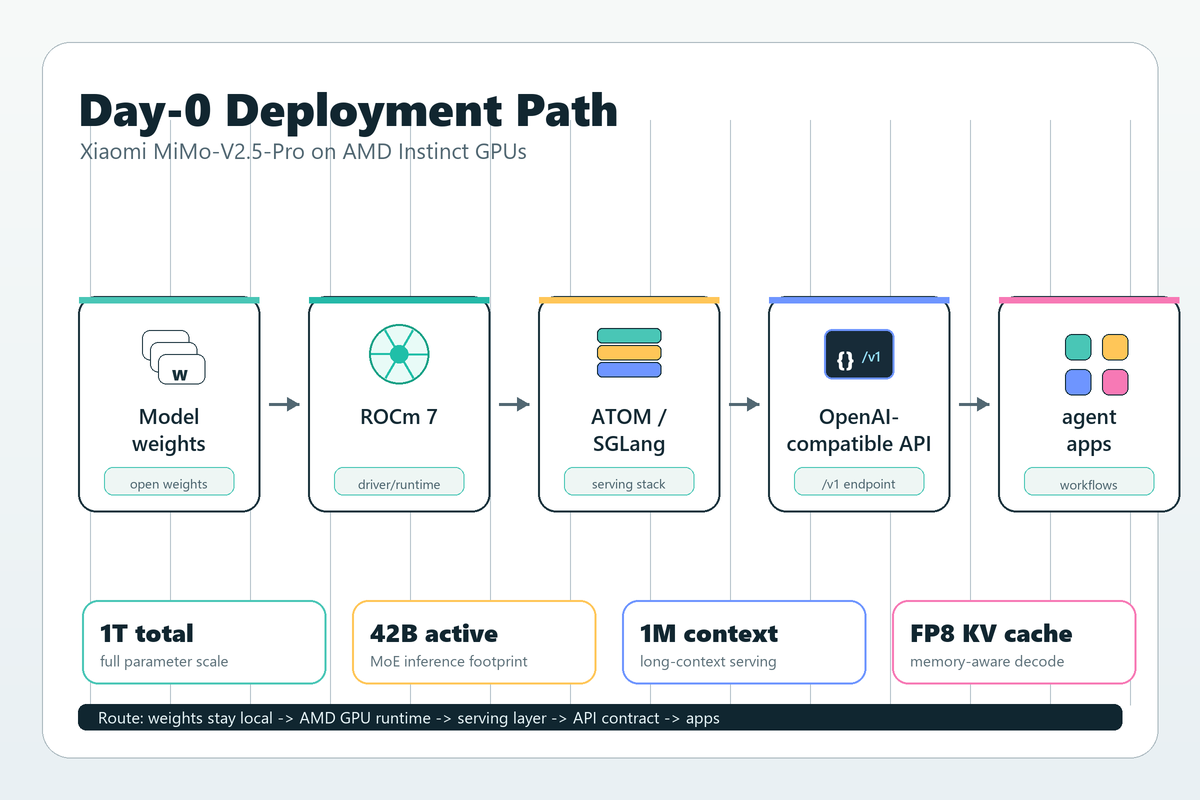

배포 스택은 비교적 선명합니다. AMD ROCm 7 위에서 SGLang과 ATOM을 활용하고, AMD 글은 Docker image, server 실행, lm_eval 평가, OpenAI-compatible server 흐름까지 보여줍니다.

모델 쪽 숫자도 큽니다. Hugging Face 모델 카드는 MiMo-V2.5-Pro를 1.02T total parameters, 42B active parameters, 최대 1M token context length를 가진 open-source MoE language model로 설명합니다. 라이선스는 MIT로 표시되어 있고, 파일은 Safetensors 형식입니다.

핵심 변화 3가지

1. 1T급 오픈 모델은 배포 스택이 곧 경쟁력이다

MiMo-V2.5-Pro는 숫자만 봐도 headline이 강합니다. 1T급 total parameters, 42B active parameters, 1M context는 일반적인 로컬 실험 모델과는 체급이 다릅니다.

하지만 이런 모델은 공개됐다는 사실만으로 실전 사용까지 이어지지 않습니다. 대형 MoE 모델은 메모리, KV cache, tensor parallelism, FP8, long-context serving 같은 운영 문제가 바로 따라옵니다. 그래서 AMD가 모델 공개 시점에 맞춰 Instinct GPU용 배포 글을 낸 점이 중요합니다.

2. OpenAI-compatible endpoint가 연결 비용을 낮춘다

AMD 글은 ATOM과 SGLang 실행 흐름을 보여주면서 OpenAI-compatible server를 띄우는 방식을 다룹니다. 요즘 많은 챗봇, agent, coding assistant, 내부 도구는 OpenAI API 형식에 맞춰져 있습니다.

그래서 모델을 바꿔도 /v1/chat/completions 계열 인터페이스를 유지할 수 있으면 전환 비용이 줄어듭니다. 개발팀 입장에서는 이 부분이 모델 스펙만큼 현실적인 장점입니다.

3. CUDA 중심 서빙 논의에 ROCm 선택지가 붙는다

대형 모델 서빙은 오랫동안 CUDA 중심으로 이야기되는 경우가 많았습니다. AMD가 Instinct GPU, ROCm 7, SGLang, ATOM 조합을 전면에 둔 것은 오픈 모델 인프라 선택지가 넓어지는 흐름으로 볼 수 있습니다.

물론 이게 곧바로 모든 팀의 비용을 낮춘다는 뜻은 아닙니다. 1T급 모델을 제대로 돌리려면 여전히 고가의 다중 GPU 환경과 서빙 경험이 필요합니다. 다만 하드웨어 공급자와 모델 공급자가 공개 당일에 맞춰 배포 경로를 제시하는 속도는 눈여겨볼 만합니다.

실제로 뭐가 달라지나

일반 독자에게는 "Xiaomi가 큰 오픈 모델을 냈다" 정도로 보일 수 있습니다. 하지만 제품이나 인프라를 보는 사람에게는 조금 다릅니다. 모델을 어디에서 돌릴지, 어떤 inference engine을 쓸지, 기존 앱과 어떻게 붙일지가 바로 실전 질문이 됩니다.

AI 제품을 만드는 팀이라면 이번 뉴스를 성능 뉴스보다 조합 뉴스로 보는 편이 더 실용적입니다. Xiaomi MiMo-V2.5-Pro, Hugging Face 모델 공개, AMD Instinct GPU, ROCm, SGLang, ATOM이 한 줄로 묶였습니다. 이 조합이 잘 굴러가면 closed model 하나에만 묶이지 않는 실험 여지가 커집니다.

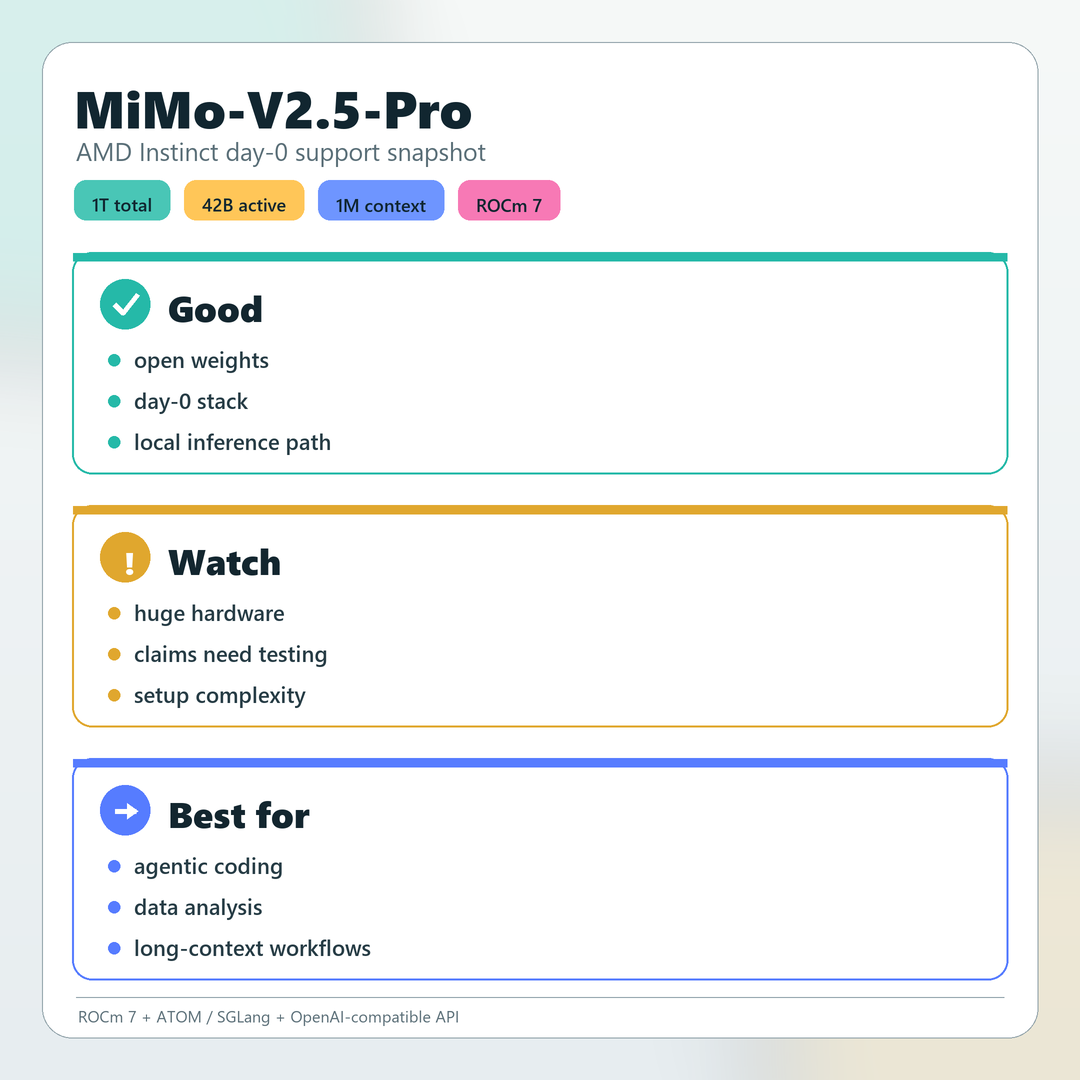

좋은 점

가장 좋은 점은 AMD 글이 추상적인 발표에서 끝나지 않는다는 겁니다. Docker 실행, server entrypoint, 평가 명령, chat completions 흐름까지 제시합니다. 개발자에게는 이런 글이 훨씬 쓸모 있습니다.

두 번째는 공개 시점입니다. AMD는 Day 0 지원을 강조합니다. 대형 오픈 모델이 공개되는 날 하드웨어와 소프트웨어 배포 경로가 함께 움직인다는 점은 오픈 모델 생태계의 속도가 빨라졌다는 신호입니다.

세 번째는 기본 정보가 비교적 선명하다는 점입니다. Hugging Face에는 MIT license, Safetensors, 1T params, F32/BF16/F8_E4M3 tensor type 같은 검토용 정보가 정리되어 있습니다.

아쉬운 점

첫 번째는 운영 난이도입니다. 1T급 모델은 아무리 active parameters가 42B라 해도 일반적인 개인 GPU 실험과는 다릅니다. AMD 글도 Instinct GPU와 multi-GPU 서빙을 전제로 설명합니다.

두 번째는 성능 주장을 조심해서 봐야 한다는 점입니다. AMD와 Xiaomi 쪽은 agentic workload, complex software engineering, long-horizon tasks를 강하게 강조합니다. 하지만 실제 체감은 벤치마크 조건, latency, 비용, tool use 안정성에 따라 크게 달라질 수 있습니다.

세 번째는 상대 시간 표기입니다. Hugging Face 페이지의 업데이트 시간은 조회 시점에 따라 달라질 수 있습니다. 그래서 이 글에서는 exact timestamp보다 2026년 4월 28일 공개 흐름과 공식 수치 중심으로만 정리했습니다.

내 생각

이번 뉴스에서 가장 재미있는 지점은 Xiaomi가 1T급 오픈 모델을 냈다는 사실보다, AMD가 거의 동시에 "이걸 우리 GPU에서 이렇게 돌리면 된다"는 글을 냈다는 점입니다.

오픈 모델 경쟁은 이제 모델 파일 공개만으로 끝나지 않습니다. 실제 서비스를 만들려면 서빙 엔진, GPU 메모리, 컨텍스트 길이, API 호환성, 평가 파이프라인이 필요합니다. MiMo-V2.5-Pro와 AMD의 Day 0 지원은 그 현실을 잘 보여줍니다.

결론

AMD의 MiMo-V2.5-Pro Day 0 지원은 1T급 오픈 모델 공개를 인프라 관점에서 바로 이어받은 발표입니다. 모델은 1.02T total parameters, 42B active parameters, 최대 1M context를 내세우고, AMD는 ROCm 7, SGLang, ATOM, AMD Instinct GPU 조합으로 배포 흐름을 제시했습니다.

핵심은 "큰 오픈 모델이 나왔다"에서 끝나지 않습니다. 이제는 그 모델을 어떤 GPU에서, 어떤 inference engine으로, 어떤 API 모양으로 서비스할 것인가가 바로 다음 경쟁 포인트입니다.

한 줄 평

MiMo-V2.5-Pro의 진짜 포인트는 1T 모델 공개와 동시에 배포 스택 경쟁도 같이 시작됐다는 점입니다.

참고 출처

- AMD, Day 0 Support for Xiaomi MiMo-V2.5-Pro on AMD Instinct GPUs

- Xiaomi MiMo, MiMo official site

- Hugging Face, XiaomiMiMo/MiMo-V2.5-Pro