한눈에 보기

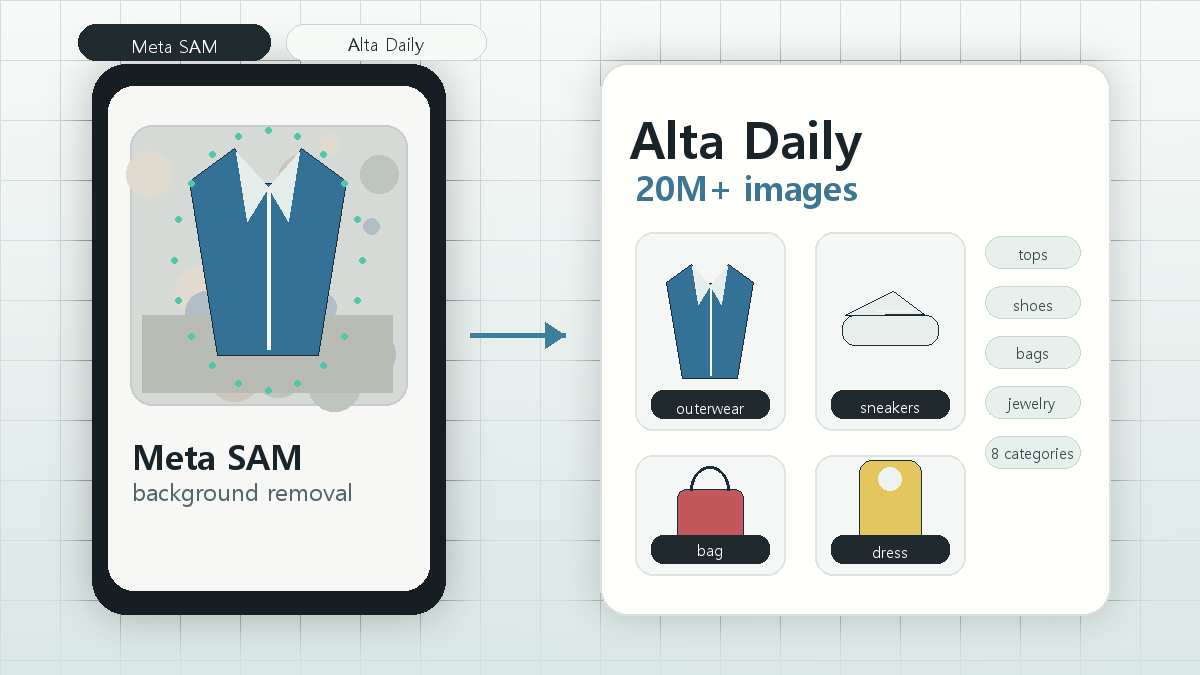

Meta AI가 Alta Daily의 Segment Anything Model 활용 사례를 공개했습니다. Alta Daily는 사용자가 자기 옷을 사진으로 찍어 디지털 옷장을 만들고, 자연어로 상황에 맞는 코디를 추천받고, 개인 Alta avatar에서 착장 모습을 확인하는 AI fashion app입니다.

이 사례의 핵심은 SAM이 단순한 컴퓨터비전 데모가 아니라 실제 제품 UX와 비용 구조 안에 들어갔다는 점입니다. 사용자가 올린 사진에서 옷만 정확히 남기는 segmentation 품질이 디지털 옷장 화면의 완성도를 좌우합니다.

Meta 공식 글에 따르면 Alta 팀은 여러 segmentation model을 8개 제품 카테고리에서 테스트했고, Meta Segment Anything Model이 일관되게 가장 좋은 결과를 냈다고 설명했습니다. 또 SAM을 사용해 2,000만 장 이상 이미지를 과도한 비용 없이 처리했다고 밝혔습니다.

이번 발표 뭐가 나왔나

Meta AI는 2026년 4월 6일 "How Alta Daily Uses Meta's Segment Anything to Reimagine the Digital Closet"라는 글에서 Alta Daily 사례를 소개했습니다.

Alta Daily는 2025년 출시된 AI fashion app입니다. 사용자가 옷장 전체를 사진으로 찍어 digitize하고, 자연어 prompt로 특정 상황에 맞는 outfit을 추천받고, 개인 avatar에서 착장 결과를 확인하는 흐름입니다. 매일 입은 옷도 추적해 같은 옷을 반복해서 입는 일을 줄일 수 있다고 설명됩니다.

겉으로 보면 패션 앱 이야기지만, 안쪽을 보면 꽤 전형적인 컴퓨터비전 제품화 문제입니다. 사용자가 올리는 사진은 쇼핑몰처럼 잘 정돈된 이미지가 아닙니다. 흰 운동화를 흰 벽 앞에서 찍을 수도 있고, 파란 스웨터를 파란 담요 위에 던져놓고 찍을 수도 있습니다.

핵심 변화 3가지

1. Segmentation 품질이 곧 제품 UX가 된다

Alta Daily가 원하는 화면은 패션 잡지처럼 깔끔한 digital closet입니다. 그러려면 사용자가 올린 사진에서 배경을 지우고 옷만 정확히 남겨야 합니다.

이 작업이 흔들리면 UI가 아무리 좋아도 제품 경험이 지저분해집니다. 옷의 가장자리가 잘리거나, 배경이 남거나, 소재 색이 달라 보이거나, 장신구처럼 작은 물체가 사라지면 사용자는 앱을 신뢰하기 어렵습니다.

Meta 글에 따르면 Alta Daily 팀은 선글라스부터 신발까지 8개 제품 카테고리에서 여러 segmentation model을 테스트했고, SAM이 가장 일관된 결과를 냈다고 설명했습니다. mirror selfie, 카펫 위에 놓인 옷, 복잡한 장신구, 반사 소재, 얇은 옷걸이, 사람 모델 주변까지 처리해야 했기 때문입니다.

2. 비용 구조도 모델 선택의 일부다

이 사례에서 재미있는 부분은 비용입니다. Alta CEO Jenny Wang은 초기에 살펴본 외부 segmentation API가 이미지당 몇 센트 수준이라 비용이 빠르게 커졌다고 설명했습니다.

이미지 한 장만 보면 작은 비용처럼 보입니다. 하지만 사용자가 매초 사진을 올리는 앱이라면 이야기가 달라집니다. 디지털 옷장 앱은 사용자가 사진을 많이 올릴수록 가치가 커지는데, 처리 단가가 높으면 성장 자체가 비용 부담으로 바뀝니다.

Meta는 SAM을 사용해 Alta 팀이 2,000만 장 이상 이미지를 과도한 비용 없이 처리할 수 있었다고 설명했습니다. 이건 단순 성능 문제가 아니라 스타트업의 unit economics 문제입니다.

3. SAM 3와 SAM 3D가 후속 UX로 이어진다

Meta 글은 Alta Head of Engineering Joon Kim의 avatar에 표시된 한 달치 outfit 이미지가 SAM 3로 segmented됐다고 설명합니다. 이 대목은 SAM이 단순 상품 썸네일 배경 제거에서 끝나지 않고, avatar 기반 착장 미리보기 UX와 연결된다는 점을 보여줍니다.

또 Alta 팀은 Meta의 SAM 3D models도 실험 중이라고 합니다. 앞으로 digital avatar와 사용자가 상호작용하는 방식이 더 입체적으로 바뀔 수 있다는 뜻입니다.

다만 이 부분은 아직 실험 단계로 읽어야 합니다. SAM 3D가 어떤 품질과 비용으로 실제 제품에 들어갈지는 별도 검증이 필요합니다.

본문 이미지

실제로 뭐가 달라지나

일반 사용자에게는 "옷 사진이 깔끔하게 정리된다"로 보입니다. 하지만 그 뒤에는 배경 제거, 물체 경계 추정, 색 보존, 소재 반사 처리, 작은 액세서리 인식 같은 컴퓨터비전 문제가 숨어 있습니다.

개발자에게는 사용자 업로드 이미지가 얼마나 어려운 입력인지 다시 보여주는 사례입니다. 데모 이미지에서 잘 되는 모델과 실제 사용자가 매일 올리는 사진을 처리하는 모델은 다릅니다. 제품에서는 edge case가 일상이 됩니다.

창업자에게는 외부 API 단가와 자체 모델 운영 사이의 손익분기점이 보입니다. 초반에는 외부 API가 빠르지만, 이미지 처리량이 수천만 장으로 커지면 모델 운영 비용과 품질 통제력이 중요해집니다.

좋은 점

좋은 점은 SAM의 가치가 추상적인 benchmark가 아니라 제품의 구체적인 문제와 연결됐다는 점입니다. Alta Daily는 segmentation 품질을 clean interface, digital wardrobe, avatar try-on, 처리 비용과 연결해 설명할 수 있습니다.

또 패션 이미지처럼 복잡한 도메인에서 user-uploaded content를 다뤘다는 점도 실전적입니다. 쇼핑몰 상품 이미지처럼 통제된 데이터가 아니라, 조명과 배경과 촬영 각도가 제각각인 사진을 처리해야 했기 때문입니다.

아쉬운 점

아쉬운 점은 공개된 내용이 사례 소개 중심이라는 점입니다. 8개 카테고리 테스트에서 어떤 모델과 어떤 metric으로 비교했는지, SAM 3의 정확도나 latency가 어느 정도였는지는 자세히 공개되어 있지 않습니다.

또 비용 절감도 정량적으로는 "외부 API는 몇 센트", "2,000만 장 이상 처리" 정도의 서술입니다. 실제 GPU 비용, 인프라 운영비, 후처리 비용까지 포함한 total cost는 공개된 글만으로는 알기 어렵습니다.

내 생각

나는 이 사례가 패션 앱 성공담이라기보다 컴퓨터비전 제품화 사례로 더 흥미롭습니다. AI 기능을 붙였다는 말보다, 사용자가 올리는 지저분한 사진을 얼마나 안정적으로 제품 데이터로 바꾸느냐가 핵심입니다.

요즘 AI 제품에서 자주 빠지는 질문이 있습니다. 모델이 잘하느냐보다 "그 모델이 실제 사용자의 불규칙한 입력과 비용 구조를 버틸 수 있느냐"입니다. Alta Daily 사례는 이 질문을 꽤 선명하게 보여줍니다.

SAM이 멋진 이유도 여기 있습니다. demo가 아니라 upload pipeline, UI consistency, cost control, avatar experience까지 이어졌습니다. 결국 좋은 AI 모델은 제품 안에서 조용히 반복 작업을 줄이고, 화면을 깨끗하게 만들고, 비용을 낮추는 방식으로 힘을 발휘합니다.

요약 카드 이미지

결론

Alta Daily 사례는 Meta SAM이 실제 앱의 UX와 비용 구조 안에 들어간 예입니다. 사용자가 올린 옷 사진에서 배경을 제거하고, 디지털 옷장에 넣고, avatar 착장 화면으로 이어지는 흐름은 모두 segmentation 품질 위에 올라갑니다.

개발자와 창업자에게는 모델 성능뿐 아니라 user-uploaded content의 난도, 처리 단가, 후처리 파이프라인, UX 일관성을 같이 봐야 한다는 교훈이 있습니다.

한 줄 평

Meta SAM Alta Daily 사례는 좋은 computer vision 모델이 제품에서 어디서 돈을 아끼고, 어디서 UX를 바꾸는지 보여주는 실전 사례입니다.