한눈에 보기

Google Research가 2026년 4월 22일 Google Photos의 Auto frame 기능에 들어간 AI 기반 사진 재구도 기술을 공개했습니다.

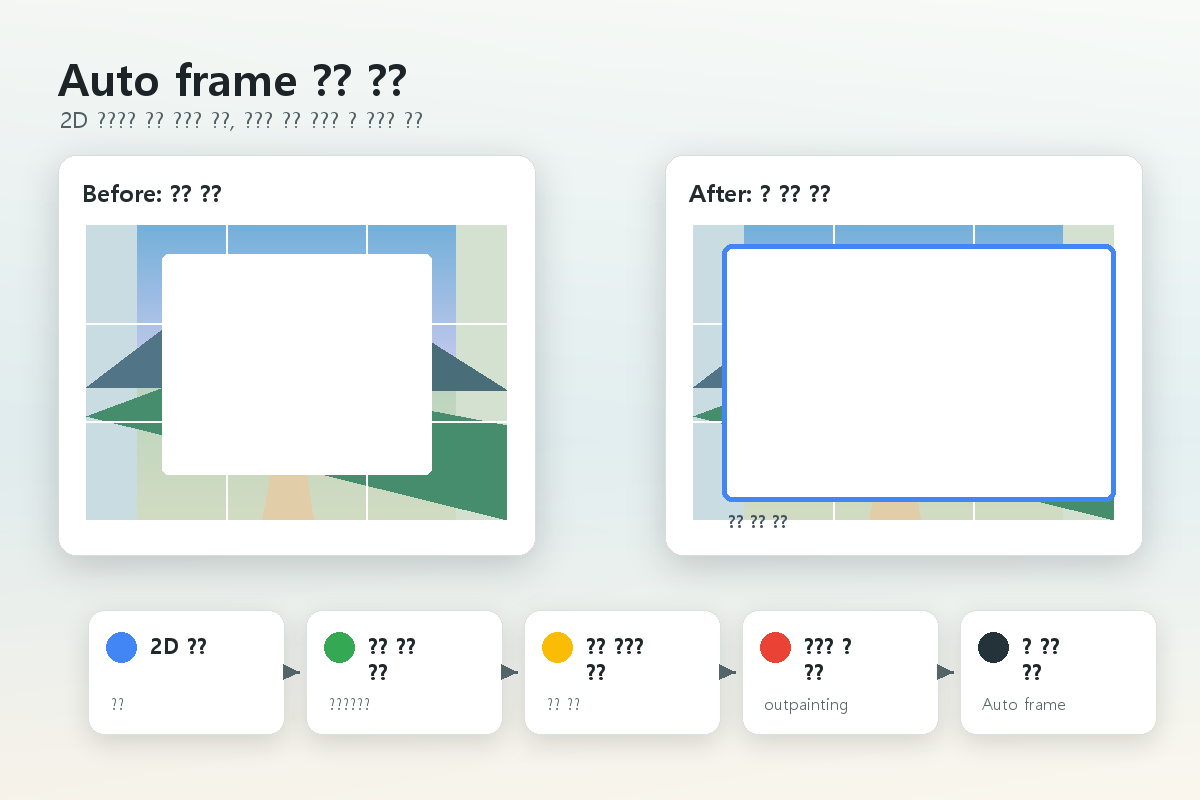

핵심은 단순 crop이나 배경 outpainting이 아닙니다. 2D 사진을 3D 장면처럼 해석하고, 원래 카메라 위치와 초점거리를 추정한 뒤, 가상의 카메라 관점을 바꿔 새로운 구도를 만듭니다. 그 과정에서 원본에 없던 배경 영역은 생성형 AI로 채웁니다.

쉽게 말하면 "이 사진을 조금만 다른 위치에서 찍었더라면"을 촬영 후에 다시 계산하는 기능입니다.

이번 발표 뭐가 나왔나

Google Research 글의 제목은 It's all about the angle: Your photos, re-composed입니다. 글은 Google Photos의 Auto frame 안에 이미 적용된 새로운 이미지 편집 접근을 설명합니다.

Google의 설명에 따르면 이 방식은 사진을 고정된 2D 이미지로만 보지 않습니다. 사진 속 장면의 공간 구조를 이해하고, 카메라가 어디에 있었는지 추정한 다음, 그 카메라를 가상으로 옮긴 새 관점에서 이미지를 다시 렌더링합니다.

기존 편집과 다른 점은 분명합니다. crop은 보이는 영역을 잘라낼 뿐이고, zoom은 시차를 바꾸지 못합니다. outpainting은 프레임 밖을 그럴듯하게 채울 수 있지만, 카메라 관점 자체를 자연스럽게 바꾸는 문제와는 다릅니다. Auto frame의 새 방식은 이 세 가지를 한 번에 다룹니다.

핵심 변화 3가지

1. 사진을 2D 이미지가 아니라 3D 장면처럼 본다

첫 단계는 3D scene and camera estimation입니다. Google은 원본 사진의 각 픽셀에 대해 보이는 표면 조각을 3D point로 추정하고, 원래 카메라의 focal length도 근사합니다.

이렇게 하면 단순히 이미지를 좌우로 늘리거나 자르는 것이 아니라, 카메라 pose와 focal length를 바꿨을 때 장면이 어떻게 보일지 계산할 수 있습니다. 사진 편집이 픽셀 조작에서 장면 재구성으로 넘어가는 지점입니다.

2. 얼굴과 인물 구도에 맞춰 카메라 관점을 자동 제안한다

Google은 인물 사진에서 주 피사체의 얼굴 위치와 3D 방향을 감지해 더 나은 framing을 계산한다고 설명했습니다.

특히 wide-angle front camera로 찍은 사진은 가까운 얼굴 부위가 부자연스럽게 커 보이는 왜곡이 생길 수 있습니다. Auto frame은 이런 왜곡을 감지하고 virtual camera intrinsics를 조정해 더 자연스러운 비율을 만들 수 있습니다.

3. 생성형 AI는 빈 공간을 채우는 역할을 맡는다

가상의 카메라를 움직이면 원본 사진에는 없던 배경 영역이 새로 드러납니다. 3D point map만 렌더링하면 구멍이 생기는 이유입니다.

Google은 이 부분을 generative latent diffusion model로 보완한다고 설명했습니다. 즉 생성형 AI가 사진 전체를 마음대로 다시 그리는 구조라기보다, 먼저 장면 구조와 카메라 관점을 계산하고 그 결과에서 부족한 영역을 채우는 방식에 가깝습니다.

본문 이미지

실제로 뭐가 달라지나

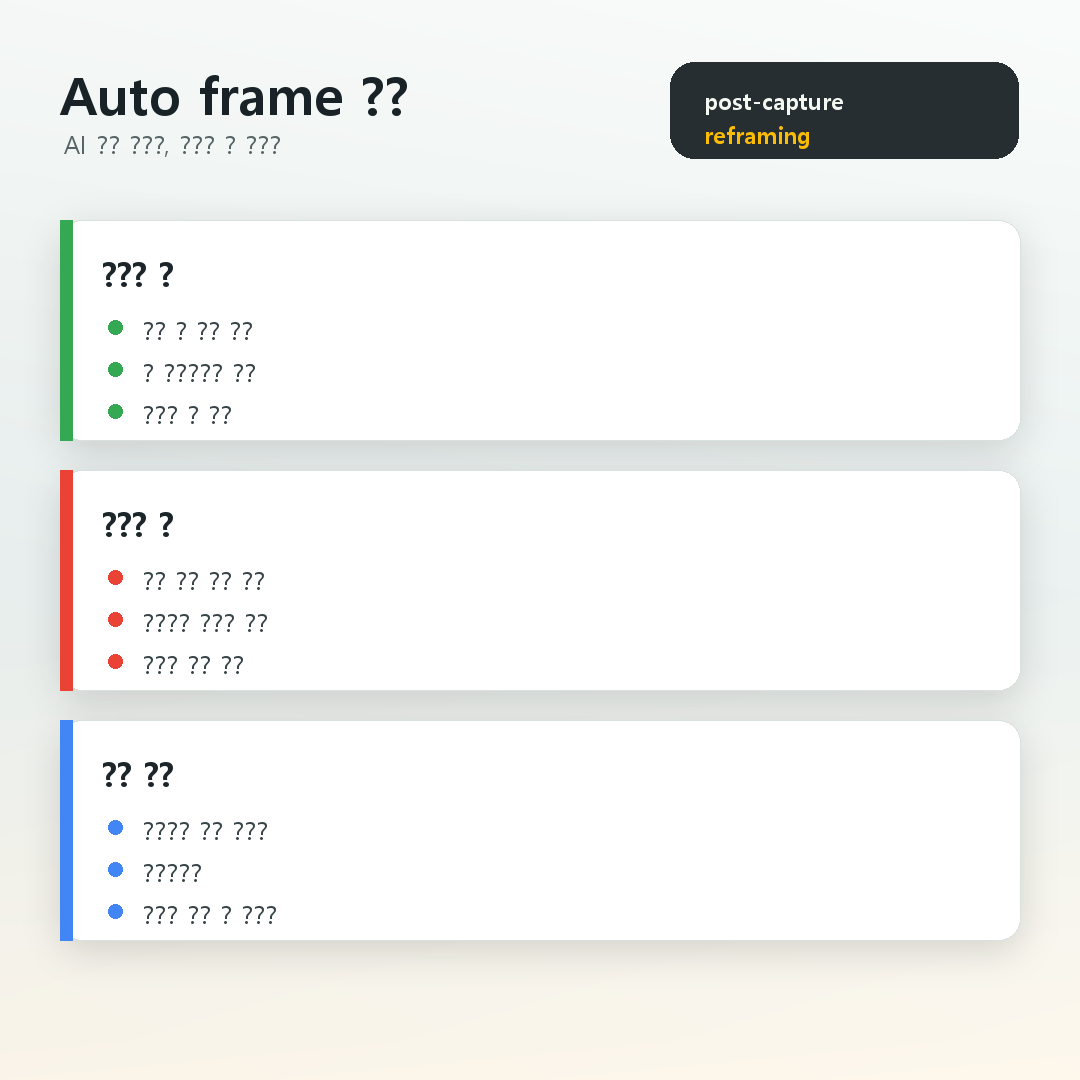

일반 사용자

사용자에게는 "조금 더 잘 찍힌 사진 후보"가 하나 더 생기는 느낌에 가깝습니다. Google은 eligible photos that contain people에서 Auto frame 후보 중 두 번째 rendition option으로 자동 재구도 이미지를 볼 수 있다고 설명했습니다.

예를 들어 얼굴이 너무 가까이 찍혔거나, 배경이 조금만 더 보였으면 좋겠거나, 셀피의 왜곡이 어색할 때 쓸 수 있습니다. 사용자는 3D point map이나 camera intrinsics를 몰라도 됩니다. 그냥 Auto frame 후보를 고르면 됩니다.

개발자

개발자에게 흥미로운 부분은 생성형 AI 하나로 끝내지 않았다는 점입니다. Google은 3D 추정과 이미지 생성을 분리했습니다. 먼저 monocular depth와 semantic information으로 장면 구조와 target camera parameters를 잡고, 이후 diffusion model로 비어 있는 영역을 완성합니다.

이 패턴은 사진 편집뿐 아니라 커머스 이미지, virtual try-on, AR, 아바타, 제품 촬영 보정에도 참고할 만합니다. "그럴듯하게 그리기"보다 "장면 구조를 먼저 맞추고 생성으로 마감하기"가 핵심입니다.

창업자

창업자라면 이 기능이 어떻게 제품 안에 숨어 들어갔는지 보는 게 좋습니다. 사용자는 AI 모델 구조를 보지 않습니다. 그냥 사진 앱 안에서 자연스럽게 하나의 보정 후보를 받습니다.

AI 기능이 좋은 제품 기능이 되려면 연구 성과를 그대로 노출하는 것보다, 기존 사용 흐름 안에서 한 번의 선택지로 녹이는 쪽이 강합니다. Auto frame은 그 방향을 잘 보여줍니다.

좋은 점

가장 좋은 점은 이미지 편집을 "빈 곳 채우기"로만 보지 않았다는 겁니다. 사진에는 원근, 시점, 피사체 구조가 있습니다. 이걸 무시하고 배경만 늘리면 그럴듯하지만 어딘가 이상한 결과가 나오기 쉽습니다.

이번 접근은 먼저 장면 구조를 추정하고, 카메라를 움직이고, 그 결과 생긴 빈 공간을 생성 모델로 보완합니다. 순서가 꽤 중요합니다.

또 하나는 실제 제품 적용입니다. Google Research와 Google DeepMind, Google Platforms & Devices 팀 협업 결과가 Google Photos 안에 이미 들어갔습니다. 연구 블로그에서 끝나는 이야기가 아니라 사용자가 만지는 기능이 됐다는 점이 좋습니다.

아쉬운 점

아쉬운 부분도 있습니다. 발표 글만 보면 실제 제공 범위, 지원 기기, 실패 조건, 지역별 출시 상태를 세세하게 알기는 어렵습니다.

그리고 사진 편집에서 생성 영역이 늘어날수록 "기록"과 "창작"의 경계가 흐려집니다. 가족 사진, 여행 사진, 증빙 사진처럼 맥락이 중요한 이미지에서는 어디까지가 원본이고 어디부터가 AI 보완인지 사용자가 알 수 있어야 합니다.

기술적으로도 한계는 남습니다. 원본에 정보가 부족하거나 장면이 복잡하면 3D 구조 추정과 빈 영역 생성 모두 흔들릴 수 있습니다. 편한 기능이지만 마법은 아닙니다. 아직은 조건이 맞는 사진에서 강한 도구로 보는 게 맞습니다.

내 생각

이번 발표는 스마트폰 사진의 후처리가 이제 "보정"에서 "시점 재구성"으로 넘어가고 있다는 신호처럼 보입니다.

예전에는 사진을 찍는 순간 구도와 거리와 각도가 거의 결정됐습니다. AI 편집이 발전하면서 촬영 후에도 그 결정 일부를 되돌릴 수 있게 됐습니다. 아주 큰 변화입니다.

다만 이 흐름이 좋아질수록 투명성도 중요해집니다. 사진이 더 보기 좋아지는 것과, 사진이 원래 장면을 얼마나 충실히 남기는지는 같은 문제가 아닙니다. 제품은 편해야 하고, 동시에 사용자가 AI 보완 여부를 이해할 수 있어야 합니다.

요약 카드 이미지

결론

Google Photos Auto frame의 새 AI 기술은 단순한 자동 크롭 기능으로 보기 어렵습니다. 2D 사진에서 3D 장면 구조와 카메라 관점을 추정하고, 새 관점에서 생기는 빈 영역을 생성형 AI로 보완하는 흐름입니다.

사용자에게는 더 자연스러운 사진 후보 하나가 추가되는 일이지만, 기술적으로는 computer vision과 generative AI가 꽤 촘촘하게 결합된 사례입니다. AI 이미지 편집이 앞으로 어디로 갈지 보여주는 좋은 제품형 연구 발표입니다.

한 줄 평

Google Photos Auto frame은 사진 편집을 "잘라내기"에서 "촬영 후 시점 재구성"으로 밀어 올린 기능입니다.