한눈에 보기

GitHub가 Copilot interaction data usage policy 업데이트를 공지했습니다. 적용 시점은 2026년 4월 24일부터입니다.

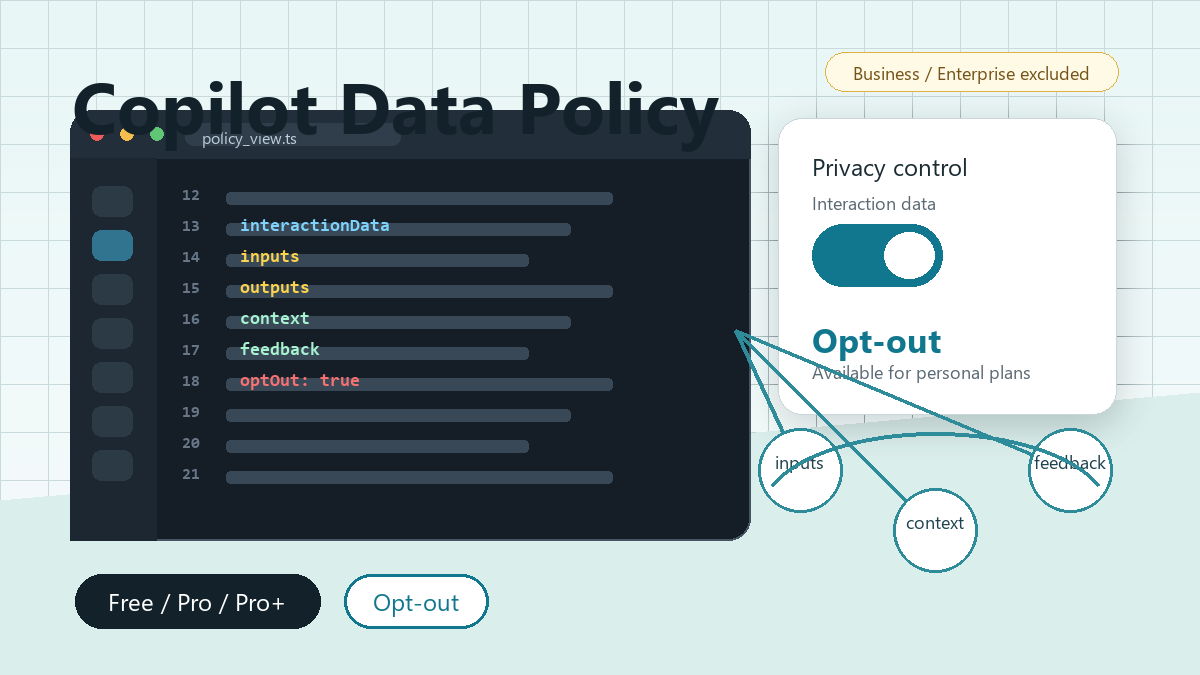

핵심은 Copilot Free, Copilot Pro, Copilot Pro+ 사용자의 interaction data가 AI 모델 학습과 개선에 사용될 수 있다는 점입니다. 단, 개인 설정에서 opt out 할 수 있습니다.

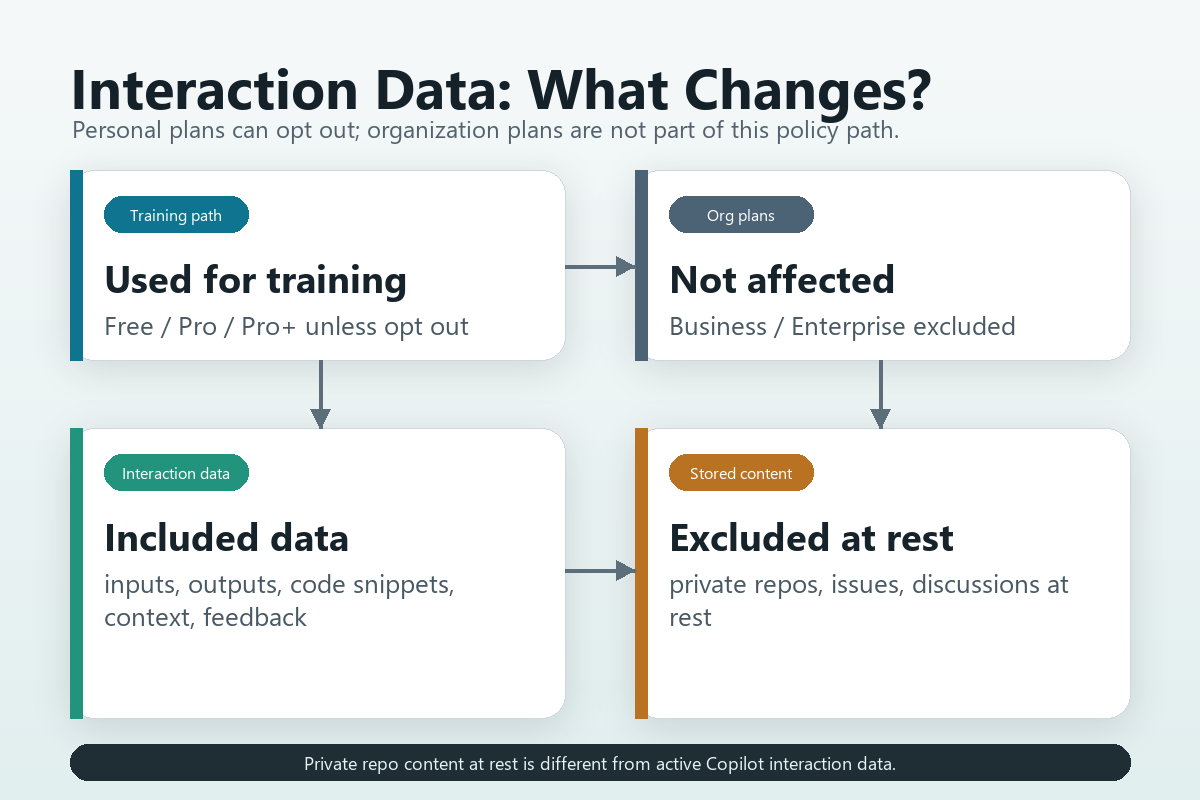

반대로 Copilot Business, Copilot Enterprise, enterprise-owned repositories의 interaction data는 이번 업데이트 대상이 아니라고 GitHub는 설명했습니다. 그래서 이 이슈는 "Copilot이 회사 코드를 전부 학습한다"처럼 단순하게 볼 사안이 아닙니다. 플랜, 저장소 소유권, opt out 설정을 구분해서 봐야 합니다.

이번 발표 뭐가 나왔나

GitHub 공식 블로그에 따르면 2026년 4월 24일부터 Copilot Free, Pro, Pro+ 사용자의 interaction data는 모델 학습과 개선에 쓰일 수 있습니다.

GitHub가 예시로 든 interaction data에는 사용자가 수락하거나 수정한 출력, Copilot에 보낸 입력과 프롬프트, 모델에 보여진 code snippets, 커서 주변 code context, comments와 documentation, file names, repository structure, navigation patterns, Copilot Chat과 inline suggestions 사용 내역, thumbs up/down feedback이 포함됩니다.

GitHub Docs도 같은 방향으로 설명합니다. 개인 subscriber가 Free, Pro, Pro+ plan을 쓰는 경우 interactions가 AI 모델 학습과 개선에 사용될 수 있고, personal settings에서 이를 끌 수 있습니다.

핵심 변화 3가지

1. 개인 플랜은 기본 확인 대상이다

이번 정책 변경의 직접 대상은 Copilot Free, Copilot Pro, Copilot Pro+입니다. 개인 개발자, 사이드 프로젝트 사용자, 초기 팀에서 개인 구독으로 Copilot을 쓰는 경우가 여기에 들어갈 수 있습니다.

중요한 점은 "프롬프트만"이 아니라 code context와 repository structure 같은 주변 맥락도 interaction data 범위에 들어간다는 것입니다. Copilot이 IDE 안에서 유용하게 동작하려면 주변 코드를 봐야 하고, 그 과정에서 interaction data가 생깁니다.

따라서 개인 플랜 사용자는 감으로 넘기기보다 GitHub Copilot personal settings에서 AI model training 관련 설정을 확인하는 것이 맞습니다.

2. opt out은 가능하다

GitHub는 원하지 않는 사용자가 personal settings에서 opt out 할 수 있다고 안내했습니다. GitHub Docs 기준으로는 Copilot settings에서 "Allow GitHub to use my data for AI model training" 항목을 Disabled로 바꾸는 방식입니다.

또 GitHub 블로그는 기존에 product improvements 데이터 수집을 꺼둔 사용자는 그 선택이 유지된다고 설명했습니다. 즉 이미 관련 설정을 꺼둔 사람이라면 새로 자동 동의되는지부터 불안해하기보다 현재 설정이 어떻게 되어 있는지 확인하는 편이 현실적입니다.

여기서 중요한 실무 포인트는 설정 위치입니다. IDE 플러그인 설정만 볼 것이 아니라 GitHub 계정의 Copilot settings를 봐야 합니다.

3. Business와 Enterprise는 별도 범위다

GitHub는 Copilot Business와 Copilot Enterprise 사용자의 데이터는 이번 업데이트 영향을 받지 않는다고 설명했습니다. GitHub Docs도 Business와 Enterprise customer data는 Data Protection Agreement에 따라 고객 승인 없이 AI 모델 학습에 사용되지 않는다고 안내합니다.

회사에서 Copilot을 쓰는 팀이라면 이 구분이 중요합니다. 구성원이 개인 Pro 계정으로 회사 코드를 작업하는지, 조직이 Copilot Business 또는 Enterprise로 관리하는지에 따라 정책 적용을 이해하는 방식이 달라질 수 있습니다.

팀 리드나 창업자가 확인할 것은 공포 분위기를 만드는 것이 아니라 계정과 저장소 소유권입니다. 회사 코드는 가능한 조직 관리 플랜과 조직 정책 안에서 돌아가게 하는 편이 깔끔합니다.

본문 이미지

private repository는 어떻게 봐야 하나

GitHub는 issues, discussions, private repositories at rest는 이 프로그램에서 사용하지 않는다고 설명했습니다.

여기서 at rest라는 표현이 중요합니다. 저장소에 가만히 보관된 private repository 내용을 그대로 학습에 쓴다는 설명은 아닙니다. 반대로 private repository에서 Copilot을 능동적으로 사용할 때는 서비스 운영을 위해 코드 맥락이 처리될 수 있습니다.

GitHub도 Copilot은 사용자가 Copilot을 적극적으로 사용할 때 private repository의 코드를 처리한다고 설명합니다. 그리고 개인 플랜 사용자가 opt out 하지 않았다면, 그런 interaction data가 모델 학습과 개선에 사용될 수 있습니다.

따라서 둘 다 과장입니다. "private repo니까 무조건 무관하다"도 아니고, "private repo가 통째로 학습된다"도 아닙니다. Copilot을 실제로 사용할 때 생기는 interaction data, 내 플랜, opt out 설정을 같이 봐야 합니다.

데이터 공유 범위

GitHub는 이 프로그램에서 쓰이는 데이터가 GitHub affiliates, including Microsoft와 공유될 수 있다고 설명했습니다.

반면 third-party AI model providers나 independent service providers와는 공유되지 않는다고 밝혔습니다. 이 문구도 회사 정책을 세우는 사람이라면 확인할 필요가 있습니다.

특히 고객사 보안 심사나 계약에서 AI coding assistant 사용 여부를 묻는 경우가 늘고 있다면, 이번 정책 변경은 내부 가이드 업데이트의 계기가 될 수 있습니다.

개발자와 팀이 바로 확인할 것

개인 개발자라면 GitHub Copilot personal settings에서 AI model training 관련 opt out 상태를 확인하는 것이 첫 번째입니다. Copilot Free, Pro, Pro+를 쓰고 있다면 이번 정책 대상에 들어갑니다.

팀 리드라면 구성원이 어떤 계정과 플랜으로 Copilot을 쓰는지 확인해야 합니다. 회사 저장소를 개인 구독 Copilot으로 작업하고 있다면 조직 차원의 정책과 맞는지 점검할 필요가 있습니다.

창업자라면 "Copilot을 쓰지 말자"보다 "어떤 플랜으로, 어떤 저장소에서, 어떤 설정으로 쓸지"를 정하는 것이 더 실용적입니다. 초기 팀일수록 개인 계정과 회사 코드가 섞이기 쉽기 때문에, 이런 정책 변경이 나왔을 때 선을 그어두는 편이 나중에 덜 피곤합니다.

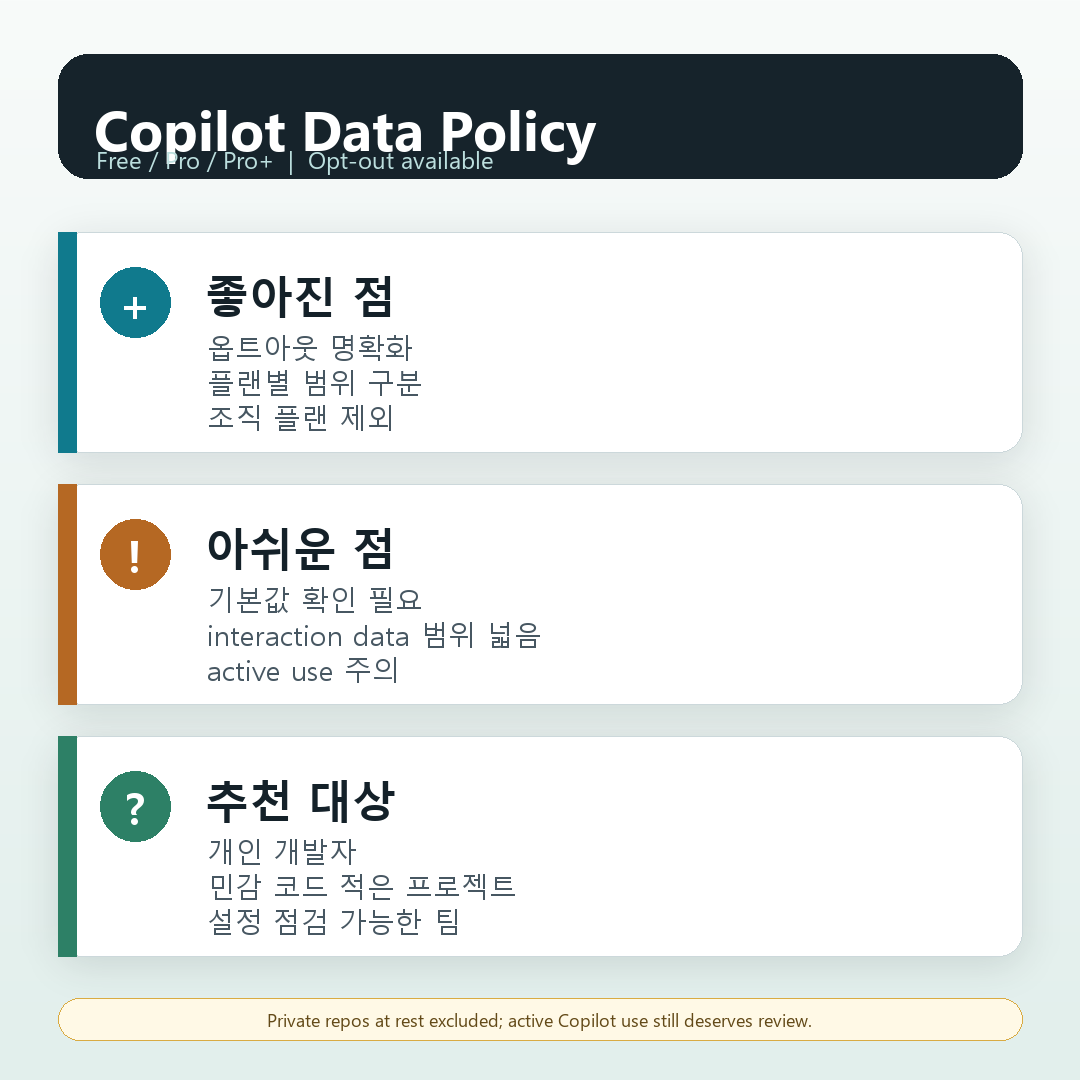

좋은 점

좋은 점은 GitHub가 데이터 사용 범위를 비교적 구체적으로 적었다는 것입니다. accepted outputs, prompts, code snippets, cursor context, repository structure, feedback처럼 사용자가 확인할 수 있는 범위가 나열돼 있습니다.

또 opt out이 제공되고, Business와 Enterprise는 별도 보호 범위로 설명됩니다. 조직 입장에서는 개인 플랜과 조직 플랜을 구분해 정책을 세울 수 있습니다.

아쉬운 점

아쉬운 점은 interaction data라는 개념이 일반 사용자에게 직관적이지 않다는 것입니다. Copilot을 쓰는 순간 어떤 맥락이 모델에 전달되는지, 어떤 데이터가 학습과 개선에 쓰일 수 있는지 개발자가 직접 이해하기 어렵습니다.

또 개인 플랜으로 회사 코드를 작업하는 관행이 있는 팀은 이 변경을 계기로 불편한 질문을 해야 합니다. 개인 편의로 쓰던 도구가 조직 데이터 정책과 충돌할 수 있기 때문입니다.

내 생각

이번 이슈는 "Copilot을 쓰면 위험하다"로 몰아갈 사안이 아닙니다. 더 정확히는 "AI 개발 도구를 어떤 설정과 책임 범위 안에서 쓸 것인가"의 문제입니다.

Copilot 같은 도구는 코드 맥락을 알아야 제대로 작동합니다. 그 맥락이 interaction data로 남고, 개인 플랜에서는 학습과 개선에 쓰일 수 있다는 점을 이해해야 합니다.

팀에서는 개인 생산성보다 운영 기준이 중요해집니다. 어떤 저장소에서 Copilot을 허용할지, 개인 플랜 사용을 허용할지, Business나 Enterprise로 통제할지, opt out 상태를 어떻게 확인할지 정해야 합니다.

요약 카드 이미지

결론

GitHub Copilot 데이터 정책 변경은 개인 플랜 사용자에게 직접적인 확인 포인트가 있습니다. 2026년 4월 24일부터 Copilot Free, Pro, Pro+의 interaction data는 AI 모델 학습과 개선에 사용될 수 있고, 원하지 않으면 personal settings에서 opt out 할 수 있습니다.

반대로 Copilot Business, Copilot Enterprise, enterprise-owned repositories interaction data는 이번 업데이트 대상이 아니라고 GitHub는 설명했습니다.

정리하면, 개인은 설정을 확인하고, 팀은 계정과 플랜, 저장소 소유권을 확인해야 합니다. AI 코딩 도구를 쓰는 기준은 이제 기능 선택이 아니라 데이터 운영 정책의 일부입니다.

한 줄 평

GitHub Copilot 데이터 정책 변경은 개인 플랜 사용자에게 opt out 확인을, 팀에는 조직 관리 플랜과 코드 데이터 정책 점검을 요구하는 업데이트입니다.