한눈에 보기

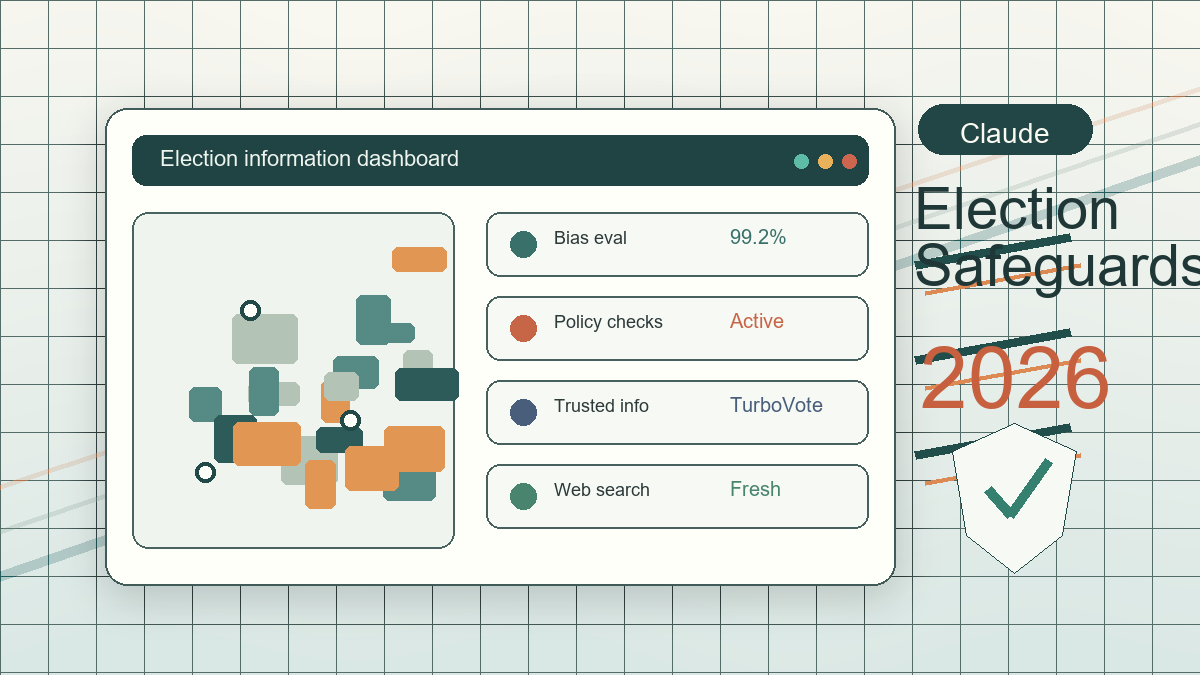

Anthropic이 2026년 4월 24일 Claude의 선거 관련 안전장치 업데이트를 공개했습니다. 배경은 2026년 미국 중간선거와 올해 예정된 주요 글로벌 선거입니다.

핵심은 "선거 질문은 아예 답하지 않는다"가 아닙니다. 정치 편향을 줄이고, 선거 악용 요청은 막고, 투표 정보처럼 바뀌기 쉬운 내용은 신뢰 가능한 리소스와 웹 검색으로 보강하겠다는 방향입니다.

다만 중요한 전제가 있습니다. Anthropic이 공개한 95%, 99.8%, 94% 같은 수치는 Anthropic 자체 평가 결과입니다. 독립 외부 검증값처럼 받아들이기보다는, Anthropic이 어떤 기준으로 모델 안전장치를 점검하는지 보여주는 자료로 보는 편이 맞습니다.

이번 발표 뭐가 나왔나

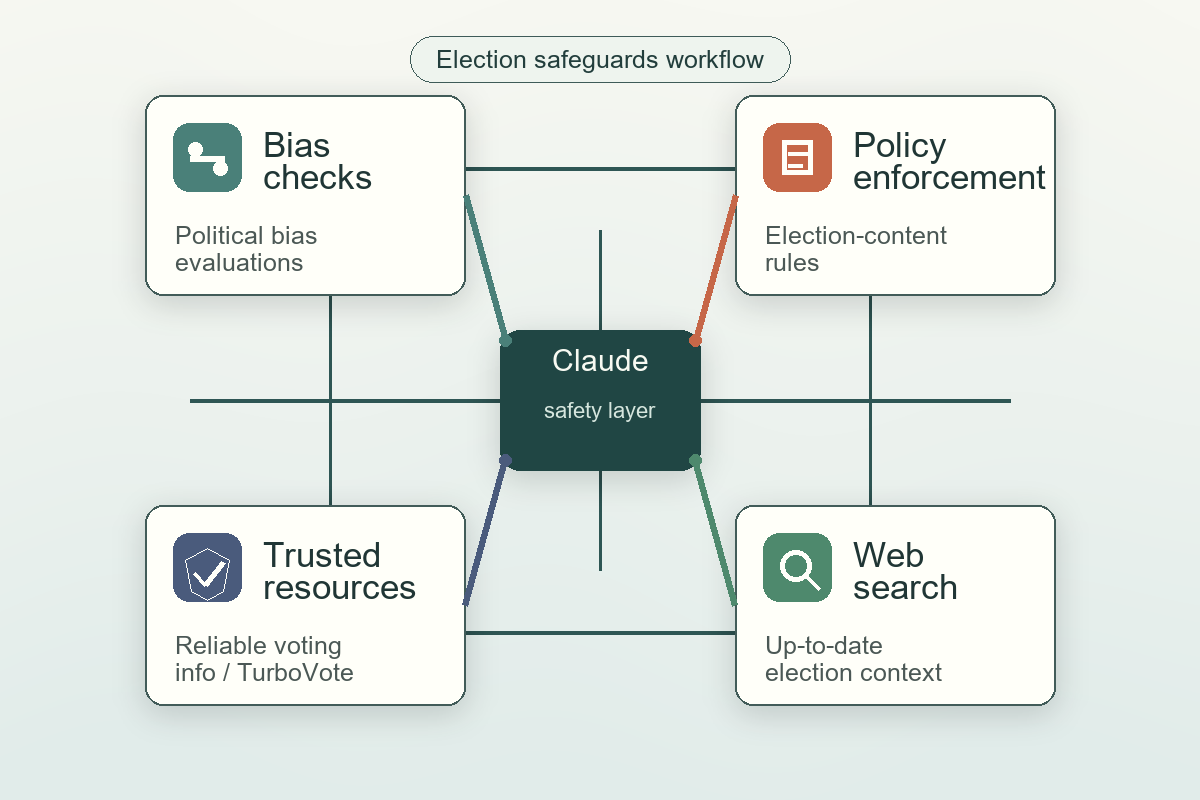

Anthropic은 Claude가 선거 관련 질문을 다루는 방식을 네 가지 축으로 설명했습니다.

첫째, 정치적 편향 측정과 완화입니다. Claude가 정치적 주제에 답할 때 특정 관점으로 사용자를 끌고 가기보다, 여러 관점을 비슷한 깊이와 태도로 다루도록 훈련한다는 설명입니다.

둘째, Usage Policy 집행입니다. Claude는 기만적인 정치 캠페인, 정치 담론에 영향을 주기 위한 가짜 디지털 콘텐츠, 투표 사기, 투표 시스템 방해, 투표 절차에 관한 허위 정보 생성에 쓰일 수 없도록 설계됐다고 Anthropic은 밝혔습니다.

셋째, 신뢰할 수 있는 선거 정보 리소스 연결입니다. 미국 중간선거 관련 질문에서는 TurboVote 같은 비당파 리소스로 연결하는 election banner를 보여줄 예정입니다.

넷째, 웹 검색입니다. 후보 등록, 여론조사, 선거 일정, 선거 결과처럼 최신성이 중요한 질문은 모델의 고정된 학습 데이터만으로 처리하기 어렵기 때문입니다.

핵심 변화 3가지

1. 정치 편향을 평가 수치로 관리하려 한다

Anthropic은 Claude가 정치적 질문에 답할 때 균형 잡힌 응답을 하도록 훈련한다고 설명했습니다. Claude Constitution과 시스템 프롬프트에도 정치적 중립성 관련 방향이 들어간다고 합니다.

이번 글에서 Anthropic은 정치 편향 평가 결과로 Claude Opus 4.7이 95%, Claude Sonnet 4.6이 96%를 기록했다고 밝혔습니다.

여기서 중요한 점은 수치 자체보다 평가 방식입니다. 정치적 관점이 다른 질문에 대해 한쪽은 길고 친절하게 설명하면서 반대쪽은 짧게 처리한다면 좋은 점수를 받기 어렵다는 식입니다. AI가 정치 정보를 다룰 때 단순 정답률보다 균형, 깊이, 태도가 평가 대상이 됩니다.

2. 선거 악용 요청은 별도 방어 테스트를 돌린다

Anthropic은 선거 관련 Usage Policy 평가에 600개 프롬프트를 사용했다고 설명했습니다. 이 중 300개는 유해 요청, 300개는 정상 요청입니다.

예를 들면 선거 허위정보 생성이나 투표 방해 요청은 거절해야 합니다. 반대로 합법적인 캠페인 문구 작성이나 시민 참여 자료 작성은 도와줄 수 있어야 합니다.

Anthropic에 따르면 Claude Opus 4.7은 100%, Claude Sonnet 4.6은 99.8% 비율로 적절히 응답했습니다. 이 결과도 자체 평가라는 점을 분명히 봐야 합니다. 실제 선거 기간에는 사용자가 더 복잡한 방식으로 요청을 쪼갤 수 있기 때문입니다.

3. 다중 턴 영향력 작전까지 본다

선거에서 AI가 위험한 지점은 단순히 틀린 답변만이 아닙니다. 가짜 인물, 조작된 콘텐츠, 반복 증폭, 여러 단계의 설득 시나리오를 통해 여론을 흔드는 영향력 작전도 문제입니다.

Anthropic은 이런 상황을 다중 턴 대화로 시뮬레이션해 모델이 얼마나 잘 버티는지 평가했다고 설명했습니다. 최신 평가에서 Sonnet 4.6은 90%, Opus 4.7은 94% 비율로 적절히 응답했다고 합니다.

개발자 관점에서는 이 부분이 현실적입니다. 민감한 제품을 만들 때 한 번의 입력만 검사해서는 부족합니다. 사용자는 요청을 여러 단계로 나눌 수 있고, 모델은 이전 맥락을 따라가며 의도치 않게 위험한 결과를 만들 수 있습니다.

본문 이미지

실제로 뭐가 달라지나

Claude.ai 사용자는 선거 관련 질문에서 더 자주 외부 리소스와 웹 검색을 보게 될 가능성이 큽니다.

Anthropic은 미국 중간선거에서 투표 등록, 투표소, 선거일, 투표용지 정보 같은 질문에 election banner를 보여주고 TurboVote로 연결할 예정이라고 밝혔습니다. 브라질 선거에도 비슷한 banner를 계획하고 있다고 합니다.

웹 검색도 핵심입니다. Anthropic은 미국 중간선거 관련 200개 이상 프롬프트와 변형을 포함해 총 600개 이상 케이스로 웹 검색 트리거를 평가했다고 밝혔습니다. Opus 4.7은 92%, Sonnet 4.6은 95% 비율로 웹 검색을 실행했다고 합니다.

사용자 입장에서는 이게 중요합니다. 선거 정보는 오래된 답변이 실제 피해로 이어질 수 있습니다. 후보 등록, 투표소, 등록 마감일, 신분증 요건 같은 내용은 Claude 답변만 믿지 말고 선거관리기관이나 공식 리소스로 다시 확인하는 것이 맞습니다.

좋은 점

좋은 점은 Anthropic이 정책, 평가, 제품 UI, 웹 검색을 한 묶음으로 설명했다는 점입니다. "안전하게 하겠다"는 선언만으로는 부족합니다. 어떤 요청을 막고, 어떤 요청은 허용하고, 어디서 최신 정보를 가져오며, 사용자에게 어떤 공식 리소스를 보여줄지까지 설계해야 합니다.

또 정상 요청과 유해 요청을 같이 평가한다는 점도 중요합니다. 너무 강하게 막으면 시민 참여 자료나 합법적인 정치 토론까지 막을 수 있고, 너무 약하게 막으면 허위정보와 영향력 작전에 취약해집니다. 민감한 도메인에서는 이 균형이 제품 품질입니다.

아쉬운 점

아쉬운 점은 공개된 숫자가 Anthropic 자체 평가라는 점입니다. 수치가 높더라도 실제 선거 기간의 사용 패턴은 더 복잡할 수 있습니다. 지역별 선거 정보, 다국어 질문, 은근한 선동, 이미지나 영상과 결합된 콘텐츠까지 고려하면 평가 난도는 더 올라갑니다.

또 웹 검색이 켜진다고 해서 자동으로 정확해지는 것도 아닙니다. 검색 결과의 출처 품질, 최신성, 지역성, 해석 오류가 모두 남습니다. 그래서 Anthropic도 중요한 정보는 공식 출처로 검증하라고 안내합니다.

내 생각

이번 업데이트는 선거 정보에서 AI 서비스가 가져야 할 기본 운영 방식에 가깝습니다. 답변 능력만 키우는 것이 아니라, 정책과 평가, 외부 리소스 연결, 최신 정보 검색, 사후 모니터링이 같이 움직여야 합니다.

특히 개발자와 창업자는 이 글을 안전 문서의 예시로 볼 만합니다. 의료, 금융, 법률, 선거처럼 틀린 답변의 비용이 큰 영역에서는 모델 성능만으로 제품을 설명하기 어렵습니다. 어떤 요청을 거절하는지, 어떤 요청을 도와주는지, 최신 정보는 어떻게 확인하는지, 실패 가능성을 사용자에게 어떻게 전달하는지가 필요합니다.

사용자에게 필요한 태도는 간단합니다. Claude는 설명 도구로 쓸 수 있지만, 투표와 관련된 최종 정보는 반드시 공식 출처로 확인해야 합니다.

요약 카드 이미지

결론

Anthropic의 이번 선거 안전장치 업데이트는 Claude가 선거 정보를 어떻게 다룰지에 대한 운영 계획입니다. 정치 편향 평가, 선거 악용 요청 차단, 다중 턴 영향력 작전 방어, TurboVote 연결, 웹 검색 기반 최신 정보 제공이 핵심입니다.

다만 공개 수치는 자체 평가이고, 실제 선거 기간의 사용 패턴은 더 복잡할 수 있습니다. AI 답변은 참고용으로 쓰되, 투표 장소와 등록 마감일 같은 중요한 정보는 공식 출처로 확인하는 원칙이 필요합니다.

한 줄 평

Anthropic의 선거 안전장치 업데이트는 선거 정보에서 AI가 답변 능력만큼이나 거절, 검색, 공식 리소스 연결을 잘해야 한다는 점을 보여줍니다.