한눈에 보기

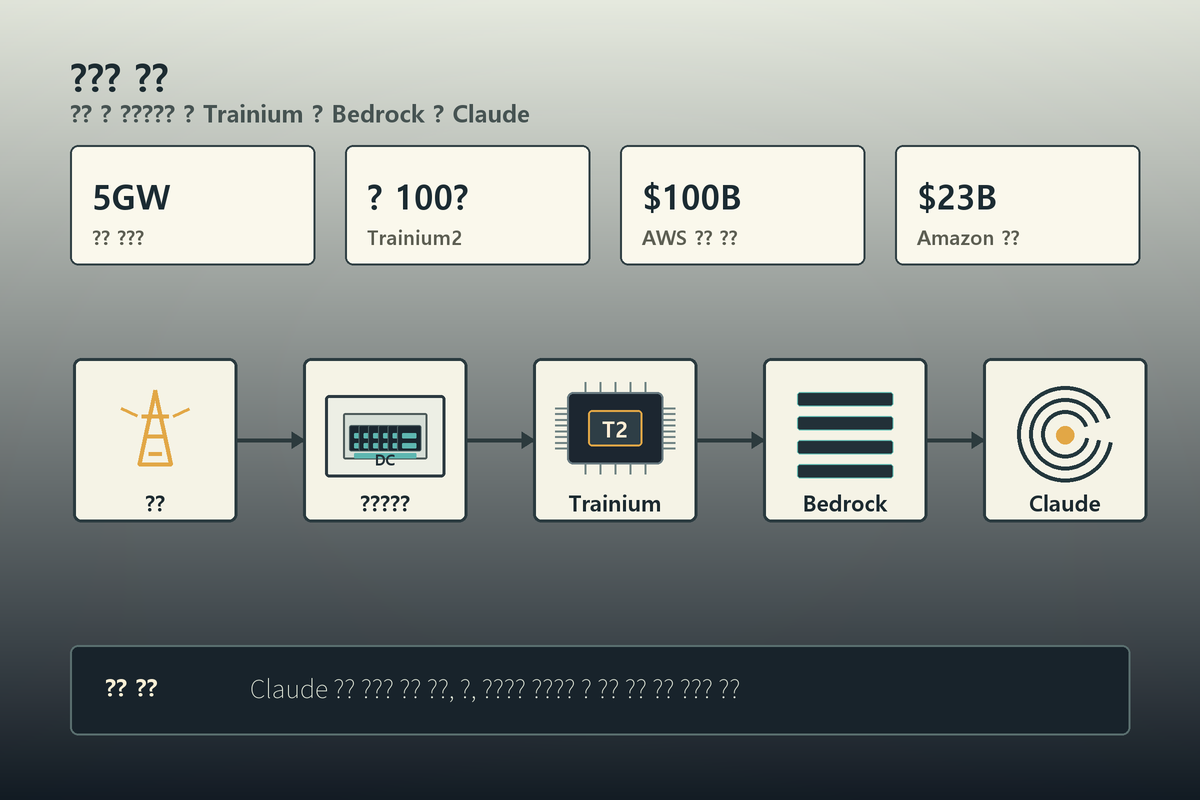

Anthropic과 Amazon이 Claude를 위한 컴퓨트 협력을 크게 키웠습니다. 발표의 숫자만 보면 꽤 큽니다. Amazon은 Anthropic의 Claude 훈련과 서빙을 위해 최대 5GW 규모의 신규 인프라를 지원하고, Anthropic은 향후 10년 동안 AWS 기술에 1,000억 달러 이상을 투자하겠다고 밝혔습니다.

이번 뉴스에서 가장 크게 볼 부분은 "모델을 잘 만드는 회사"만으로는 프런티어 AI 경쟁을 버티기 어려워졌다는 점입니다. 이제는 전력, 데이터센터, AI 칩, 네트워크, 장기 클라우드 계약까지 묶어서 봐야 합니다.

이번 발표 뭐가 나왔나

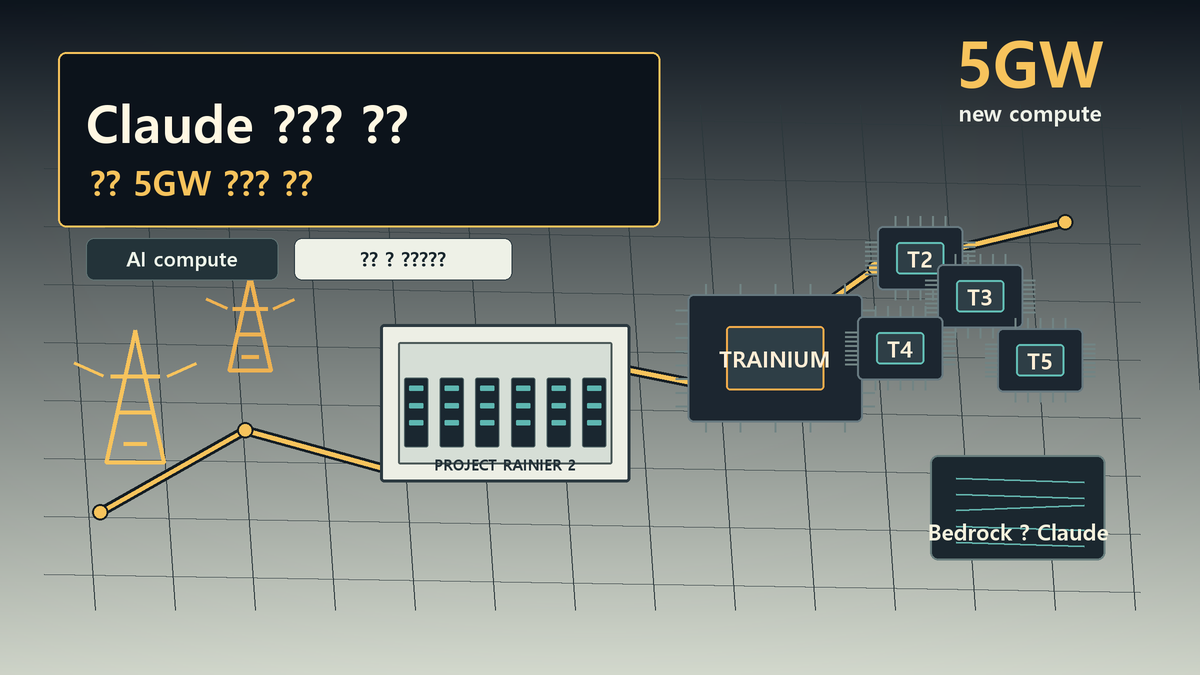

Anthropic 공식 발표에 따르면 Anthropic과 AWS는 Claude 발전에 필요한 인프라를 제공하기 위해 협력을 대폭 확대합니다. Amazon은 Claude 훈련과 서빙을 지원하기 위해 최대 5GW 규모의 신규 인프라를 제공합니다.

여기서 눈에 띄는 이름은 AWS Trainium입니다. Anthropic은 이미 Project Rainier에서 100만 개 이상의 Trainium2 칩을 사용하고 있다고 설명했습니다. 새 Trainium2 용량은 2026년 상반기에 추가로 온라인에 들어오고, 2026년 말에는 Trainium2와 Trainium3 기반 총 용량이 거의 1GW에 이를 것으로 예상한다고 밝혔습니다.

돈의 규모도 큽니다. Anthropic은 앞으로 10년 동안 Claude 인프라를 지원하기 위해 AWS 기술에 1,000억 달러 이상을 투자하기로 했습니다. Amazon도 기존 80억 달러 투자 위에 오늘 50억 달러를 추가하고, 향후 최대 200억 달러를 더 투자할 계획이라고 밝혔습니다.

AP 보도는 이 5GW 규모를 조금 더 생활감 있는 단위로 풀었습니다. AP는 5GW가 원전 5기 출력에 비견되는 규모이고 약 380만 가구에 전력을 공급할 수 있는 수준이라고 설명했습니다. 이 비교는 어디까지나 전력 규모를 감 잡기 위한 표현이지, 실제 데이터센터가 원전 5기를 그대로 쓴다는 뜻은 아닙니다.

핵심 변화 3가지

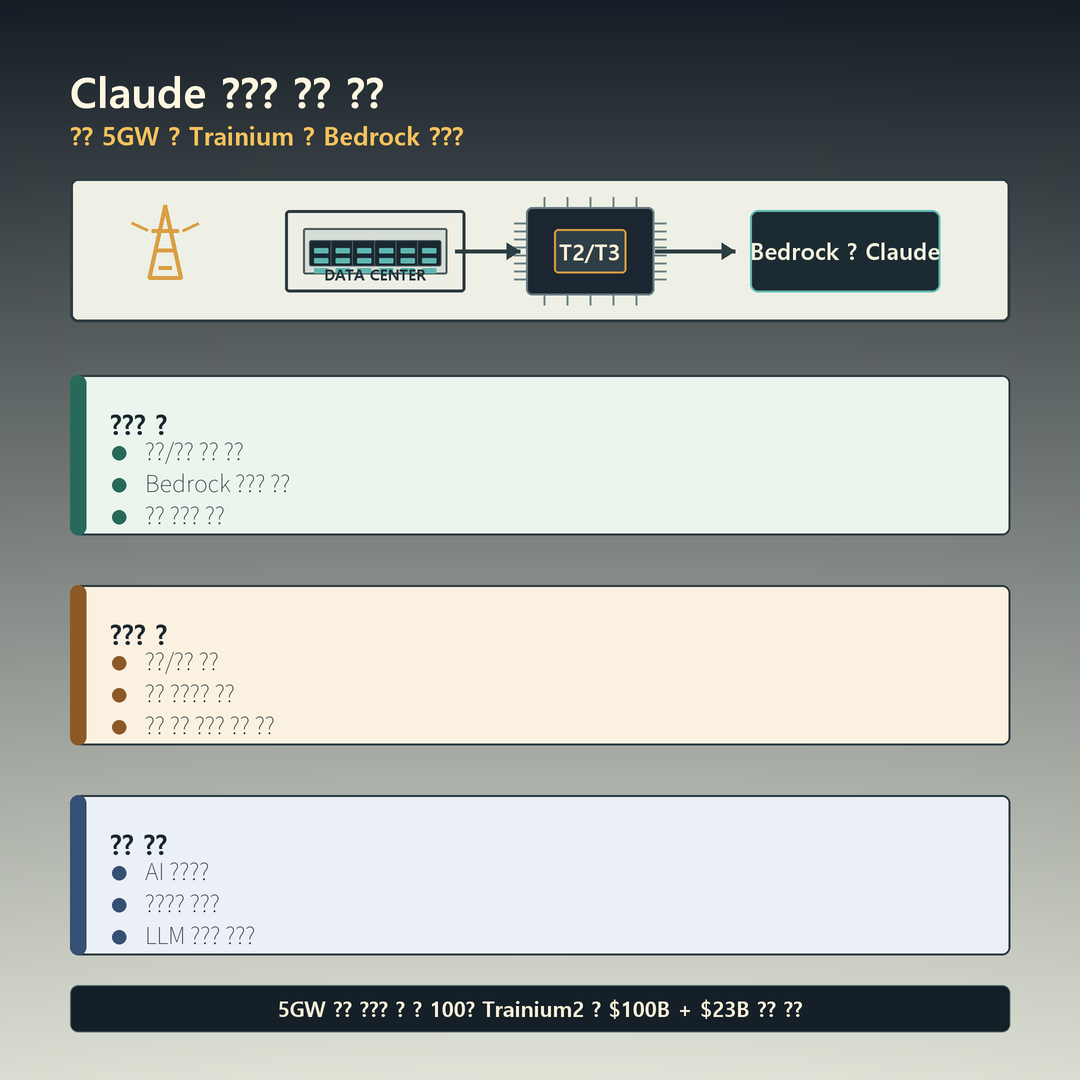

첫째, AI 경쟁의 병목이 더 물리적으로 변하고 있습니다.

예전에는 어떤 모델 구조를 만들었나, 어떤 데이터로 학습했나가 주된 관심사였습니다. 이제는 그 모델을 학습시키고 서비스할 전력과 데이터센터를 누가 먼저 확보하느냐가 같은 급의 문제가 됐습니다.

둘째, 자체 칩과 클라우드 결합이 더 깊어집니다.

이번 발표의 중심에는 AWS Trainium이 있습니다. Project Rainier는 100만 개 이상의 Trainium2 칩 기반으로 설명됐고, 2026년 말에는 Trainium2와 Trainium3 기반 용량이 거의 1GW까지 늘어납니다. NVIDIA GPU만 보던 시야에서 클라우드 사업자의 자체 AI 칩까지 같이 봐야 하는 구도가 더 선명해졌습니다.

셋째, 모델 회사와 클라우드 회사의 관계가 더 복잡해집니다.

Amazon은 Anthropic의 투자자이자 주요 클라우드 파트너입니다. 동시에 AWS Bedrock에서는 Claude 모델을 기업 고객에게 제공합니다. Anthropic 입장에서는 대규모 인프라를 확보하고, Amazon 입장에서는 AWS와 Bedrock 생태계 안에 강력한 프런티어 모델을 붙잡아두는 효과가 있습니다.

본문 이미지

실제로 뭐가 달라지나

일반 사용자

일반 사용자 입장에서는 당장 Claude 화면이 하루아침에 바뀌는 뉴스는 아닙니다. 다만 장기적으로는 더 큰 모델, 더 빠른 응답, 더 안정적인 서비스 용량과 연결될 수 있습니다. AI 서비스가 사람이 몰릴 때 느려지거나 제한되는 문제는 결국 인프라와 연결됩니다.

개발자

개발자 입장에서는 Bedrock에서 Claude를 쓰는 흐름을 다시 볼 만합니다. AWS의 Anthropic 페이지는 Claude 모델을 Amazon Bedrock에서 사용할 수 있다고 안내합니다. 이미 AWS에 데이터, 권한 관리, 배포 파이프라인을 묶어둔 팀이라면 Claude를 별도 서비스로만 보는 게 아니라 AWS 내부의 모델 선택지로 보는 흐름이 더 자연스러워질 수 있습니다.

창업자

창업자 입장에서는 두 가지를 봐야 합니다. 하나는 인프라 비용입니다. AI 제품의 원가 구조는 모델 API 가격만이 아니라 추론량, 지연 시간, 컨텍스트 길이, 캐시 전략, 고객당 사용량으로 결정됩니다.

다른 하나는 공급 안정성입니다. 특정 모델에 제품 핵심이 묶일수록, 그 모델 뒤에 있는 클라우드 계약과 용량 확보가 사업 리스크가 됩니다.

좋은 점

Claude를 쓰는 기업 고객에게는 용량 확보 뉴스가 나쁘지 않습니다. Anthropic은 Amazon Bedrock의 Claude 모델을 10만 개 이상의 고객이 사용하고 있다고 밝혔습니다. 이런 고객층이 계속 늘려면 추론 인프라가 뒤따라야 합니다.

AWS 입장에서도 Bedrock의 설득력이 커집니다. 프런티어 모델을 단순 연동하는 수준이 아니라, 모델 회사의 훈련과 서빙 인프라까지 깊게 묶는 그림이기 때문입니다.

Anthropic 입장에서는 거대한 인프라 루트를 확보합니다. OpenAI, Google DeepMind, xAI, Meta 같은 경쟁자들과 붙는 시장에서 컴퓨트는 연구 속도와 제품 안정성을 동시에 좌우합니다.

아쉬운 점

규모가 큰 만큼 불투명한 부분도 있습니다. 5GW라는 표현은 강력하지만, 어느 지역에 어떤 속도로 데이터센터가 늘어나는지, 전력망 부담을 어떻게 줄이는지, 실제 비용이 고객 가격에 어떻게 반영될지는 별도 확인이 필요합니다.

또 하나는 선택지의 문제입니다. 기업 고객 입장에서는 Bedrock 안에서 Claude를 쉽게 쓰는 장점이 있지만, 특정 클라우드와 특정 모델 조합에 너무 깊게 묶이면 나중에 비용 협상력이나 멀티 모델 전략이 약해질 수 있습니다.

마지막으로 칩 전환의 리스크도 있습니다. Trainium 계열이 대규모로 깔릴수록 AWS 최적화는 강해지겠지만, 개발 생태계와 성능 검증, 모델 이전성은 계속 봐야 합니다. NVIDIA GPU 중심으로 굴러가던 워크로드가 클라우드 자체 칩으로 이동할 때는 항상 소프트웨어 스택이 관건입니다.

내 생각

이번 발표는 AI 모델 뉴스라기보다 AI 산업 설비 투자 뉴스에 가깝습니다. 프런티어 모델 경쟁이 점점 반도체, 전력, 토지, 냉각, 네트워크, 장기 구매 계약의 싸움이 되고 있습니다.

흥미로운 건 이 흐름이 AI 스타트업의 의미도 바꾼다는 점입니다. 예전에는 좋은 연구팀과 제품 감각이 있으면 빠르게 치고 나갈 수 있다는 이미지가 강했습니다. 이제 최상위 모델 경쟁에서는 수십조 원대 인프라 약속을 잡을 수 있는 파트너십이 거의 입장권처럼 보입니다.

물론 모델 아이디어가 덜 중요해졌다는 뜻은 아닙니다. 다만 좋은 아이디어를 실험하고, 크게 학습시키고, 전 세계 기업 고객에게 안정적으로 서빙하려면 물리적 자원이 필요합니다. AI가 소프트웨어 산업처럼 보이지만, 가장 앞단에서는 점점 중공업처럼 움직이고 있습니다.

요약 카드 이미지

결론

Anthropic과 Amazon의 최대 5GW 컴퓨트 협력은 Claude의 다음 단계를 위한 인프라 계약이면서, 동시에 프런티어 AI 시장이 어디로 가고 있는지 보여주는 신호입니다.

앞으로 AI 경쟁을 볼 때는 모델 성능표만 보면 부족합니다. 누가 전력을 확보했는지, 어떤 칩을 쓰는지, 어느 클라우드와 장기 계약을 맺었는지, 기업 고객에게 어떤 배포 경로를 제공하는지까지 같이 봐야 합니다.

한 줄 평

Claude 경쟁의 다음 전장은 프롬프트창 뒤에 있는 전력망과 데이터센터입니다.