한눈에 보기

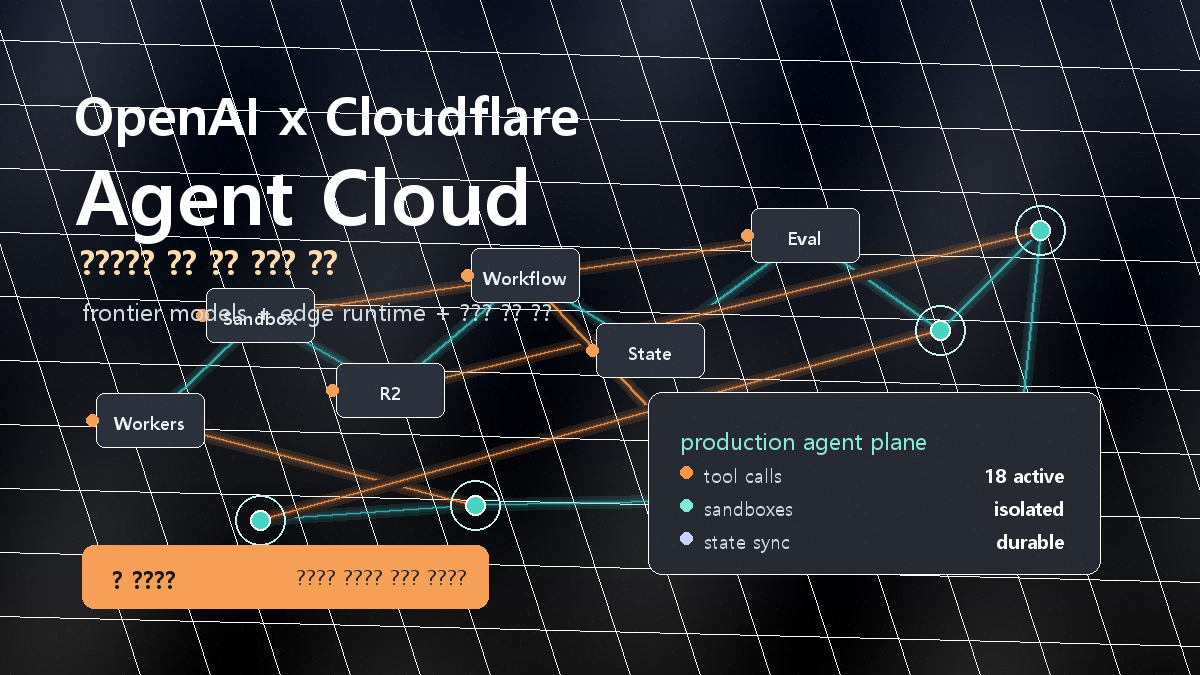

OpenAI와 Cloudflare가 2026년 4월 13일, OpenAI 모델과 Codex를 Cloudflare Agent Cloud에서 사용할 수 있도록 협력한다고 발표했습니다. 핵심은 GPT-5.4 같은 모델을 Cloudflare 쪽에서 호출할 수 있다는 정도에 그치지 않습니다.

Cloudflare의 Workers, Durable Objects, R2, Workflows, Sandboxes 같은 개발자 플랫폼 위에서 에이전트의 실행, 상태 관리, 저장, 비동기 작업, 코드 실행까지 엮을 수 있다는 점이 더 큽니다. 기업 입장에서는 "AI가 답변한다"를 넘어서 "AI가 실제 업무를 오래 붙잡고 처리한다"에 가까운 구조를 만들 수 있게 되는 셈입니다.

이번 발표 뭐가 나왔나

OpenAI 공식 발표에 따르면, Cloudflare Agent Cloud 고객은 OpenAI frontier models와 Codex를 이용해 agentic workflows를 구축할 수 있습니다. 에이전트는 추론하고, 툴을 호출하고, 코드를 수정하고, 실제 작업을 실행하도록 설계된다고 설명됩니다.

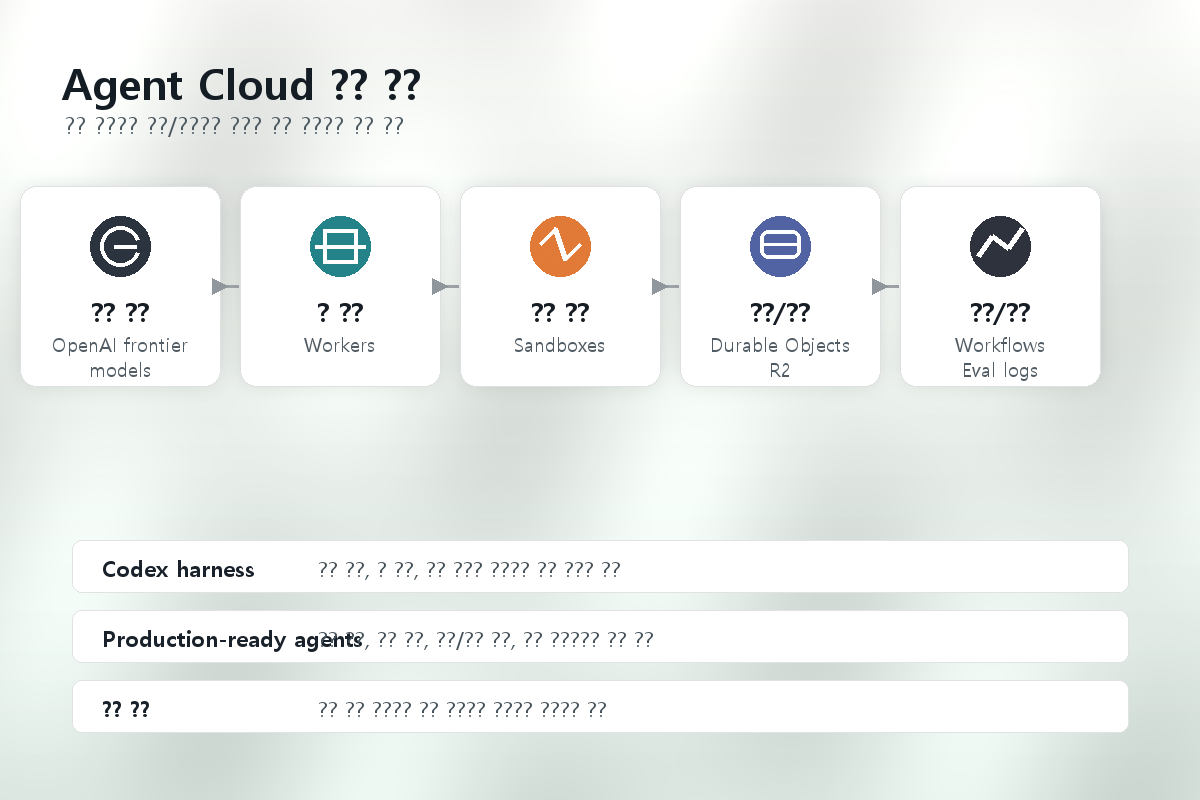

Cloudflare Agent Cloud는 Cloudflare 개발자 플랫폼 위에서 돌아갑니다. OpenAI 발표에서는 Workers, Durable Objects, R2, Workflow 등을 언급했고, Cloudflare 쪽 자료에서는 Sandboxes까지 포함한 Agent Cloud 구성요소를 강조합니다. 여기에 built-in observability까지 붙습니다.

사용 가능한 모델 목록도 꽤 직접적입니다. OpenAI models in Cloudflare Workers AI에서는 GPT-5.4, GPT-5.4-Codex, GPT-5.3-Codex, GPT-4.2-mini, GPT-5.4-mini를 사용할 수 있다고 안내됐습니다. Codex harness는 Cloudflare Sandboxes 안에서 실행할 수 있고, Agent SDK는 Cloudflare Workers의 Workflow 기반 Async Agents를 지원해 오래 걸리는 다단계 비동기 작업을 처리할 수 있습니다.

예시로는 고객 지원 에이전트, 코딩 어시스턴트, 리서치 어시스턴트가 제시됐습니다. 흔한 예시처럼 보이지만, 이번에는 모델 이름보다 실행 환경의 조합이 더 눈에 들어옵니다.

핵심 변화 3가지

첫째, 모델 API와 실행 인프라의 거리가 줄었습니다.

지금까지 많은 에이전트 프로젝트는 모델 API 호출, 백엔드 서버, 큐, DB, 파일 저장소, 코드 실행 환경을 따로 붙이는 방식이었습니다. 이번 통합은 Cloudflare 생태계 안에서 이 조각들을 더 가깝게 묶습니다. Workers는 실행, Durable Objects는 상태, R2는 저장, Workflows는 긴 작업 흐름, Sandboxes는 격리된 코드 실행을 맡는 식입니다.

둘째, Codex가 더 운영형 에이전트에 가까워졌습니다.

OpenAI는 Codex harness를 Cloudflare Sandboxes 안에서 실행할 수 있다고 설명했습니다. Cloudflare Sandboxes는 2026년 4월 10일 GA가 발표됐고, 신뢰할 수 없는 코드를 안전하게 실행하기 위한 컨테이너형 환경을 제공합니다. 파일시스템, 네트워크 스택, 패키지 설치, 브라우저 자동화, 웹 앱/API route 실행까지 지원한다는 점에서 코딩 에이전트와 잘 맞습니다.

셋째, 오래 걸리는 AI 작업을 제품 기능으로 만들기 쉬워졌습니다.

Cloudflare Agents 문서는 에이전트가 몇 초, 몇 분, 몇 시간 동안 실행될 수 있고, 비싼 다단계 작업을 처리하며, 예약 작업과 실시간 클라이언트 통신, 웹 브라우징, 데이터 조회, human-in-the-loop까지 지원할 수 있다고 설명합니다. 이건 챗봇보다는 작업자에 가까운 설계입니다.

본문 이미지

실제로 뭐가 달라지나

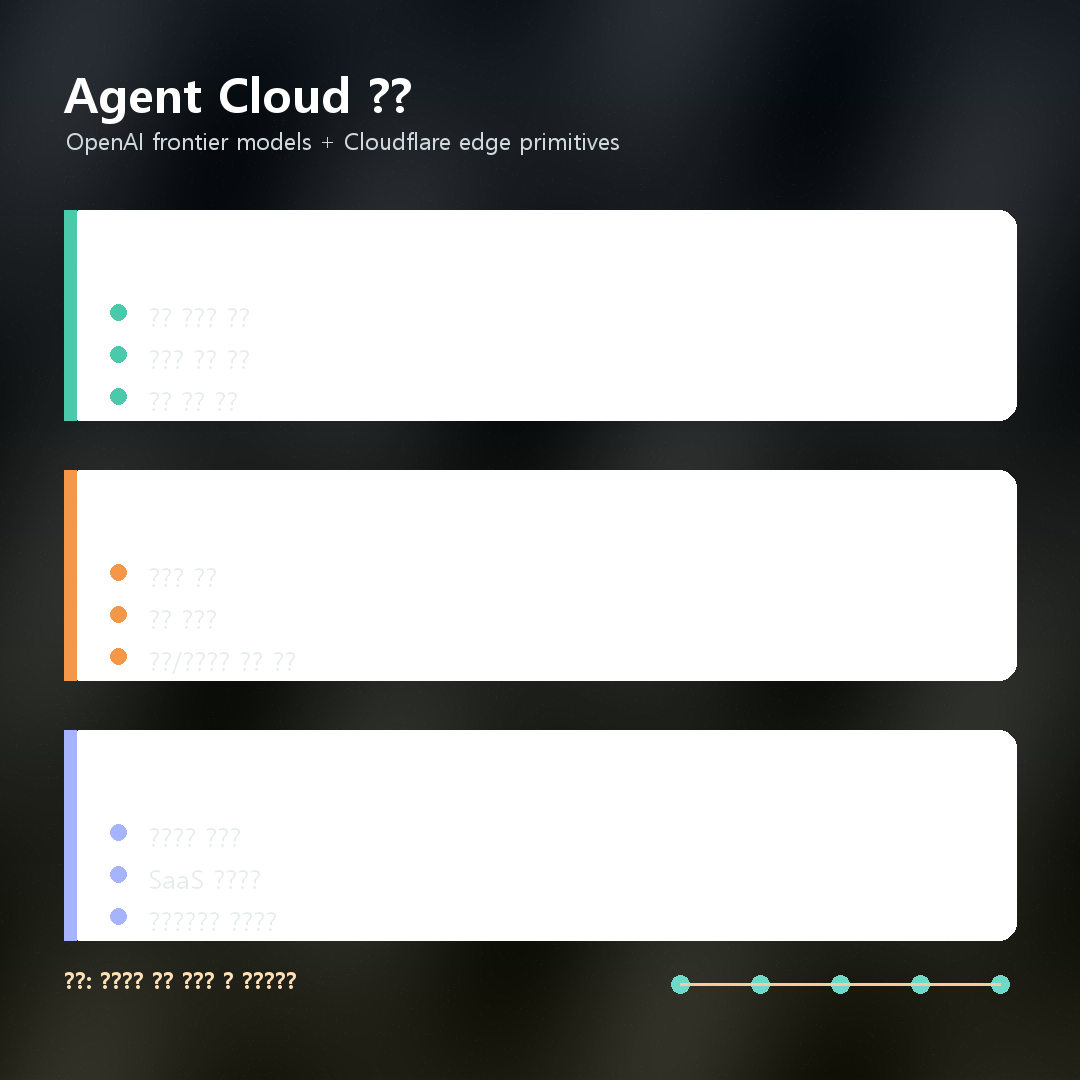

일반 사용자

일반 사용자 입장에서는 당장 Cloudflare Agent Cloud라는 이름을 직접 볼 일은 많지 않을 수 있습니다. 대신 고객센터, 리포트 생성, 문서 처리, 예약성 업무 같은 서비스 뒤쪽에서 더 오래 일하고 더 많은 도구를 다루는 AI 기능을 만나게 될 가능성이 큽니다.

예를 들어 고객 지원 에이전트가 단순히 답변만 하는 게 아니라 주문 상태를 조회하고, 정책 문서를 참고하고, 필요한 경우 내부 시스템 업데이트까지 요청하는 식입니다. 물론 실제 서비스에서는 권한, 승인, 로그 관리가 함께 설계돼야 합니다.

개발자

개발자에게는 에이전트의 주변부를 직접 조립하는 부담이 조금 줄어듭니다. 상태 저장은 Durable Objects, 긴 작업은 Workflows, 파일 저장은 R2, 격리 실행은 Sandboxes, 엣지 실행은 Workers로 나눠 생각할 수 있습니다.

특히 코딩 에이전트나 리서치 에이전트처럼 파일을 만들고, 코드를 실행하고, 브라우저를 조작하고, 여러 단계를 거치는 기능은 실행 환경이 까다롭습니다. Sandboxes가 GA로 제공되면서 이 부분이 Cloudflare의 관리형 인프라 안으로 들어온 점은 개발자에게 꽤 현실적인 변화입니다.

창업자

창업자나 작은 팀에게는 "AI 에이전트 제품을 만들 때 처음부터 인프라 회사를 같이 만들어야 하는가"라는 부담을 줄여주는 선택지가 됩니다. Cloudflare의 글로벌 네트워크와 pay-per-use Sandboxes 가격 모델, observability 도구, remote bindings 같은 요소는 작은 팀이 운영 부담을 낮추는 데 도움이 될 수 있습니다.

다만 플랫폼 선택은 곧 종속성 선택이기도 합니다. Cloudflare 위에서 빠르게 만들 수 있는 만큼, 나중에 다른 인프라로 옮길 때 상태, 워크플로, 샌드박스 실행 구조를 어떻게 분리할지도 초기에 생각해두는 편이 좋습니다.

좋은 점

가장 좋은 점은 에이전트 개발의 병목이 모델 성능 하나로만 포장되지 않았다는 겁니다. 실제 제품에서 필요한 실행, 상태, 저장, 관찰, 격리 환경이 함께 언급됐습니다.

Cloudflare Agents SDK가 상태ful agent, asynchronous workflows, Browser Rendering 기반 웹 브라우징, Sandboxes 기반 코드 실행, WebSockets 기반 실시간 상호작용을 지원한다는 점도 방향이 분명합니다. "채팅 UI에 모델 붙이기"보다 한 단계 더 제품에 가까운 구성을 겨냥합니다.

또 하나는 Codex의 위치입니다. OpenAI가 Codex를 단순 개발 도구가 아니라 기업 워크플로에 들어가는 에이전트 실행 단위로 확장하려는 흐름이 보입니다. 같은 주에 OpenAI가 Codex 엔터프라이즈 확산 계획을 별도로 발표한 것도 이 맥락과 맞물립니다.

아쉬운 점

아쉬운 부분은 실제 운영 비용과 복잡도입니다. Cloudflare는 Sandboxes에 pay-per-use 가격을 제공한다고 밝혔지만, 에이전트가 몇 분 또는 몇 시간씩 돌고, 모델 호출과 저장소와 워크플로가 함께 붙으면 비용 구조가 단순하지 않을 수 있습니다.

또한 에이전트가 외부 서비스와 Cloudflare 리소스에 안전하게 연결하는 remote bindings, tracing, evaluation, testing, inspecting 같은 observability 도구가 발표됐지만, 기업이 바로 안심하고 쓸 수 있으려면 내부 권한 모델과 감사 로그, 데이터 경계 설정이 촘촘해야 합니다.

마지막으로, 모델과 인프라가 가까워지는 건 장점이지만 플랫폼 의존도도 커집니다. Workers, Durable Objects, R2, Workflows, Sandboxes를 깊게 쓰는 구조라면 Cloudflare 안에서는 빠르지만, 멀티클라우드나 자체 인프라 전략과는 따져볼 부분이 생깁니다.

내 생각

이번 발표는 "AI 에이전트가 대세다"라는 말보다 더 구체적입니다. 에이전트가 실제로 업무를 하려면 머리만 있어서는 안 되고, 손발과 작업대와 기록장이 필요합니다. 이번 통합은 OpenAI가 머리에 해당하는 모델과 Codex를 제공하고, Cloudflare가 손발에 해당하는 실행 인프라를 제공하는 그림에 가깝습니다.

개인적으로는 고객 지원 에이전트보다 코딩 어시스턴트와 리서치 어시스턴트 쪽이 먼저 눈에 띕니다. 파일을 다루고, 코드를 실행하고, 웹을 보고, 여러 단계로 생각한 뒤 결과물을 남기는 작업은 Agent Cloud의 장점이 잘 드러나는 영역입니다.

다만 모든 팀이 곧바로 "에이전트 플랫폼"부터 도입할 필요는 없습니다. 반복 업무가 있고, 여러 도구를 오가며, 실패했을 때 재시도와 추적이 필요한 작업부터 후보로 잡는 게 현실적입니다. 단순 Q&A라면 여전히 기존 챗봇 구조가 더 싸고 빠를 수 있습니다.

요약 카드 이미지

결론

OpenAI와 Cloudflare의 Agent Cloud 통합은 모델 제공처가 하나 늘었다는 뉴스가 아닙니다. 기업용 AI 에이전트를 만들 때 필요한 모델, 코드 실행, 상태 관리, 파일 저장, 비동기 워크플로, 관찰 도구를 한 플랫폼 흐름 안에서 묶으려는 시도입니다.

AI 에이전트 시장은 이제 "어떤 모델이 더 똑똑한가"와 함께 "그 모델을 어디에서 안전하게 오래 실행할 것인가"로 경쟁축이 옮겨가고 있습니다. 이번 발표가 그 변화를 꽤 잘 보여줍니다.

한 줄 평

OpenAI Cloudflare Agent Cloud 통합은 AI 에이전트를 데모에서 운영 환경으로 옮기려는 꽤 현실적인 인프라 뉴스입니다.

참고 출처

- OpenAI - Enterprises power agentic workflows in Cloudflare Agent Cloud with OpenAI

- Cloudflare Developers - Build Agents on Cloudflare

- Cloudflare Blog - Agents have their own computers with Sandboxes GA

- Cloudflare Press Release - Cloudflare expands its Agent Cloud to power the next generation of agents

- OpenAI - Scaling Codex to enterprises worldwide

- Anthropic - Anthropic and Amazon expand collaboration for up to 5 gigawatts of new compute

- Google Research - It's all about the angle: Your photos, re-composed

- NVIDIA - NVIDIA Launches Ising

- Microsoft 365 Developer Blog - MCP Apps now available in Copilot chat