OpenAI Privacy Filter 공개: 로컬에서 개인정보를 마스킹하는 오픈웨이트 모델

OpenAI Privacy Filter 공개에서 봐야 할 핵심은 화려한 챗봇 기능이 아닙니다. 텍스트 속 개인정보, 즉 PII를 찾아서 마스킹하는 실무형 오픈웨이트 모델이 나왔다는 점입니다.

한눈에 보기

- 발표 내용: OpenAI가 텍스트 속 PII를 탐지하고 마스킹하는 open-weight 모델 Privacy Filter를 공개했습니다.

- 핵심 변화: 개인정보가 포함된 텍스트를 외부 서버로 보내지 않고 로컬에서 처리할 수 있습니다.

- 한 줄 결론: AI 모델 경쟁이 범용 챗봇에서 실제 데이터 파이프라인에 들어가는 특화 모델로 넓어지고 있습니다.

이번 발표, 뭐가 나왔나

OpenAI가 2026년 4월 22일 Privacy Filter를 공개했습니다. 이 모델은 텍스트 안의 개인 식별 정보, PII를 찾아 마스킹하거나 redaction할 수 있도록 만든 open-weight 모델입니다.

OpenAI 설명에 따르면 high-throughput privacy workflow를 염두에 둔 모델이고, 로컬 실행이 가능해 필터링 전 데이터가 기기 밖으로 나가지 않게 설계할 수 있습니다.

이건 일반 사용자가 바로 만지는 기능이라기보다, AI 서비스 뒤쪽의 데이터 파이프라인에 들어가는 부품입니다. 고객 문의, 상담 로그, 내부 문서, 검색 인덱스, 학습 데이터 준비 단계에서 개인정보를 먼저 가리는 용도입니다.

핵심 변화 3가지

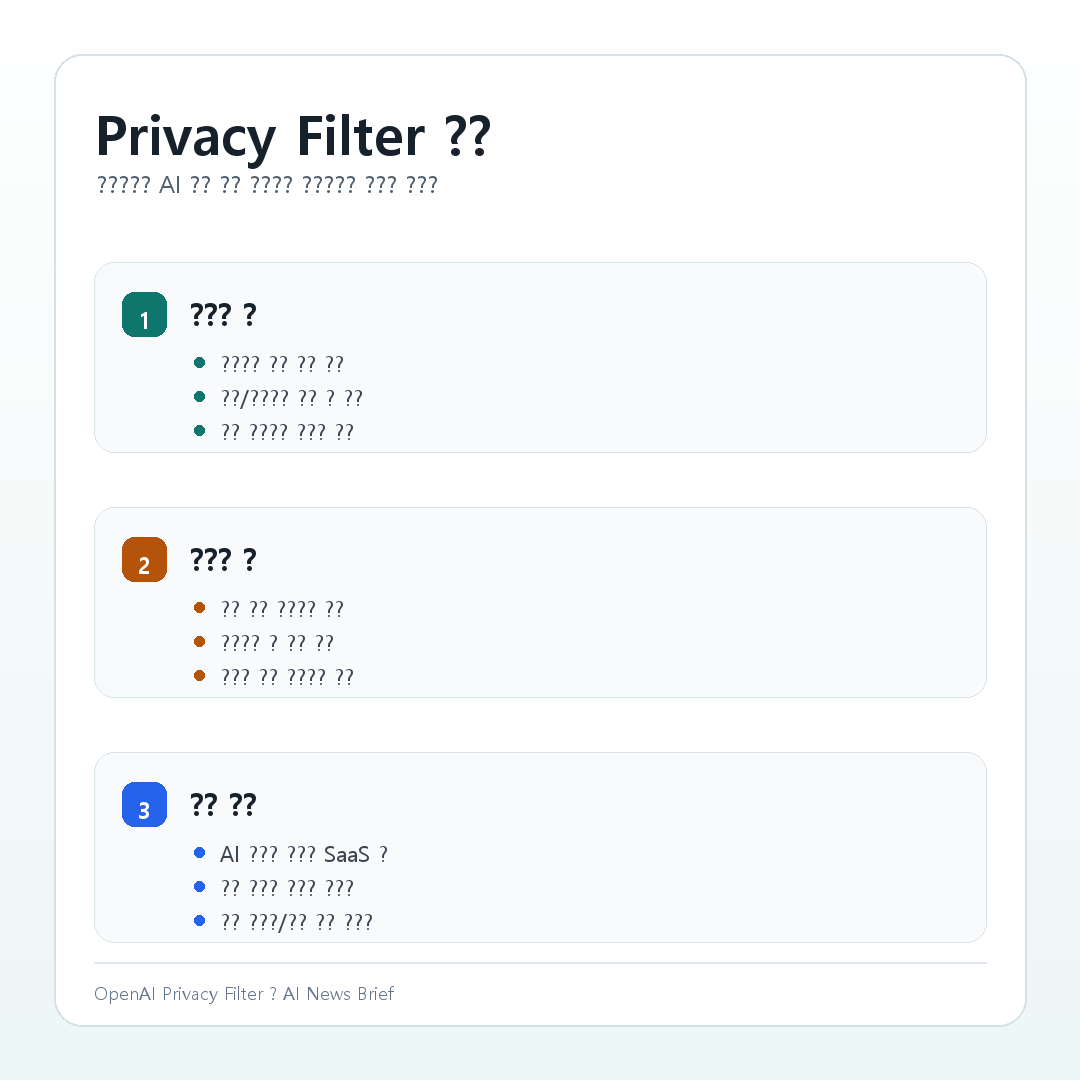

1. PII 탐지와 개인정보 마스킹에 특화됐다

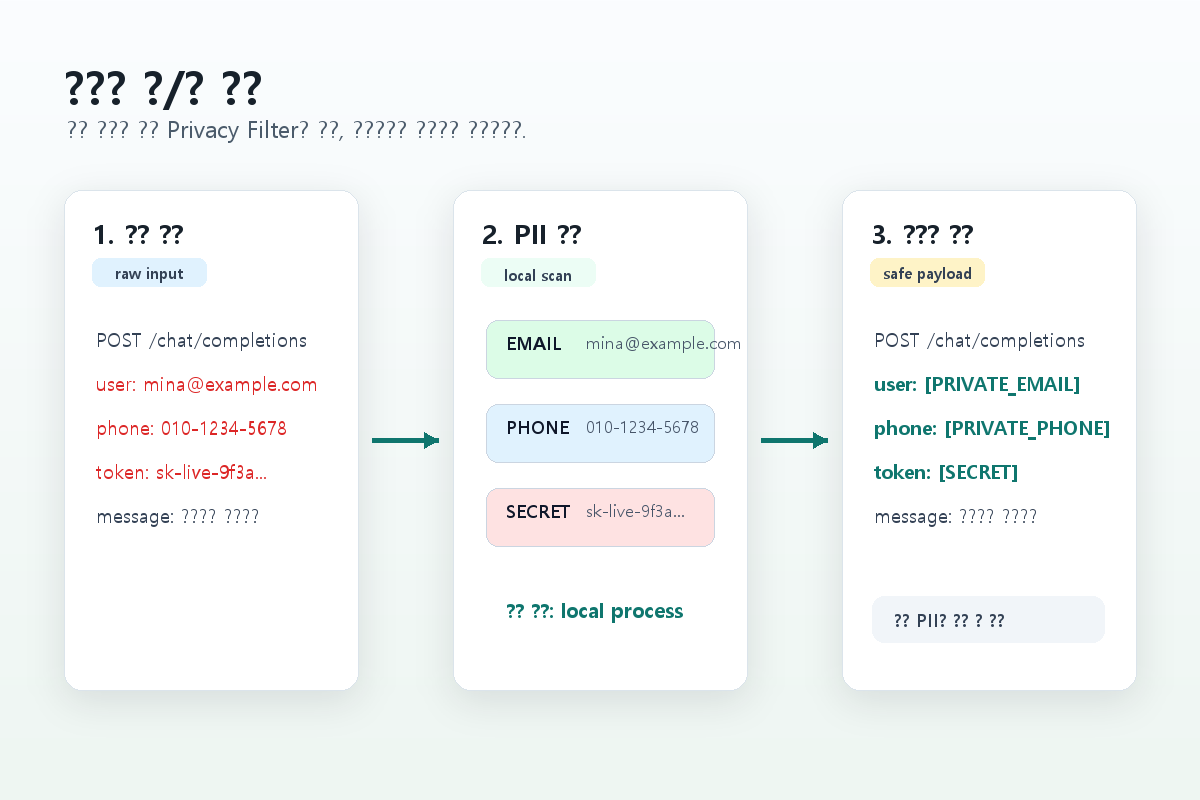

Privacy Filter는 일반 텍스트 생성 모델이라기보다, 텍스트 안에서 개인정보 범위를 찾아내는 token-classification 모델에 가깝습니다.

탐지 대상은 개인 이름, 주소, 이메일, 전화번호, URL, 날짜, 계정번호, secret/API key 같은 항목입니다.

기존의 단순 패턴 매칭 방식은 이메일이나 전화번호처럼 형식이 뚜렷한 정보에는 강합니다. 하지만 문맥이 중요한 개인정보에는 한계가 있습니다. OpenAI는 Privacy Filter가 주변 문맥을 보고 PII span을 탐지하도록 설계됐다고 설명합니다.

2. 로컬 실행과 single forward pass가 포인트다

이번 발표에서 가장 중요한 부분은 로컬 실행 가능성입니다.

개인정보를 마스킹하려고 원문 데이터를 다시 외부 API로 보내는 구조라면, 프라이버시 도구 자체가 또 다른 리스크가 될 수 있습니다. Privacy Filter는 로컬에서 돌릴 수 있기 때문에, 필터링 전 데이터가 기기 안에 남는 워크플로우를 만들 수 있습니다.

성능 구조도 실무형입니다. OpenAI는 이 모델이 single forward pass로 토큰을 라벨링한다고 설명합니다. 공개 모델은 128k 토큰 컨텍스트를 지원하고, 1.5B total parameters에 50M active parameters를 가진다고 안내합니다.

3. Apache 2.0으로 Hugging Face와 GitHub에 공개됐다

Privacy Filter는 Apache 2.0 라이선스로 Hugging Face와 GitHub에 제공됩니다.

개발자는 자체 환경에서 실행하거나, 조직의 데이터 분포와 개인정보 정책에 맞춰 fine-tuning하는 식으로 활용할 수 있습니다.

OpenAI는 성능 수치도 함께 공개했습니다. PII-Masking-300k benchmark에서 F1 96%, annotation issue를 보정한 corrected benchmark에서는 F1 97.43%를 기록했다고 설명합니다.

다만 이 숫자만 보고 모든 환경에서 같은 결과가 나온다고 보면 곤란합니다. OpenAI도 도메인, 언어, 스크립트, 데이터 분포에 따라 성능이 달라질 수 있다고 밝히고 있습니다.

그래서 실제로 뭐가 달라지나

일반 사용자 기준

일반 사용자가 바로 체감할 제품 기능이라기보다는, 서비스 뒤쪽에서 개인정보를 덜 위험하게 다루기 위한 부품에 가깝습니다.

예를 들어 사용자가 입력한 텍스트, 고객 문의, 로그, 리뷰 데이터 같은 곳에서 이메일, 전화번호, 계정번호, API key 등을 가리는 파이프라인에 들어갈 수 있습니다.

다만 Privacy Filter가 곧 "완전한 익명화"를 보장한다는 뜻은 아닙니다. OpenAI도 이 모델이 anonymization tool이나 compliance certification의 대체물이 아니라고 못 박았습니다.

개발자 기준

개발자 입장에서는 꽤 현실적인 도구입니다.

로깅, 검색 인덱싱, 학습 데이터 준비, 리뷰 파이프라인처럼 텍스트를 많이 다루는 작업에서 PII 마스킹 단계를 직접 붙일 수 있습니다. 특히 open-weight이고 Apache 2.0으로 공개됐다는 점은 실험, 커스터마이징, 상업적 배포 측면에서 접근성을 높입니다.

128k 토큰 컨텍스트와 single forward pass 구조는 긴 문서나 대량 처리 쪽을 의식한 설계로 읽힙니다. 개인정보 필터링이 "정규식 몇 개 붙이는 작업"에서 별도 모델과 평가가 필요한 영역으로 넘어가고 있습니다.

창업자와 업무 활용 기준

스타트업이나 기업 입장에서는 AI 기능을 붙이기 전에 개인정보 처리 흐름을 더 촘촘히 만들 수 있는 선택지가 생겼습니다.

고객 응대 데이터, 내부 문서, 상담 기록, 업무 로그를 AI 파이프라인에 넣기 전 PII를 먼저 마스킹하는 식의 구성이 가능합니다.

최근 OpenAI가 Trusted Access for Cyber, GPT-Rosalind 같은 목적 특화 접근과 인프라를 함께 내놓는 흐름도 같이 봐야 합니다. 큰 모델 하나로 모든 걸 해결한다기보다, 실제 업무에 붙일 수 있는 특화 도구와 인프라 경쟁으로 무게중심이 옮겨가는 분위기입니다.

좋은 점

- 로컬 실행이 가능해 필터링 전 개인정보를 외부로 보내지 않는 구조를 만들 수 있습니다.

- PII, 계정번호, secret/API key까지 포함해 실무에서 자주 문제가 되는 항목을 다룹니다.

- 128k 토큰 컨텍스트와 single forward pass로 긴 입력과 대량 처리 워크플로우를 염두에 둔 설계입니다.

- Apache 2.0 라이선스로 Hugging Face와 GitHub에 공개되어 실험과 커스터마이징 장벽이 낮습니다.

- OpenAI가 benchmark 결과와 한계를 함께 공개했습니다.

아쉬운 점

- 익명화 도구나 컴플라이언스 인증의 대체물은 아닙니다.

- 법률, 의료, 금융처럼 민감한 영역에서는 human review와 domain-specific evaluation이 필요합니다.

- 조직마다 개인정보 정책이 다르기 때문에, 기본 모델을 그대로 쓰기보다 자체 평가와 fine-tuning이 필요할 수 있습니다.

- 언어, 스크립트, 이름 표기 방식, 도메인이 학습 분포와 다르면 성능이 달라질 수 있습니다.

내 생각

이번 OpenAI Privacy Filter 발표는 AI를 실제 서비스에 넣을 때 필요한 바닥 공사에 가깝습니다. 개인정보 마스킹은 눈에 잘 띄는 기능은 아니지만, 고객 데이터나 내부 문서를 다루는 팀에게는 중요한 문제입니다.

흥미로운 지점은 OpenAI가 이걸 API 기능 하나로만 묶지 않고, open-weight 모델로 공개했다는 점입니다. 로컬에서 돌리고, 자체 정책에 맞게 조정하고, 필요한 곳에 파이프라인으로 붙이라는 방향입니다.

AI 제품이 커질수록 이런 작은 특화 모델들이 오히려 더 자주 쓰이게 될 수 있습니다.

결론

OpenAI Privacy Filter의 핵심은 "개인정보를 잘 가리는 모델"을 넘어, AI 시대의 데이터 파이프라인에 들어갈 수 있는 privacy infrastructure를 공개했다는 점입니다.

로컬 실행, open-weight, Apache 2.0, 128k 컨텍스트, PII와 secret 탐지까지 묶어서 보면 단순한 데모용 모델은 아닙니다.

다만 이 모델 하나로 개인정보 리스크가 사라진다고 보면 안 됩니다. OpenAI가 직접 밝힌 것처럼, 고위험 영역에서는 사람의 검토와 도메인별 평가가 필요합니다.

한 줄 평:

OpenAI Privacy Filter는 멋진 AI 기능보다 먼저 필요한, 개인정보 마스킹용 실무 부품에 가깝다.